随着卫星成为国民经济发展不可或缺的重要基础设施,卫星影像的获取越来越容易,并且在诸如基建、农业、林业、地质、水文、交通、海洋、灾害预报、军事等大量领域中都得到了广泛应用。据统计,地表约有66.7%被云层覆盖[1],云层是制约光学遥感影像应用的一大因素。另外,由于云和雪在可见光影像上表现出反射率高的类似特点,一些传统方法如阈值法等无法将其区分开,容易出现误判,阻碍影像的自动处理。而云和雪的检测也有着深层次的需求,比如,云雪的准确检测和大气反射率库的构建能服务于大气气溶胶反演[2]。所以,快速、准确、自动地检测云和雪有着重要意义。

遥感数据来源多且特点不尽相同,研究人员针对不同数据研究了多种云检测算法,包括物理阈值法[3-5]、多时相法[6]、基于纹理和空间特征检测法[7-10]、高程法[11-12]和机器学习法[13-15]等。物理阈值法利用云层的高反射率和低温物理特性,优点是计算简单、速度快、检测效果较好,缺点是当下垫面对比度不高或云为薄卷云、层云和小积云时,很难将云层及下垫面区分开来,因为算法需要调整不同阈值适应来自不同传感器的影像,并且受季节、气候、成像时间等因素影响较大。比如,文献[3]利用简单云像元作为阈值进行云检测, 文献[4]综合多种阈值检测结果进行云检测,而Otsu法[5]具有原理简单、稳定有效的优点,是使用较广泛的阈值方法之一,它使用穷举法选取使图像类间方差最大的阈值将图像划分为前景和背景两个部分。然而,由于图像中的对象具有各自不同的光谱分布,因此需要不同的阈值才能从其背景中分割出感兴趣的目标,导致光谱测度直方图的零阶和一阶累积矩重复计算,计算成本高,实时性和智能化程度低。

基于纹理特征和空间特性检测法本质上也是阈值法,其计算构成云层纹理的某些像素的变化与某个阈值比较,如果大于某个阈值,则认定为云。遥感影像上云层的特征分为3类:灰度特征,包括均值、方差、差分、熵和直方图;频率特征,包括DCT变换域特征、小波变换域特征;纹理特征,包括边缘特征、共生矩阵、SLIC特征[7]等。比如,文献[10]提出云检测算法选用的纹理特征为分形维数和角二阶矩,应用一种基于树状判别结构的快速算法,可以显著提高运行效率,已经在中巴地球资源02B卫星中得到了应用。文献[8]提出了一种基于特征空间线性降维压缩的云检测方法,首先选取云与地物的分类特征参量,构造特征空间,建立样本的概率分布模型,而后利用最大似然估计法求解模型参数,估计最佳转换矩阵,进行特征空间的降维压缩与去相关处理,最后通过分类器进行云检测,有效解决了分类特征空间维数过高引起的信息冗余。文献[9]认为复杂多变的光谱特征以及难以有效表达的空间形态特征,使云及云影一直存在检测过程复杂、适用性差和精度不高的问题。对此,本文提出了一种云及云影的多特征协同检测方法,首先,通过光谱特征区分云和冰雪;其次,通过组合云影定向移动模型与近红外波段亮度阈值检测出云影像元,并在Landsat 8影像上试验证明了多光谱曲线、“诊断性”波段及空间关系多特征耦合能有效地检测出影像中的薄云、厚云及云影。

基于高程辅助的云雪检测[11-12]通过云与雪、其他地物高程的差异,通过多幅影像密集匹配技术得到云的三维几何特征,并在对比已有高程信息的基础上,实现云和地面的区分,此类方法精度较高,但涉及密集匹配与数字高程模型配准等操作,成本高、条件多、耗时长。

随着模式识别与机器学习技术的发展,研究者把模式识别方法应用于影像云检测中,取得了较好的效果。文献[13]基于统计学理论,将主成分分析法(PCA)运用于影像云检测中;文献[14]则基于全概率贝叶斯理论提出云检测算法;文献[15]利用模糊C均值聚类方法通过最小化目标函数完成样本迭代聚类,利用支持向量机(SVM)聚类法进行类属判别,该方法在具备先验知识的条件下可以获得较好的分割结果,但人为干预极大地影响检测效率。此外,还有稀疏感知分类器、自动编解码器等方法。总的来说,机器学习算法的训练和预测时间与图像的像素数呈线性关系,因此,对于大幅面遥感卫星影像来说,此类算法的运行时间往往很长,难以满足实时检测的需要。

近年来,深度学习算法在图像分类、图像分割以及目标检测等领域取得了极大发展。作为深度神经网络基础的卷积神经网络(CNN)在图像分类和目标检测等方面已获得广泛应用,其优点在于卷积层数越多,感受野范围越大,能学习到抽象的影像特征越多,并且采用局部连接和权值共享的方式使网络易于训练。文献[16]利用CNN进行遥感影像云检测,解决了资源三号卫星波段少和光谱范围受限而导致的阈值法检测效果不佳的问题,但该方法使用的CNN结构较简单;文献[17]提出了全卷积神经网络(FCN),并将其用于图像语义分割,与经典的CNN在卷积层之后使用全连接层得到固定长度的特征向量进行分类不同,FCN可以输入任意尺寸的影像,对影像进行像素级分割。此后,基于FCN的深度学习图像分割模型层出不穷,网络不断加深,结构日益复杂,影像语义分割的精度也不断提高。比如文献[18]提出了一种融合聚类与CNN的方法,首先通过改进SLIC聚类得到超像素,再利用CNN对超像素进行多尺度特征提取,其优点在于利用改进的SLIC聚类能够获得比较精确的云边界信息,但是该方法不能实现端到端的云检测;文献[19]提出了一种基于多尺度特征卷积神经网络(MF-CNN)模型检测遥感影像中薄云、厚云,在Landsat 8卫星遥感影像上得到了较好的检测效果;文献[20—23]也提出了不同的FCN网络在各自的数据上进行了试验,得到了良好的检测效果,目前改进的FCN方法主要是通过对CNN得到的不同尺寸的特征图进行多尺度预测来提高检测的精度。综上,基于深度学习的方法在卫星遥感影像云检测方面的有效性和重要性与日俱增。

本文专注于国产遥感卫星天绘一号[24],它是我国第一代传输型立体测绘卫星,搭载了三线阵CCD相机、2 m高分辨率全色相机和多光谱相机等3类5个相机载荷。在利用天绘一号影像进行实际生产前,需要剔除云量覆盖过大的影像,以减轻生产负担,提高生产效率,由于搭载的多光谱相机仅含有近红外、蓝、绿、红4个波段,基于影像光谱特征云检测方法的优势难以在天绘一号影像上实现;而多时相法[6]云雪检测要求具备同一区域无云影像作为参考,实时性较差;基于高程辅助的云雪检测[11-12]需要通过多幅影像密集匹配得到云的三维几何特征,并需要已知数字高程模型(DEM),前置条件多、操作复杂,应用场景受限。所以目前实际生产中仍利用物理阈值法进行天绘一号影像的云检测。针对以上问题,本文提出一种结合残差网络ResNet[25]及DeepLabV3+[26]的全卷积神经网络的云雪检测方法。DeepLab模型[26-27]是谷歌提出的深度学习语义分割模型, 其编码器-解码器全卷积网络结构以及空洞金字塔池化模块(ASPP)实现了多尺度特征的融合,比FCN更好地利用影像特征进行分割,且较传统方法而言,在特征选择以及提取过程中不依赖先验知识。本文结合ResNet与DeepLabv3+实现了卫星遥感影像云和雪同时检测,通过改进网络结构、引入带孔卷积(arXiv preprint arXiv:1511.07122, 2015)以及使用指数激活函数(ELU)(arXiv preprint arXiv:1511.07289, 2015)、Focal Loss损失函数[28]等方法加快训练收敛,对云层边缘及薄云的检测进行优化,增强了模型泛化能力,提高了模型适用性,能应用于多类型的遥感影像数据。

1 试验数据集 1.1 原始数据选取采用天绘一号卫星2018—2019年采集的遥感影像,考虑到不同地理位置、不同气候条件以及不同时间段影像上的云层特征不同,为保证模型的泛化能力,选取涵盖不同下垫面、不同季节、不同时段的遥感影像共1600景。地理经纬度范围为28°35′E—120°05′E,5°25′N—60°05′N,涵盖了沙漠、草原、城市、山区等不同下垫面情况,另外,为了同时检测云和雪,选取了600景雪地影像。

1.2 数据集建立(1) bmp影像生成。读取天绘一号遥感卫星数据文件,将tif格式四通道数据,保存为分辨率6000×6000的“.bmp”图像。

(2) 影像标记。使用LabelMe程序[29]对每张影像含云区域进行标记,生成Json文件,并将Json文件批量转换为带标签同等大小的带掩模标记影像。

(3) 数据集划分与影像裁切。按照3:1:1的比例将1600景影像划分为训练集、验证集、测试集,由于原始遥感影像幅面较大,占用显存过大,无法直接进入模型中训练,因此,使用自制图像裁切程序将影像分成480×360大小,共生成80 000张影像,其中训练影像48 000张、验证与测试均为16 000张。

(4) 影像预处理。为增强训练模型的泛化能力,防止过拟合,对影像进行增强操作,包括垂直翻转、水平翻转、图像旋转、图像变形、对比度改变等。原图以及增强操作效果如图 1所示。

|

| 图 1 裁切后的原图以及数据增强效果图 Fig. 1 Cutted original image and enhanced images |

2 结合ResNet与DeepLabV3+网络的云雪检测方法 2.1 ResNet网络原理

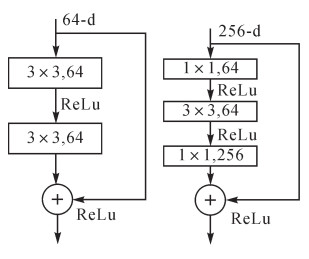

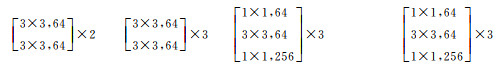

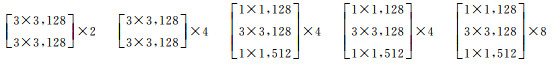

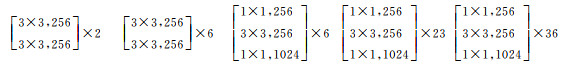

ResNet是文献[25]提出的骨干网络,它运用了残差学习的思想,一定程度解决了传统的CNN在网络层数加深的同时出现的梯度消失、爆炸以及网络退化的问题。ResNet模块通过一个直连通道将输入信息绕道传到输出,保护输入的完整性,整个网络只需要学习输入、输出差别的那一部分,简化网络学习的难度,同时也有利于保留更多的原始语义信息。图 2为ResNet模块示意图[25]。不同网络层数的ResNet网络配置如表 1所示[25]。

2.2 DeepLabV3+模型原理

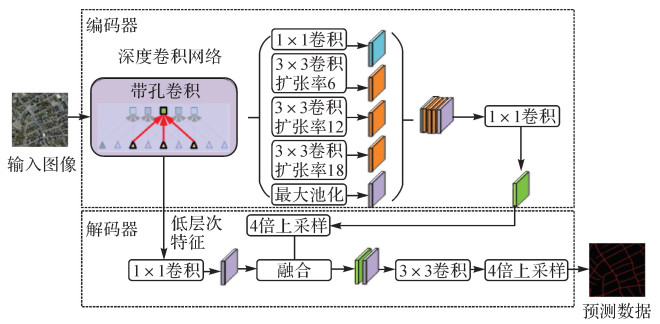

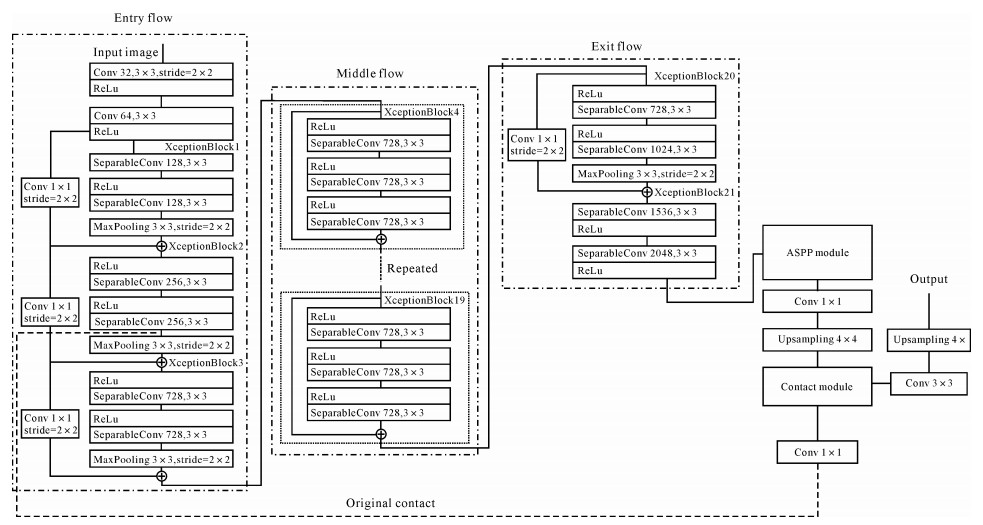

DeepLabV3+模型[26]是在DeepLabV3模型基础上,重新引入编码器—解码器结构,结合Xception骨干网络[30]和空洞空间金字塔(ASPP)模块作为编码器,ASPP使用不同扩张率的带孔卷积提取特征,经过特征融合以及4倍上采样后,在解码器中与Xception提取的低层次特征融合,最后通过3×3卷积以及4倍上采样得到分割结果。得益于Deeplabv3+模型中ASPP的使用,提高了网络多尺度获取语义信息的能力,使得DeepLabV3+在多个数据集上取得了state-of-the-art的成绩。图 3为DeepLabV3+原理图[26]。图 4为DeepLabV3+网络模型图[26]。

如图 4所示,DeepLabV3+是将编码器-解码器和ASPP相结合,获取图像更多边界信息,ASPP可获取更多特征信息。骨干网络使用Xception模块级联而成,使用Xception Block21来获取图像高级语义信息,加入ASPP中。ASPP使用不同扩张率的带孔卷积和全局池化将上采样后的输出融合在一起,作为编码器输出部分。带孔卷积可以提取更密集的特征,捕获多尺度信息,比卷积和池化减少信息丢失。

解码器部分选取Xception中Xception Block2模块池化之前的特征图经过48通道的1×1卷积,实现特征图降维,再将其与经过4倍双线性内插上采样得到的编码器输出进行融合,从而实现高层特征与低层特征的结合,最后通过3×3卷积和4倍双线性内插上采样得到原图大小进行输出。

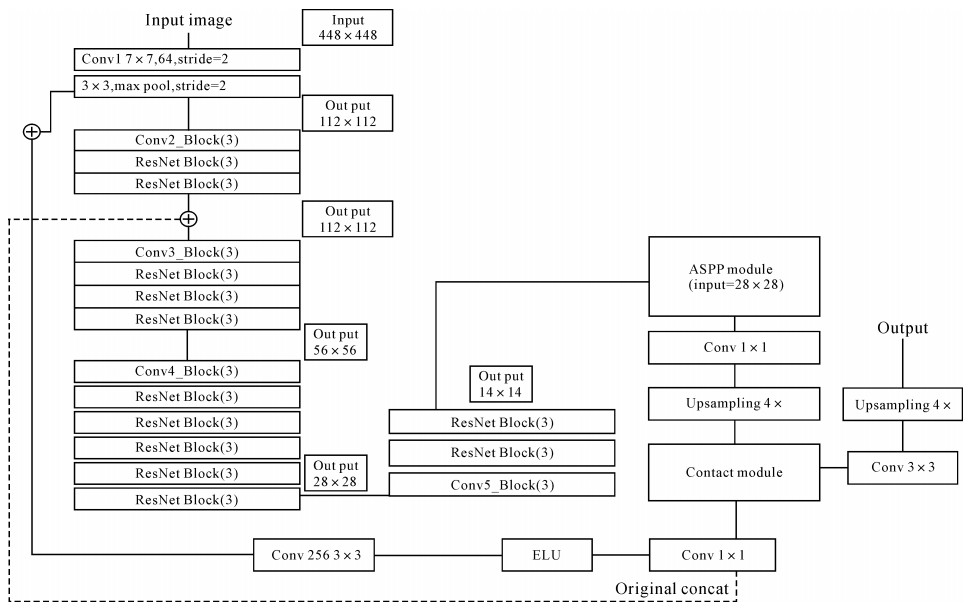

2.3 结合ResNet与DeepLabV3+的网络模型 2.3.1 网络结构云和雪在卫星遥感影像上多呈现面状结构,语义信息简单,但细节信息丰富,这对分割网络的细节提取能力提出了很高要求。传统方法上,云和雪与下垫面的区分是长期以来的难题。而原始DeepLabV3+网络以及其他经典分割网络面对的数据集更加复杂多样,物体特征种类更多、数据量更大,所以使用的骨干网络中的特征提取部分更加复杂,使其能够学习到更复杂的特征模式,如原始DeepLabV3+使用的骨干网络Xception结构,模型参数量为22.8M[26],其复杂的结构和大量的参数适合于物体种类较多的分割任务,但同时带来了庞大的计算量、难以训练等弊端,显然并不完全适合用于云雪检测任务。针对卫星遥感影像上云雪特征,本文将ResNet50骨干网络应用于DeepLabV3+的编码器解码器结构中,作为编码器提取特征。ResNet50网络参数只有0.85M[25],在网络中增加了更多的直连,其与Xception相比具有参数少、易训练、收敛快的特点,另外,在加入带孔卷积之后增大了卷积的感受野,能很好地结合影像的语义信息,且较大幅度提高了运行速度,适用于遥感影像的云雪检测任务,故选择ResNet50作为骨干网络。图 5为本文方法网络模型图。

|

| 图 5 本文方法网络模型 Fig. 5 Network model diagram of the proposed method |

2.3.2 损失函数

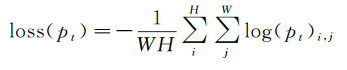

Deeplabv3+网络原始模型中使用的损失函数均为交叉熵(cross entropy,CE),是语义分割中最常用的损失函数。交叉熵的公式如下所示

(1)

(1)

式中,pt为预测结果对应标签的概率。对于语义分割而言,其损失计算是在图像二维矩阵上进行,在使用CE作为损失函数时,其损失值的计算公式如下

(2)

(2)

式中,W为图像宽度;H为图像高度;(pt)i,j为位置(i, j)处对应于该处标签的预测概率。(pt)i, j越接近1,预测结果和标签就越接近,损失值就越小。

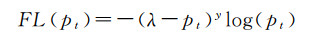

实际中,云的种类多且形状各异,总体上薄云、卷云的比例少于厚云,本文训练数据集也体现出薄云、卷云及雪地数据较少的特点,使用CE Loss不能很好地平衡较少样本的学习。文献[34]通过不同参数的组合,验证了Focal Loss作为损失函数能够解决语义分割任务中样本不均衡的问题。Focal Loss是在CE Loss的基础上改进的,增加了一个权值,其公式如下

(3)

(3)

式中,λ和γ为超参数;pt是标签的预测概率。(λ-pt)可看作式(1)的权值。文献[31]设置γ=2,λ=1,当某类别预测准确,即pt接近于1时,(λ-pt)y的值便接近于0。预测越不准确,也即pt接近于0时,(λ-pt)γ则会接近于1。对于容易区分的样本,其损失对应的权重会较小,而对难以区分的样本,其对应的权重会较大。从而实现保留困难样本的损失值,同时减小简单样本的损失值,强化对少数样本的训练。本文设置γ=2,λ=1。

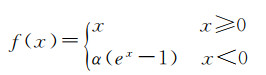

2.3.3 激活函数文献[30]提出了指数线性单元(exponential linear unit,ELU),可以使输出均值接近0,加速网络收敛速度,有效克服梯度消失等问题。假设某节点输出为x,则经过ELU层后的输出f(x)如式(4)所示

(4)

(4)

本文将原始DeepLabV3+网络与ResNet50骨干网络中卷积层后均使用ELU激活函数。

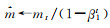

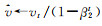

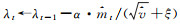

2.3.4 优化器本文采用了Adam优化器(arXiv preprint arXiv:1412, 6980, 2014.)来训练网络参数。该算法可综合考虑梯度的一阶矩估计及二阶矩,动态调整每个参数的学习率。假设f(λ)为关于参数λ的目标函数,α为更新步长,t为迭代步数,λt表示第t次迭代时λ的值,β1, β2∈[0, 1)分别表示一阶矩估计mt和二阶矩估计vt的衰减指数,其优化步骤如下

(1) 初始化λ0←0, m0←0, v0←0, t←0;

(2) while λt不收敛do

(3) t←t+1

(4) gt←▽λft(λt-1)(获取第t步的梯度)

(5) mt←β1·mt-1+(1-β1)·gt(更新一阶矩估计)

(6) vt←β2·vt-1+(1-β2)·diag(gt)gt(更新二阶矩估计,diag(gt)表示gt中元素的对角阵)

(7)

(8)

(9)

(10) end while

(11) return λt

2.3.5 跳跃连接DeepLabV3+中,低层特征来自Xception Block2模块(如图 4虚线所示),由于经过Xception Block1的池化,其输出特征图的边缘信息不如Block1。受其特征金字塔思想启发,本文网络模型如图 5所示,除了将骨干网络替换为ResNet50外,在ResNet50中加入跳跃连接,如图 5加粗实线所示,替换了虚线所示的原始连接,在ResNet50 Block1池化之后,将其特征图通过3×3卷积以及ELU激活函数与原始低层特征经过4倍上采样后融合,低层特征融合后再与ASPP模块的输出融合,最后上采样得到预测图。

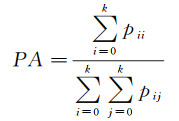

3 试验与分析 3.1 评估标准本文采用平均像素精度和平均交并比作为精度评判标准,采用平均分割时间作为时间评价指标。假设影像中的像素共有k+1类,从L0到Lk,包括1个背景类,pij代表本属于第i类却被分到第j类的像素数量,pii代表的是分类正确的像素数量。本文目的是分割云和雪,故取k=2,共有云、雪、背景3个类别。

像素准确率(PA):最简单直接的指标,仅计算正确分类的像素数量与所有像素数量的比值,计算公式为

(5)

(5)

平均交并比(MIOU):计算的是两个集合的交集与其并集的重合比例,即真实分割与算法分割之间的交并比。这个比例可以被重新定义为真实正例(交集)的数量除以总数量(包括真实正例、错误负例及错误正例(并集))。MIOU即按类计算最后取平均,其计算公式为

(6)

(6)

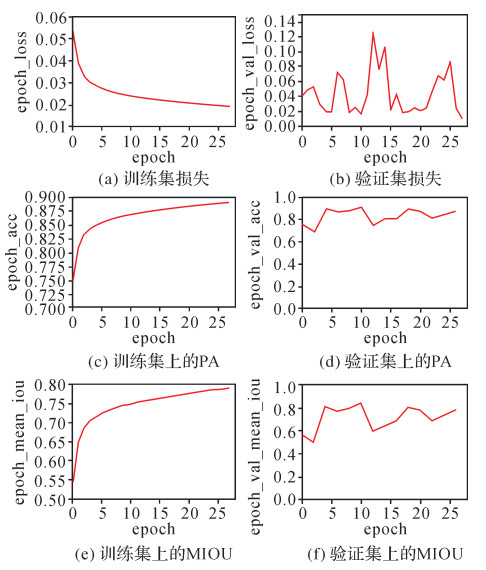

试验硬件为联想深度学习工作站,CPU主频为2.1 GHz的英特尔Xeon处理器,显卡为英伟达Titan xp图形处理器,使用Tensorflow+Keras框架搭建深度学习模型。在数据增强的基础上进行网络训练,初始化学习率设置为3e-4,学习率递减drop设置为0.1,使用ELU激活函数与Adam优化器,根据显卡性能设置batch size(批大小)为8。对改进后的网络训练30个epoch,图 6为训练集和验证集上的Loss和精度对比图。观察曲线,当第25个epoch时,验证集Loss曲线和PA曲线、MIOU曲线均已趋于收敛,最终图 6(a)、(b)训练集和验证集上的损失值分别为0.018 9和0.017 5;图 6(c)、(d)训练集和验证集的PA分别为0.892和0.942,图 6(e)、(f)训练集和验证集的MIOU分别为0.792和0.825。

|

| 图 6 本文方法在训练集和验证集上的Loss和精度对比 Fig. 6 Comparison diagram of Loss and Accuracy on training and validation dataset |

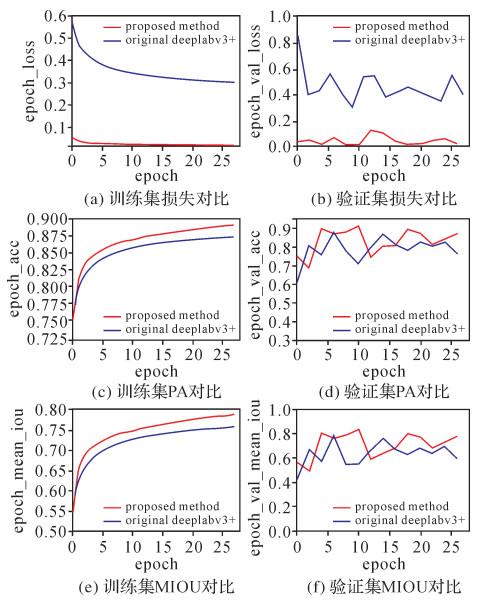

为验证本文方法对于原始DeepLabV3+网络、FCN-8s的优越性,在保持其余参数设置相同的条件下,对原始DeepLabV3+网络、FCN-8s网络训练30个epoch,训练结果对比如表 2所示。训练曲线对比如图 7所示,红色为本文方法结果,蓝色为原始DeepLabV3+网络结果。观察图 7(a)、(b),原始DeepLabV3+网络在训练集和验证集的Loss值均收敛缓慢,第30个epoch训练集和验证集的Loss值分别为0.301和0.443,收敛速度慢且Loss值大于本文方法;分析图 7(c)、(d)的测试集准确率(PA)和图 7(e)、(f)的测试集准确率(MIOU),本文方法略高于原始DeepLabV3+网络。在16 000张影像的验证集上,本文方法的PA为0.942,MIOU为0.895,FCN-8s网络PA为0.845,MIOU为0.791,原始DeepLabV3+网络PA为0.910,MIOU为0.831,在16 000张影像的测试集上,本文方法的PA为0.872,MIOU为0.823,FCN-8s网络PA为0.823,MIOU为0.772,原始DeepLabV3+网络PA为0.854,MIOU为0.802。且本文方法训练耗时为28 h 3 min,耗时低于原始DeepLabV3+网络的40 h 2 min与FCN-8s的29 h 50 min。

| 网络名称 | 验证集准确率(PA) | 验证集准确率(MIOU) | 测试集准确率(PA) | 测试集准确率(MIOU) | 训练耗时 |

| FCN-8s | 0.845 | 0.791 | 0.823 | 0.772 | 29 h 50 min |

| 原始DeepLabV3+ | 0.910 | 0.831 | 0.854 | 0.802 | 40 h 2 min |

| 本文方法(无数据增强) | 0.857 | 0.806 | 0.844 | 0.796 | 27 h 20 min |

| 本文方法 | 0.942 | 0.895 | 0.872 | 0.823 | 28 h 3 min |

|

| 图 7 本文方法与原始DeepLabV3+训练结果对比 Fig. 7 Training result comparison diagram of the proposed method and original DeepLabV3 |

为验证数据增强对训练结果的影响,增加了无数据增强条件下的本文方法试验结果,如表 2所示,试验证明,在略微增加训练耗时的同时数据增强提升了验证集和测试集超过3%的MIOU准确率。

3.3 对比与分析首先,对测试集结果进行整体分析,对比本文方法与传统方法、深度学习方法的结果差异。深度学习方法的采用FCN-8s网络与原始DeepLabV3+网络。在16 000张影像的测试集里,本文方法得到的云雪检测MIOU准确率为82.3%,预测总耗时为787 s,平均每张影像耗时49.2 ms;传统Otsu法分割单张影像耗时0.81 s,且无法一次性分割出云和雪,处理16 000影像总耗时约为216 min;FCN-8s网络在16 000张影像的测试集里得到的MIOU准确率为77.2%,平均每张影像耗时27.3 ms,原始DeepLabV3+网络在16 000张影像的测试集里得到的MIOU准确率为80.2%,预测耗时956 s,平均每张影像耗时59.7 ms。可见,本文方法比传统Otsu法预测耗时短,比FCN-8s网络及原始DeepLabV3+网络训练耗时短,预测精度高。

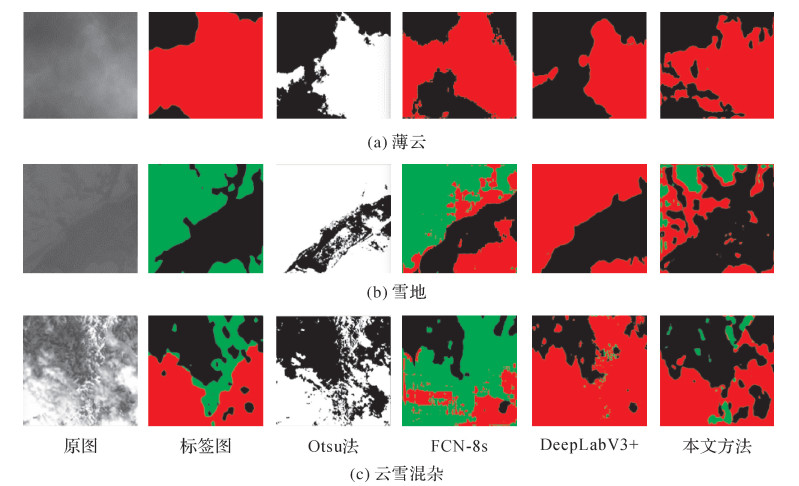

其次,采用典型影像对比试验的方法,对比本文方法与传统方法、深度学习的方法的结果差异(红色代表云,绿色代表雪)。图 8为传统阈值分割Otsu法、FCN-8s网络、原始DeepLabV3+网络的处理结果与本文方法的处理结果对比,可以发现,当影像光照条件不理想、下垫面对比度不高时,Otsu法效果不理想,在图 8(a)中云薄云的检测上出现漏检,在图 8(b)中雪的检测上出现了误检。究其原因,Otsu算法分割时未考虑邻域信息,对噪声敏感。FCN-8s网络在图 8中均出现了大面积误检、漏检,总体表现出泛化性能不强、对边缘细节不敏感的特征。而原始DeepLabV3+网络在图 8(a)薄云的检测上出现漏检,且图像边缘的检测上不够理想,另外在图 8(b)雪地的检测上和本文方法均出现错误,但本文方法能识别出部分雪地,在图 8(a)中保留了更多的薄云细节特征,在图 8(c)云雪混杂区域中,单次运行Otsu法不能区分云和雪,原始DeepLabV3+网络出现过分割,且基本没有检测出雪地,本文方法能够同时检测出云和雪地。

|

| 图 8 Otsu算法、原始DeepLabV3+网络与本文方法的分割结果对比 Fig. 8 Segmentation result comparison diagram of Otsu method, original DeepLabV3+ and the proposed method |

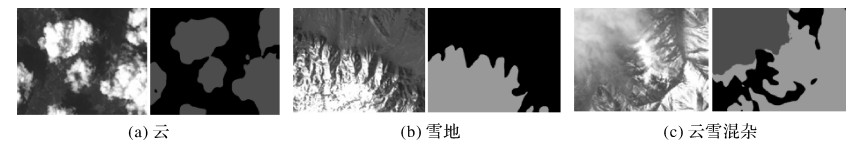

为验证本文方法的泛化性能,在不同时相的天绘一号影像上进行测试,结果如图 9所示。可以发现,本文方法能够准确检测出云和雪,泛化性能良好。

|

| 图 9 在不同时相获取的天绘一号影像上的测试结果 Fig. 9 Testing result diagram of the proposed method on TH-1 image acquired from different time |

4 结论

长期以来,遥感图像云检测是遥感图像处理中的一个非常基础且重要的工作。本文提出了一个结合ResNet和DeepLabV3+网络优点、端到端的天绘一号遥感卫星云雪检测网络,一方面避免了传统云检测算法需要人工设置阈值、检测耗时长、前置条件多等的不足,在16 000张天绘一号卫星影像测试集上取得82.3%MIOU准确率,单张480×360大小的影像检测时间缩短到49.2 ms,基本实现了影像预处理要求,并且能够同时识别云和雪,为卫星影像的深层次应用作了铺垫。另一方面,针对DeepLabV3+网络参数多、训练耗时长、收敛效果较差等问题进行了优化改进,将骨干网络替换为ResNet50,并且在ResNet模块中引入带孔卷积,使用了一种适用于云雪分割任务的Focal Loss损失函数以及ELU激活函数,在数据增强的基础上进行网络训练,一定程度解决了传统算法难以识别薄云以及深度学习中小样本的学习问题,全自动化处理避免了专家知识和人为干预,极大地节省了天绘一号卫星影像质量检查与数据分发时间,提高了工作效率,在与原始DeepLabV3+、FCN-8s的对比试验中可以看出本文方法精度更高、速度更快。

由于深度学习技术是数据驱动技术,对于本文依赖的天绘一号卫星影像而言,在一定时期内获取的影像特征相似度较高,特征分布类似,能够利用深度神经网络学习得到,因此本文方法的适应性能良好。而对于不同来源的卫星遥感影像上,需将该类型数据加入训练集并对网络训练进行微调。本文所提出的云雪检测算法还有进一步改进的空间,比如,进一步提高训练精度,使用额外的多源遥感影像进行迁移学习增强泛化能力等。笔者下一步将利用多光谱遥感信息进一步解决云、雾、雪混杂区域的分割问题以及后续的分析处理,并融入实际工业生产当中。

| [1] |

ZHU Z, WOODCOCK C E. Automated cloud, cloud shadow, and snow detection in multitemporal Landsat data:an algorithm designed specifically for monitoring land cover change[J]. Remote Sensing of Environment, 2014, 152: 217-234. |

| [2] |

胡健.遥感影像的云雪检测算法与地表反射率库构建算法研究[D].郑州: 河南大学, 2017. HU Jian. Study on algorithm of cloud-snow detection and algorithm of surface reflectivity library for remote sensing image[D]. Zhengzhou: Henan University, 2017. |

| [3] |

KEGELMEYER W P JR. Extraction of cloud statistics from whole sky imaging caemeras[R]. Livermore, CA, United States: Sandia National Labs, 1994.

|

| [4] |

ACKERMAN S, STRABALA K, MENZEL W P, et al. Discriminating clear sky from clouds with MODIS[J]. Journal of Geophysical Research:Atmospheres, 1998, 103(D24): 32141-32157. |

| [5] |

高贤君, 万幼川, 郑顺义, 等. 航空摄影过程中云的实时自动检测[J]. 光谱学与光谱分析, 2014, 34(7): 1909-1913. GAO Xianjun, WAN Youchuan, ZHENG Shunyi, et al. Real-time automatic cloud detection during the process of taking aerial photographs[J]. Spectroscopy and Spectral Analysis, 2014, 34(7): 1909-1913. |

| [6] |

陈曦东, 张肖, 刘良云, 等. 增强型多时相云检测[J]. 遥感学报, 2019, 23(2): 280-290. CHEN Xidong, ZHANG Xiao, LIU Liangyun, et al. Enhanced multi-temporal cloud detection algorithm for optical remote sensing images[J]. Journal of Remote Sensing, 2019, 23(2): 280-290. |

| [7] |

WANG Mi, ZHANG Zhiqi, DONG Zhipeng, et al. Stream-computing of high accuracy on-board real-time cloud detection for high resolution optical satellite imagery[J]. Journal of Geodesy and Geoinformation Science, 2019, 2(2): 50-59. DOI:10.11947/j.JGGS.2019.0206 |

| [8] |

卞春江, 侯晴宇, 赵晓, 等. 特征空间线性降维压缩遥感图像云检测方法[J]. 哈尔滨工业大学学报, 2014, 46(1): 29-33. BIAN Chunjiang, HOU Qingyu, ZHAO Xiao, et al. Cloud detection in remote sensing image based on linear dimension compression[J]. Journal of Harbin Institute of Technology, 2014, 46(1): 29-33. |

| [9] |

沈金祥, 季漩. 遥感影像云及云影多特征协同检测方法[J]. 地球信息科学学报, 2016, 18(5): 599-605. SHEN Jinxiang, JI Xuan. Cloud and cloud shadow multi-feature collaborative detection from remote sensing image[J]. Journal of Geo-Information Science, 2016, 18(5): 599-605. |

| [10] |

单娜, 郑天垚, 王贞松. 快速高准确度云检测算法及其应用[J]. 遥感学报, 2009, 13(6): 1138-1155. SHAN Na, ZHENG Tianyao, WANG Zhensong. High-speed and high-accuracy algorithm for cloud detection and its application[J]. Journal of Remote Sensing, 2009, 13(6): 1138-1155. |

| [11] |

邱实.多光谱卫星遥感影像云及云阴影精准检测算法研究[D].成都: 电子科技大学, 2018. QIU Shi. Accurate cloud and cloud shadow detection in multispectral remote sensing images[D]. Chengdu: University of Electronic Science and Technology of China, 2018. |

| [12] |

SHI Tao, YU Bin, CLOTHIAUX E E, et al. Daytime arctic cloud detection based on multi-angle satellite data with case studies[J]. Journal of the American Statistical Association, 2008, 103(482): 584-593. |

| [13] |

AMATO U, ANTONIADIS A, CUOMO V, et al. Statistical cloud detection from SEVIRI multispectral images[J]. Remote Sensing of Environment, 2008, 112(3): 750-766. |

| [14] |

MERCHANT C J, HARRIS A R, MATURI E, et al. Probabilistic physically based cloud screening of satellite infrared imagery for operational sea surface temperature retrieval[J]. Quarterly Journal of the Royal Meteorological Society, 2005, 131(611): 2735-2755. |

| [15] |

赵晓.高分辨率卫星遥感图像云检测方法研究[D].哈尔滨: 哈尔滨工业大学, 2013. ZHAO Xiao. Study on cloud detection method for high resolution satellite remote sensing image[D]. Harbin: Engineering of Harbin Institute of Technology, 2013. |

| [16] |

陈洋, 范荣双, 王竞雪, 等. 基于深度学习的资源三号卫星遥感影像云检测方法[J]. 光学学报, 2018, 38(1): 354-359. CHEN Yang, FAN Rongshuang, WANG Jingxue, et al. Cloud detection of ZY-3 satellite remote sensing images based on deep learning[J]. Acta Optica Sinica, 2018, 38(1): 354-359. |

| [17] |

SHELHAMER E, LONG J, DARRELL T. Fully convolutional networks for semantic segmentation[J]. IEEE Transactions on Pattern Analysis and Machine Intelligence, 2014, 39(4): 640-651. |

| [18] |

XIE Fengying, SHI Mengyun, SHI Zhenwei, et al. Multilevel cloud detection in remote sensing images based on deep learning[J]. IEEE Journal of Selected Topics in Applied Earth Observations and Remote Sensing, 2017, 10(8): 3631-3640. |

| [19] |

SHAO Zhenfeng, PAN Yin, DIAO Chunyuan, et al. Cloud detection in remote sensing images based on multiscale features-convolutional neural network[J]. IEEE Transactions on Geoscience and Remote Sensing, 2019, 57(6): 4062-4076. |

| [20] |

刘波, 邓娟, 宋杨, 等. 基于卷积神经网络的高分辨率遥感影像云检测[J]. 地理空间信息, 2017, 15(11): 12-15. LIU Bo, DENG Juan, SONG Yang, et al. Cloud detection method for high-resolution remote sensing image based on convolutional neural network[J]. Geospatial Information, 2017, 15(11): 12-15. |

| [21] |

裴亮, 刘阳, 谭海, 等. 基于改进的全卷积神经网络的资源三号遥感影像云检测[J]. 激光与光电子学进展, 2019, 56(5): 226-233. PEI Liang, LIU Yang, TAN Hai, et al. Cloud detection of ZY-3 satellite remote sensing images based on improved fully convolutional neural networks[J]. Laser & Optoelectronics Progress, 2019, 56(5): 226-233. |

| [22] |

朱清, 侯恩兵. 基于生成式对抗网络的遥感影像云检测方法[J]. 地理空间信息, 2018, 16(5): 19-22. ZHU Qing, HOU Enbing. Remote sensing image cloud detection method based on generative adversarial networks[J]. Geospatial Information, 2018, 16(5): 19-22. |

| [23] |

徐启恒, 黄滢冰, 陈洋. 结合超像素和卷积神经网络的国产高分辨率遥感影像云检测方法[J]. 测绘通报, 2019(1): 50-55. XU Qiheng, HUANG Yingbing, CHEN Yang. Cloud detection for Chinese high resolution remote sensing imagery using combining superpixel with convolution neural network[J]. Bulletin of Surveying and Mapping, 2019(1): 50-55. DOI:10.13474/j.cnki.11-2246.2019.0010 |

| [24] |

李松明, 李岩, 李劲东. "天绘一号"传输型摄影测量与遥感卫星[J]. 遥感学报, 2012, 16(S1): 10-16. LI Songming, LI Yan, LI Jindong. Mapping Satellite-1 transmission type photogrammetric and remote sensing satellite[J]. Journal of Remote Sensing, 2012, 16(S1): 10-16. |

| [25] |

HE Kaiming, ZHANG Xiangyu, REN Shaoqing, et al. Deep residual learning for image recognition[C]//2016 IEEE Conference on Computer Vision and Pattern Recognition (CVPR). Las Vegas, NV: IEEE, 2016.

|

| [26] |

CHEN L C, ZHU Y, PAPANDREOU G, et al. Encoder-decoder with atrous separable convolution for semantic image segmentation[C]//Proceedings of the European conference on computer vision (ECCV).Munich, Germany: IEEE, 2018: 801-818.

|

| [27] |

CHEN L C, PAPANDREOU G, KOKKINOS I, et al. DeepLab:semantic image segmentation with deep convolutional nets, atrous convolution, and fully connected CRFs[J]. IEEE Transactions on Pattern Analysis and Machine Intelligence, 2018, 40(4): 834-848. |

| [28] |

LIN T Y, GOYAL P, GIRSHICK R, et al. Focal loss for dense object detection[C]//2017 IEEE International Conference on Computer Vision (ICCV).Venice, Italy: IEEE, 2017: 2999-3007.

|

| [29] |

RUSSELL B C, TORRALBA A, MURPHY K P, et al. LabelMe:a database and web-based tool for image annotation[J]. International Journal of Computer Vision, 2008, 77(1-3): 157-173. |

| [30] |

CHOLLET F. Xception: deep learning with depthwise separable convolutions[C]//2017 IEEE Conference on Computer Vision and Pattern Recognition (CVPR).Honolulu, HI, USA: IEEE, 2016.

|

| [31] |

杨威, 张建林, 徐智勇, 等. 一种改进的Focal Loss在语义分割上的应用[J]. 半导体光电, 2019, 40(4): 555-559. YANG Wei, ZHANG Jianlin, XU Zhiyong, et al. An improved focal loss function for semantic segmentation[J]. Semiconductor Optoelectronics, 2019, 40(4): 555-559. |