道路交叉口是构成路网的基础与核心要素,作为道路网络的节点,起到了连接道路和承载转向的重要作用[1]。目前,车辆轨迹与遥感影像由于其覆盖范围广、更新周期短、获取成本低,成为道路交叉口识别研究的主要数据源。一方面,轨迹数据频率较低、噪音大,且在路网上分布不均,而遥感影像易受天气与光照影响,且存在地物遮挡或混淆等现象[2];另一方面,道路交叉口结构复杂、形态多样、大小不一,且相邻交叉口可能相距较近,因此提取道路交叉口是一项非常具有挑战性的工作[3]。为此,学者们利用易于获得的车辆轨迹或者遥感影像,在道路交叉口识别方面开展了大量研究工作,取得了较为丰硕的研究成果。

基于车辆轨迹的道路交叉口识别一般可分为两类:一类是基于交叉口处的几何、拓扑特征,从轨迹中直接提取交叉口。例如,文献[4—5]基于轨迹中的转向点对,通过距离和角度对其聚类后提取交叉口;文献[6]利用G统计对各轨迹相交的角度进行热点分析,以区分交叉口与非交叉口;文献[7]基于形状描述训练出交叉口分类器,以区分交叉口与非交叉口。另一类是以路网结构为导向的交叉口识别,依据交叉口是多条路段的交汇点这一特征,先识别道路,再识别交叉口[8-11]。例如,文献[8]首先将轨迹数据栅格化为图像,然后利用核密度估计等法探测道路区域,最后通过形态学分析获取骨架线,再据此提取交叉口位置;文献[12]则集成上述两类方法的优势,融合密度峰值聚类和形态学分析进行交叉口识别。

基于遥感影像的道路交叉口识别主要包括基于交叉口的特征提取方法和基于道路的交叉口提取方法。前者利用原始影像上交叉口的表征形式直接提取交叉口,常见方法包括基于模板匹配[13]、基于形状约束[14]、可变模型部件模型检测[15],以及深度神经网络模型识别[16];后者则是在提取得的道路二值图的基础上进行交叉口检测[17-19],例如,文献[18]先使用分割算法从遥感影像中提取道路二值图,再通过张量投票检测出道路二值图中的交叉点的位置作为道路交叉口。

由于单一数据的描述能力有限,上述的交叉口提取方法难以做到交叉口的全面提取。基于车辆轨迹的交叉口提取方法可以利用交叉口处轨迹特有的空间位置特征和动态连接特征,但由于车辆轨迹空间分布不均匀,无法识别轨迹稀疏区域的交叉口,且存在将大转弯区域的道路误识别为交叉口的情况;遥感影像覆盖面广,但在场景复杂或受遮挡的区域,交叉口的识别精度较低。而车辆轨迹可以弥补遥感影像中交叉口受其他地物影响的问题,遥感影像可以补充在轨迹稀疏或缺失处的交叉口信息。为了全面、精确地获取道路交叉口,有必要综合车辆轨迹与遥感影像各自优势来提取交叉口。为此,本文提出了一种基于车辆轨迹和遥感数据多层次融合的道路交叉口识别方法。首先,分析道路交叉口区域区别于其他区域的显著差异性特征,融合多元方法的交叉口提取结果,得到高质量的种子交叉口,并以此作为下一阶段小样本集的标注;然后,利用协同训练机制开展车辆轨迹分类模型和遥感影像分类模型的多次迭代训练,从而在种子交叉口的基础上逐步扩充训练集的规模,以有效提升两分类模型的分类能力;最后,设计基于车辆轨迹分类模型和遥感影像分类模型的集成识别方法,以提升交叉口提取的整体性能。

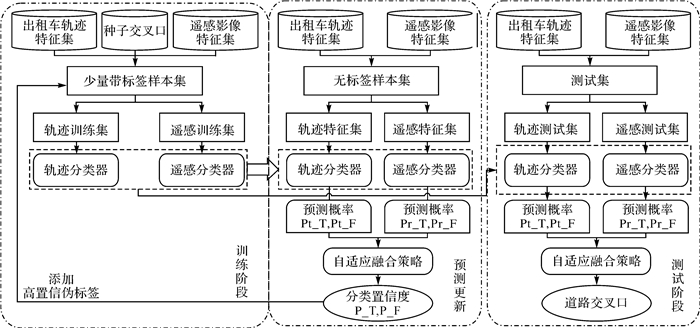

1 研究方法本文提出的研究方法总体框架如图 1所示:①种子交叉口提取,利用车辆轨迹的空间分布特征和隐含的动力学特征,以及遥感影像的视觉特征,分别通过形态学法、聚类法及张量投票法[19]进行交叉口提取,融合多元方法结果获取高置信的种子交叉口,并据此生成小样本集;②基于协同训练轨迹机制,分别构建车辆轨迹与遥感影像的交叉口分类器,并对两个分类器进行初步训练后,对无标签数据进行概率预测,从中选择高置信的伪标签加入训练集中,再次对两分类模型进行训练,如此迭代多次,以优化两分类器彼此的性能;③集成两分类模型的结果作为最终交叉口识别结果。

|

| 图 1 本文研究方法的总体框架 Fig. 1 The framework of our method |

1.1 种子道路交叉口提取

考虑到深度学习模型的效果依赖于训练集的规模与质量,而手动标注样本存在人为主观性,且耗时又烦琐[20],本文采用多元方法集成获取的种子交叉口作为标注。具体来说,通过分析车辆轨迹和遥感影像关于交叉口的多模特征,设计多元提取方法并进行结果融合,获取少量高置信的种子交叉口,据此形成少量样本集。为确保种子交叉口的正确性,在其提取过程中遵循“真交叉口可遗漏,伪交叉口不可引入”的原则。

1.1.1 基于车辆轨迹的交叉口提取车辆轨迹既包括空间分布特征,也包括隐含的动力学特征,为此,基于车辆轨迹提出两类交叉口提取方法:①在栅格空间中,分析轨迹在路网上的静态几何分布,先提取道路中心线再检测交叉口;②在矢量空间中,利用速度、方向及大转向点对等隐含动力学特征,从轨迹的点序列中直接提取交叉口。

在栅格空间中,车辆轨迹按照某一分辨率栅格化后形成栅格特征图。受轨迹噪音影响,直接采用形态学处理来提取道路中心线将出现大量毛刺,从而带来大量伪交叉口。去除毛刺处理流程为:首先,利用Roberts边缘算子提取道路边缘,并将其从特征图中剔除,从而获取具有平滑边缘的道路二值图;然后,在其基础上进行数学形态学开闭运算以及细化操作,用于获取道路中心线;最后,计算中心线上各个像素的连通度,将连通度大于2的像素标记为交叉点后,通过矢量化获取交叉口的位置。其中,连通度定义为某像素其八邻域内像素值不为零的像素个数。

车辆在通过道路交叉口时常伴随着显著的方向变化,通过限制连续采样点的方向、速度及距离可筛选出大转向角的轨迹片段。但由于本文所采用的为出租车轨迹,其轨迹点间隔较大,计算得到的大转向轨迹点多落在与交叉口相接的路段上,使其聚类结果不一定位于交叉口区域。针对这一问题,本文采用文献[3]提出的反向交叉点代替大转向对,以确保多数待聚类点位于交叉口区域,然后通过密度峰值法确定各聚类簇中交叉口点的位置。

1.1.2 基于遥感影像的交叉口提取遥感影像中道路交叉口轮廓特征不明显,且交叉口本身结构复杂、形态多样,基于遥感影像直接识别较为困难。在文献[18]的基础上,进一步发展了两阶段式的交叉口提取方法,即首先获取道路二值图,然后从中检测出交叉口。

在道路二值图的提取过程中,考虑到深度学习是基于遥感影像进行道路提取的主流技术,且效果远优于传统方法。为此,选择在Deep Globe道路识别竞赛中取得第1名的D-LinkNet[21],采用其训练好的模型提取道路二值图;道路交叉口在地理空间中表现为点状特征,考虑到由文献[22]提出的张量投票算法能够从二维或三维数据中检测出交叉点,曲线以及曲面等几何结构,且该算法被广泛应用于道路交叉口提取中[18-19], 故引入张量投票算法从道路二值图中检测交叉口,其主要步骤如下。

(1) 道路二值图的张量表达,由于分割得到的道路二值图中的像素点没有方向性,因此,对所有道路像素点进行无方向性的球张量编码,即对每个道路像素编码为大小为2的单位矩阵。

(2) 非线性投票,对所有编码点进行稀疏投票和稠密投票。

(3) 张量分解,两次投票后,通过张量分解的计算式(1),获取交叉口区域的显著图λ2

(1)

(1)

式中,Ts为棒状张量分量;(λ1-λ2)为棒状张量分量的显著性特征;Tb为球状张量分量;λ2为球状张量分量的显著性特征;当λ1≈λ2>0时,得到球状张量分量的显著性特征λ2。

(4) 交叉口点位置的提取,采用非极大值抑制法获取λ2中各交叉口区域的中心点后,再通过矢量化获取交叉口中心点的坐标。

1.1.3 种子交叉口提取总的来说,上述多元交叉口提取方法分为两类:①假设道路交汇处为交叉口,包括基于车辆轨迹通过形态学方法的交叉口提取和基于遥感影像通过张量投票方法的交叉口提取;②假设在交叉口处车辆轨迹会产生大的转向角,如基于轨迹动态特征通过聚类生成交叉点。然而仅基于其中一类方法获取的交叉口置信度较低,如一些空间上交叠的立交桥并不存在联通,弯曲状道路也存在大的转向对。但若某区域基于上述两类方法均被判定为交叉口,那么该区域为真交叉口的置信度将大大提升。为此,设计下述融合策略来获取高置信的种子交叉口。

(1) 以轨迹动态特征聚类提取的交叉口位置为基准点做半径为R的缓冲区。

(2) 统计缓冲区内基于车辆轨迹通过形态学处理和基于遥感影像通过张量投票检测出的交叉口个数。

(3) 若缓冲区内的交叉口点个数大于0,则计算它们几何位置中心,作为种子交叉口点位置。

(4) 若其缓冲区内交叉口点个数为0,则舍弃该基准点。

1.2 融合车辆轨迹与遥感影像的协同训练及集成识别训练集规模是深度学习模型效果的重要保障,为了达到利用少量种子样本集学习出大量样本数据的目的,本文基于半监督学习思想,设计了协同训练机制来扩充道路交叉口的训练样本数量:首先,利用少量种子样本集分别训练车辆轨迹和遥感影像两种不同的分类网络,并对无标签数据的置信度进行评估;然后,将计算的高置信输出加入训练集,对两个分类器更新训练,经过不断循环迭代,达到利用少量标签道路交叉口样本学习大量样本数据的效果,提升了两分类器的识别能力。

1.2.1 协同训练与集成识别框架协同训练算法是一种半监督学习方法,训练的过程中仅利用少量的带标签样本以及两个关于目标的独立且冗余视图,就可以将无标签数据自动标注为训练样本,使得大量无标签数据可以得到应用[23]。车辆轨迹和遥感影像提供了关于道路交叉口独立且互补的特征图,且在1.1节中获取了少量样本的标签,在此基础上,本文提出了车辆轨迹与遥感影像的协同训练框架,如图 2所示。

|

| 图 2 车辆轨迹与遥感影像的协同训练框架 Fig. 2 Co-training framework of vehicle trajectory and remote sensing image |

基于车辆轨迹数据和遥感影像的道路交叉口提取的协同训练机制分为3个阶段:训练阶段、预测更新阶段和测试阶段。

在训练阶段中,应用轨迹训练集和遥感训练集训练两个神经网络。其中,考虑到道路交叉口提取是判断某个位置点是否属于道路交叉口,属于二分类问题,故针对轨迹和遥感数据其特征图的特点,设计两个不同的深度学习网络作为道路交叉口分类器。需要注意的是,在初始少量带标签样本集的制作时,基于种子交叉口仅能获取正样本。为确保小样本中的正负样本的数量均衡,本文提出负样本的制作方法,具体为以正样本为位置点为基础,考虑交叉口本身大小、相邻交叉口之间的距离,设置与正样本的位置点相聚一定距离的位置为非交叉口,以获取负样本集。

预测更新阶段是利用两个有差异的特征图和分类器提供伪标签数据加入训练集,使得两分类器可迭代优化彼此的性能,从而使训练的两分类器是两类数据综合优化的结果。具体步骤为:

(1) 基于同一位置的轨迹和遥感的无标签样本,应用相应的分类器分别进行预测,得到基于轨迹特征的正负样本预测概率值分别为Pt_T、Pt_F,基于遥感特征的正负样本预测概率值分别为Pr_T、Pr_F,根据分类器对分类精度的贡献,对两分类器结果进行自适应加权融合,获取样本为正负样本分类置信度分别为P_T、P_F。

(2) 挑选出分类置信度不低于V的样本,并将其打上预测的高置信伪标签后,添加到有标签样本集中,同时将它们从无标签数据集中移除,之后再对两分类器进行训练。

(3) 当从无标签数据预测结果中筛选不出预测概率值大于V的样本时,停止迭代。

在测试阶段,根据待测试点的位置,基于轨迹特征和遥感影像分别生成测试集,利用优化好的车辆轨迹的交叉口分类器和遥感影像分类器分别进行分类预测。由于这两个分类器有一定的差异,即对相同的样本可能输出不同的预测结果。通过自适应加权的方法融合两个分类器的结果,可以进一步判断差异性输出,获取正确的预测结果。

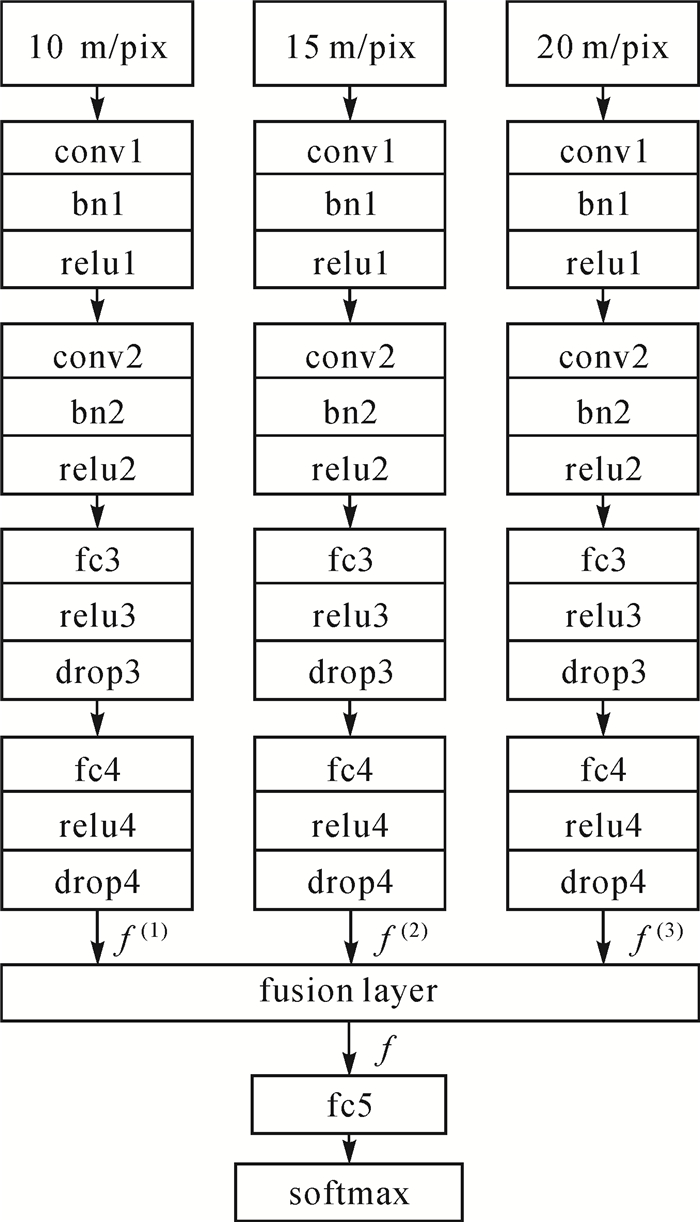

1.2.2 基于车辆轨迹的交叉口分类交叉口提取实际是一个二分类问题,即判断输入点是否为交叉口。但城市中道路交叉口面积不等,难以在固定分辨率下,使用某一格网来捕获交叉口,为此,本文对输入的交叉口位置点采用多尺度信息描述,通过融合多尺度的特征获取分类结果。又考虑到道路交叉口不是一个孤立的点,其与周围的环境息息相关[24],将网络的输入设定为包含其周围的邻域格网信息的特征图,所设计的车辆轨迹的交叉口分类器模型如图 3所示。

|

| 图 3 车辆轨迹的交叉口分类器模型 Fig. 3 Intersection classifier model of vehicle trajectory |

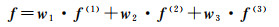

网络包括3个支路,每个支路代表特定分辨率下的交叉口提取,分支的结构相同,均由两个卷积核为3,步长为1,填充为0的卷积层,以及两个全连接层组成。鉴于输入图像的大小过小,不对图像进行降采样。3个分支的特征图通过自适应加权的方式融合后,得到作为第5个全连接层的输入f,融合方式如下

(2)

(2)

式中,f(1)、f(2)及f(3)为3个分支的特征图;w1、w2及w3为3个特征图对应的自适应权重,初始值设置为1,自适应权重通过网络学习获得。

网络的每一支输入均包括轨迹点栅格图、密度图、邻接轨迹点转向图以及朝向香农熵图。其中,轨迹点栅格图反映道路的几何分布的,计算方法为直接栅格化;密度图反映由于红绿灯道路交叉口处产生停留聚集的,计算方法为统计格网内轨迹点个数;邻接轨迹点转向图表示格网是否承当转向功能的,计算方式为统计落入格网内所有轨迹点其上一个轨迹点与下一个轨迹点的方向差值后,计算方向差值的标准差,标准差越大说明通过该格网的车辆的行为模式差异越大;朝向香农熵图[25]代表格网内车辆朝向信息复杂程度,按照式(3)计算得到

(3)

(3)

式中,n为等间隔角度的数目;pi是属于第i个间隔的航向角的比例。

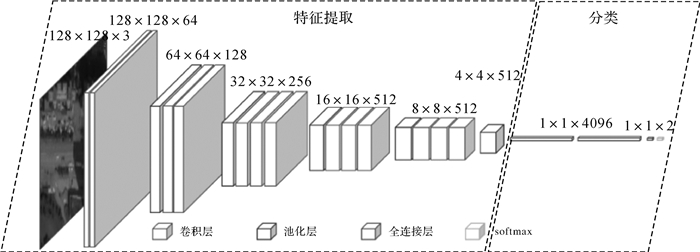

1.2.3 基于遥感影像的交叉口分类相对于车辆轨迹特征图来说,遥感影像中蕴含的地物信息更为复杂,很难从较小规模的初始样本集直接训练出交叉口分类模型,为此,本文采用迁移学习的策略,即在基于ImageNet训练好的VGG16网络的基础上,通过微调获取遥感影像的交叉口分类模型。具体为冻结用于提取图像特征的卷积层,对用于提取特定类别特征的全连接层进行微调。使用的遥感影像的交叉口分类器如图 4遥感影像的交叉口分类器所示。特征提取部分由13个3×3的卷积层和5个2×2的池化层组成,分类部分由3个全连接层构成,其中最后一层全连接层由VGG16原来的1000个神经元修改为2个神经元,用于输出道路交叉口分类二分类结果。

|

| 图 4 遥感影像的交叉口分类器 Fig. 4 Intersection classifier of remote sensing image |

1.2.4 自适应加权的分类模型集成

由于车辆轨迹和遥感影像对道路交叉口的描述角度不同,且两分类器所应用的深度神经网络结构不同,这就造成在使用两分类器对同一样本进行预测时,可能会出现不一致的结果。为了获取唯一的高置信预测结果,本文结合两个分类器预测结果的差异性对样本置信度的影响,根据自适应加权融合策略[26]融合两分类器的预测结果,从而集成两分类器优势,提升预测结果的置信度。其中,权重值按照分类器的类别精度的贡献确定,自适应加权融合的计算如下

(4)

(4)

式中,P(k)是第k个类别的融合预测值;k共计两类,交叉口和非交叉口;Pt(k)和Pr(k)分别是轨迹分类器和遥感分类器输出的第k个类别的预测值;w(k)是轨迹分类器输出的第k个类别的权重,其大小依赖于轨迹分类器对图像属于第k个类别的分类精度的贡献,该权重的计算共分为两步:

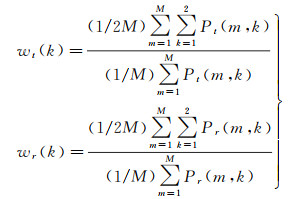

(1) 根据式(5)计算两个分类器关于类别k的归一化似然值wt(k)和wr(k)

(5)

(5)

式中,M是测试样本总个数;2为总的类别数;Pt(m, k)和Pr(m, k)是两分类器将第m个样本预测为类别k的概率值;分子表示类别k的总的平均似然;分母是类别k的平均似然。

(2) 根据式(6)输出最终的权重值w(k)

(6)

(6)

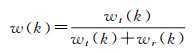

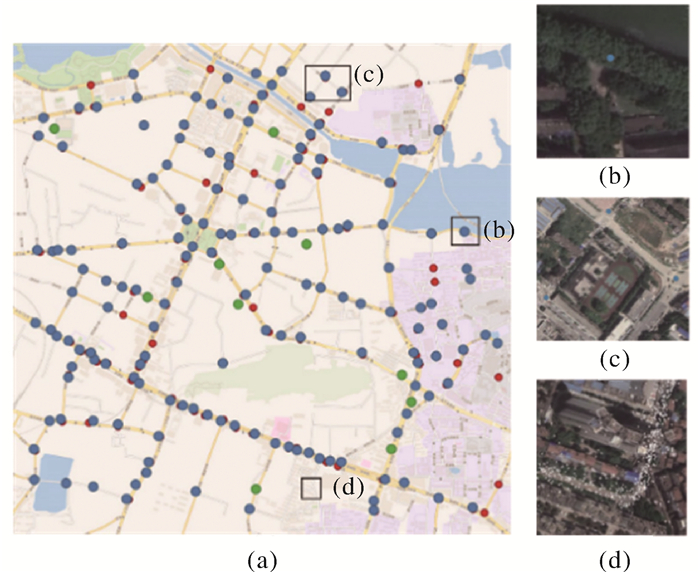

本文所采用的轨迹试验数据为武汉市区出租车一周的轨迹数据,轨迹点数据量约为1.96 GB。车辆轨迹数据集包含7个字段,具体为:车辆的编号、时间、经度、纬度、瞬时速度、瞬时方向角和状态。由于轨迹数据来源于出租车,其轨迹点大多落于主要道路,支路上的轨迹点覆盖度较低或没有轨迹点,如图 5(a)红色框所示。本文所采用的遥感影像从谷歌地球获取,其空间分辨率约为0.5 m。为方便计算,将遥感影像降采样到空间分辨率1 m,坐标系统转换至WGS-84坐标系,使其与轨迹数据保持一致。研究区域的遥感影像中包含多类型,不同大小的道路交叉口,且一些交叉口存在被树木的遮挡的情况,如图 5(b)蓝色框所示。

|

| 图 5 研究区域数据集 Fig. 5 Study area data set |

在应用本文提出的交叉口提取方法进行试验的过程中,涉及参数值包括:①种子交叉口提取阶段,轨迹形态学法中的栅格化图像的空间分辨率为5 m,选用较低分辨率便于提取轨迹稀疏区域的交叉口;车辆轨迹聚类法中,在计算转向对时,筛选出的转向对需满足轨迹点速度小于30 km/h,相邻轨迹点距离小于200 m及时间间隔小于20 s。在进行转向对的反向点聚类时,聚类距离为70 m;遥感影像张量投票法中,非极大值抑制的阈值为70 m;多模方法融合中,融合半径R为50 m。②协同训练阶段,轨迹分类器输入的多尺度空间分辨率分别为10 m、15 m及20 m,输入的特征图大小为7×7,在各尺度下对应实际区域为70 m×70 m、105 m×105 m、140 m×140 m;遥感影像分类器输入的影像分辨率1 m,影像大小为128×128。在迭代训练过程中,将分类置信度不低于V的分类结果选作伪标签,通过试验发现V取值为95%时,效果最好。

在协同训练试验中,操作系统为Ubuntu18.04,显卡为2块GeForce GTX 1080Ti,开发工具为Python,框架为Pytorch。车辆轨迹的交叉口分类器的优化器为SGD,迭代批量大小为256,初始学习率为0.1;遥感影像的交叉口分类器的优化器为Adam,迭代批量大小为64,动量参数为0.9,初始学习率为0.01。epoch统一设置为50,两个分类器均采用交叉熵损失函数。协同训练中当选择不出伪标签时停止迭代,共迭代20次。基于种子交叉口生成的带标签小样本集数量为389,其中正负样本比例1∶3,无标签样本集数量为3162,测试集数量为573。

2.2 试验结果分析 2.2.1 种子交叉口提取结果依据车辆轨迹的几何形态信息及其所蕴含的转向语义信息,计算基于轨迹点栅格图获取的道路交叉口点和转向对的反向交叉点的聚类中心如图 6。其中,图 6(a)为轨迹点栅格原始图,含有大量噪音,经过边缘算子图 6(b)处理后得到边缘光滑且消除了细小道路的图 6(c),图 6(d)是基于图 6(c)通过形态学算子处理得到的灰色道路中心线和白色道路交叉点,为了方便示意,对其进行3个像素膨胀,通过该方法正确提取出了位于主干道交叉口,但数量较少,遗漏了连接支路的交叉口。图 6(g)中黄色点是基于车辆轨迹计算出的转向对的反向交叉点。可以看出其探测出的交叉口位置较多,但也将一些弯曲道路误识别为了交叉口,同时由于一些交叉口位于场所内部,虽然在遥感影像中可以明显辨识,但由于没有轨迹点而未能识别。图 6(e)为通过现有道路提取模型D-LinkNet获得的道路二值图,可以看出由于模型的迁移能力不足,提取的道路较为细碎。通过腐蚀算子、张量分解和非极大值抑制处理道路二值图后得到的道路交叉点如图 6(f)所示,可以看出其可以提取社区内部的交叉口,但受图谱异物的影响,将其他地物误识别为交叉口。图 6(h)是融合多元方法后获取的种子交叉口的示意图,将上述方法中基于先道路后交叉口获取的交叉口取并集后,再与基于语义信息直接获取的交叉口取交集,得到两者的交集的所有几何中心位置,生成少量种子交叉口。

|

| 图 6 多元方法融合提取种子交叉口 Fig. 6 Extraction of seeds from intersection by multi method fusion |

2.2.2 协同训练结果

基于协同训练的方法,经过多次迭代训练,扩充样本集后得到模型的预测结果如图 7所示。其中图 7(a)为基于车辆轨迹模型的交叉口提取结果,图 7(b)为基于遥感影像的交叉口提取结果。由图 7中蓝色框可以看出,在树木遮挡但有轨迹点覆盖的场景下,基于轨迹分类器能够有效提取交叉口,但此时遥感影像分类器的提取能力较弱。由图 7中红色框可以看出,基于遥感影像分类器可以提取缺少轨迹覆盖但空间特征明显的交叉口,但轨迹分类器无法识别此类交叉口。可见两种分类器在道路交叉口提取能力上各具优势且可以互补,但需要注意的是两类分类器中仍存在一些伪交叉口,因此,为进一步获取全面、精确的交叉口,需要通过有效的融合方法集成两分类器的互补优势,同时注意剔除伪交叉口。

|

| 图 7 协同训练模型结果 Fig. 7 The results of co-training model |

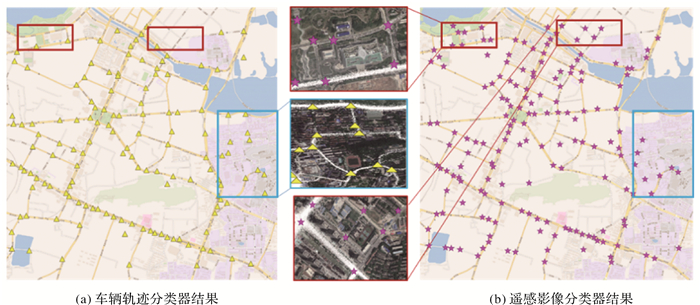

2.2.3 分类模型集成提取结果

图 8(a)是基于自适应加权融合策略融合两分类器结果所提取的最终道路交叉口结果图,其中蓝色点为正确提取的交叉口;红色点的位置是通过目视解译为道路交叉口,但没有提取到的交叉口;绿色点表示误提取的交叉口。在本文方法中,车辆轨迹可以弥补遥感影像中交叉口被其他地物遮挡的问题,遥感影像可以补充车辆轨迹稀疏区域的交叉口信息,从而实现两者优势互补。例如,图 8(b)表明本文方法可以提取遥感图像上被树木遮挡的交叉口。图 8(c)表明缺乏轨迹覆盖但遥感影像空间特征明显的交叉口可以被有效提取。图 8(d)表明本文方法可以剔除大转弯处的伪交叉口。

|

| 图 8 本文方法的交叉口提取结果 Fig. 8 Intersection extraction results of our method |

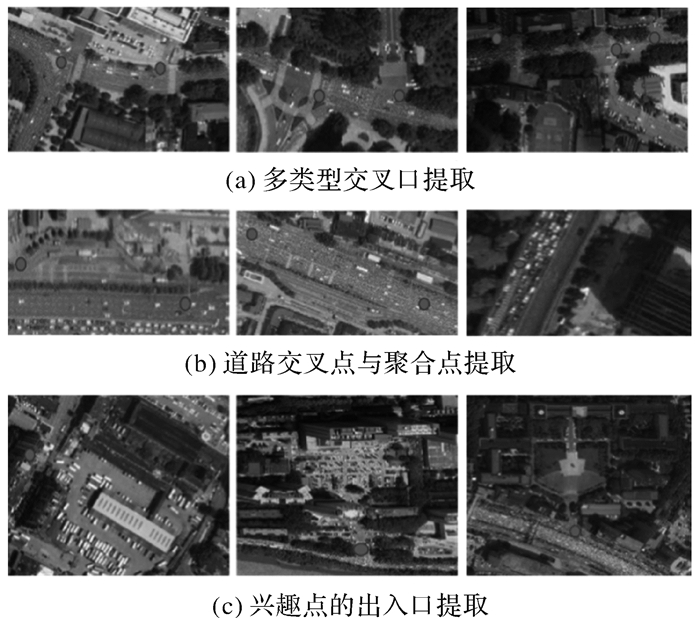

为进一步说明本文提出的方法能够适应于不同情景下的道路交叉口提取,图 9展示了部分典型交叉口的提取细节,不难看出本文方法在道路交叉口提取方面的特点:①可以识别形态迥异、大小不一的多类型交叉口,且不受交叉口之间的距离影响,如图 9(a)所示;②可以识别的道路的分岔点与聚合点,如图 9(b)所示,这对于辅助车辆导航有重要的帮助;③能够识别大型兴趣点的出入口(图 9(c)),如学校和医院的进出点。

|

| 图 9 典型交叉口提取结果 Fig. 9 Typical intersection extraction results |

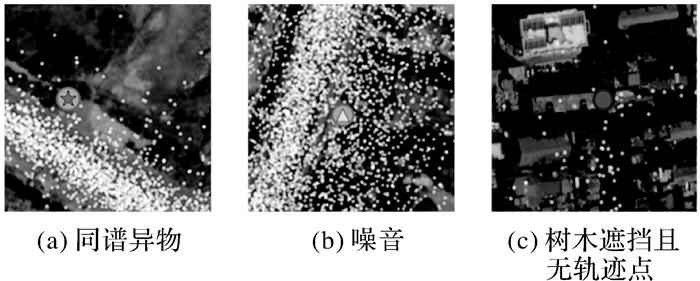

图 10是应用本文方法未能正确提取的道路交叉口。其中,图 10(a)是由于遥感影像中存在与交叉口光谱特征相似的地物,将道路与施工地的连接部分误识别为交叉口;图 10(b)是由于轨迹噪音点的影响,将一处居民地错误识别为交叉口;图 10(c)是遗漏识别的交叉口,该交叉口未能有效提取的原因是:该场景下轨迹点稀疏,同时遥感影像上的交叉口被树木遮挡使其视觉特征不明显。

|

| 图 10 未能正确提取的交叉口 Fig. 10 Intersections not extracted correctly |

2.3 精度对比

试验综合准确率、召回率及F来衡量模型的预测性能,计算公式为

(7)

(7)

(8)

(8)

(9)

(9)

式中,TP为预测正确的道路交叉口数量;FP为预测错误的交叉口数量;FN为未提取出的道路交叉口数量。由于本文提取的为道路交叉口点,而道路交叉口本身具有一定的大小,且位于不同等级道路上的交叉口大小也不同,难以使用固定阈值的缓冲区对交叉口提取效果进行评价,故在定量评价时采用多级缓冲区方法,即根据交叉口所在的道路等级设置其缓冲区范围。通过对武汉市不同等级道路和交叉口的统计,将交叉口缓冲区分为3级,具体为,将位于主干道和快速路的交叉口缓冲区阈值设置为50 m,将位于次干道的缓冲区阈值设置为40 m,其余支路上的交叉口缓冲区阈值设置为30 m。

针对车辆轨迹数据,本文选用文献[12]提出的集成形态学方法和聚类方法提取交叉口进行对比,针对遥感影像,采用张量投票方法[18]进行对比。图 11展示了上述几种方法的提取结果。图 11(a)是将真值按照其所在的道路等级分级,共分为3级,颜色越深级别越高。图 11(b)表明本文方法的交叉口提取数量最接近真值的个数,且不存在明显的交叉口提取困难的区域。由图 11(c)可以看出集成方法提取的交叉口主要位于测试区域的中部,边缘区域的交叉口提取个数较少,这是因为测试区域边缘的轨迹稀疏或是缺乏,受轨迹覆盖度的限制,该方法无法提取此类区域的交叉口。图 11(d)表明张量投票方法的交叉口提取个数较少,这说明基于遥感影像可以有效提取位于道路特征明显区域的交叉口,但难以识别被遮挡区域以及与周围背景区分不明显区域的交叉口。总的来说,基于单源数据的交叉口提取方法难以突破其数据本身的限制。

|

| 图 11 对比方法的结果 Fig. 11 The extraction result of comparison methods |

表 1是以真值所在的道路等级做多级阈值缓冲区后,将本文方法与对比方法的测试区域178个交叉口提取效果进行检验。其中最高值用加粗黑体表示,次高值用下划线表示。由表 1可以看出,本文提出的基于多层次融合的方法,在道路交叉口提取效果上,优于集成方法和张量投票方法。基于单一数据源的集成方法和张量投票的仅提取了少量正确的交叉口,且错误提取数量相对较高,使得其召回率和F值均处于小于0.6的区间。本文方法充分利用车辆轨迹和遥感影像各自的优势,交叉口提取的数量和质量大幅提升,其准确率、召回率和F值分别为0.934 1、0.876 4及0.904 3。

2.4 讨论

基于真值的多级缓冲区,对本文在各阶段通过多元方法提取的交叉口结果进行了对比(表 2)。多元方法包括:①种子交叉口提取过程中,所涉及的形态学方法、聚类方法和张量投票方法,以及种子交叉口融合提取方法;②在协同训练过程中的训练阶段,基于小样本集训练获取的两分类模型,以及在其测试阶段,基于扩充后的训练集得到的两分类模型;③集成识别过程中,本文提出的集成模型。

由表 2可以看出,在种子交叉口提取阶段,种子交叉口可以融合形态学方法、聚类方法和张量投票的优势提取少量但准确的种子交叉口。在协同训练阶段,通过协同训练逐步扩充训练样本集的协同训练融合模型,其各项评价指标,均高于通过监督训练基于小样本集的融合模型,这说明加入无标签样本后,可有效提升模型的分类能力。基于车辆轨迹数据和遥感影像数据的协同训练模型的各项指标表现均衡,但指标值均低于本文方法,这也说明了协同训练的前提下,融合模型的效果要高于仅基于车辆轨迹的模型或仅基于遥感影像的模型。本文方法在各项指标表现优异,召回率和F值均为最高值,但准确率低于仅可以提取少量交叉口的形态学方法和种子交叉口提取。综上,本文提出的方法能够有效集成车辆轨迹数据和遥感影像数据的优势,提取覆盖全面且质量高的道路交叉口。

| 阶段 | 方法 | 准确率 | 召回率 | F值 |

| 种子交叉口提取 | 形态学方法 | 0.964 7 | 0.460 7 | 0.623 6 |

| 聚类方法 | 0.433 | 0.707 9 | 0.537 3 | |

| 张量投票方法 | 0.888 9 | 0.314 6 | 0.464 7 | |

| 种子交叉口提取 | 1.0 | 0.427 | 0.598 4 | |

| 协同训练 | 监督学习_轨迹 | 0.927 1 | 0.5 | 0.649 6 |

| 监督学习_遥感 | 0.547 3 | 0.618 | 0.580 5 | |

| 协同训练_轨迹 | 0.913 | 0.707 9 | 0.797 5 | |

| 协同训练_遥感 | 0.752 9 | 0.719 1 | 0.735 6 | |

| 集成识别 | 本文方法 | 0.934 1 | 0.876 4 | 0.904 3 |

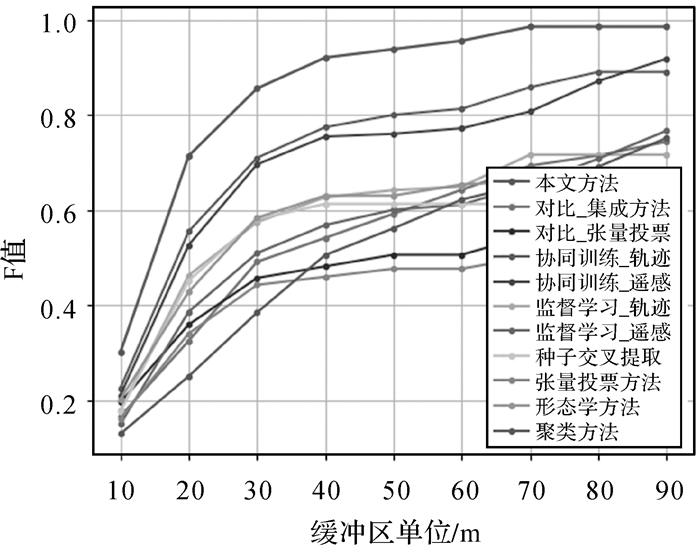

为了进一步说明本文方法的稳定性,图 12展示了在真值不同的缓冲区阈值下,基于综合评价指标F值对两个对比方法以及各阶段交叉口提取方法的检验结果。由图 12可以看出在不同阈值的缓冲区下,本文提出的交叉口提取方法的F值均远远高于其他对比方法。

|

| 图 12 各类方法的F值对比 Fig. 12 F-score comparison of various methods |

3 结论

考虑到道路交叉口不仅反映在车辆轨迹的静态分布特征和动态转向特征中,还呈现在遥感影像的纹理特征上,本文提出了一种车辆轨迹与遥感影像多层次融合的道路交叉口识别方法,弥补了单一数据源在道路交叉口提取上的不足。基于武汉市数据的试验表明,本文方法在种子交叉口生成、协同训练以及集成识别多个阶段融合车辆轨迹与遥感影像的交叉口描述特征,可以提取形态迥异、大小不等的道路交叉口,识别精确度超过93%,召回率达到87%。

本文方法充分利用车辆轨迹和遥感影像关于交叉口的互补性描述特征,不仅可以有效解决被遮挡区域和轨迹稀疏区域的交叉口提取问题,还能够提取辅路与主路交汇点,以及兴趣点的出入口。此外,所提出的半监督式交叉口提取技术,无须人工标注样本,具有较高的稳健性与可扩展性。需要指出的是,本文主要针对简单交叉口的提取问题开展研究,后续将对立交桥等复杂交叉口进行研究。

| [1] |

万子健, 李连营, 杨敏, 等. 车辆轨迹数据提取道路交叉口特征的决策树模型[J]. 测绘学报, 2019, 48(11): 1391-1403. WAN Zijian, LI Lianying, YANG Min, et al. Decision tree model for extracting road intersection feature from vehicle trajectory data[J]. Acta Geodaetica et Cartographica Sinica, 2019, 48(11): 1391-1403. DOI:10.11947/j.AGCS.2019.20190011 |

| [2] |

LI Yali, XIANG Longgang, ZHANG Caili, et al. Fusing taxi trajectories and RS images to build road map via DCNN[J]. IEEE Access, 2019, 7: 161487-161498. DOI:10.1109/ACCESS.2019.2951730 |

| [3] |

ZHANG Caili, LI Yali, XIANG Longgang, et al. Generating road networks for old downtown areas based on crowd-sourced vehicle trajectories[J]. Sensors (Basel), 2021, 21(1): 235. DOI:10.3390/s21010235 |

| [4] |

唐炉亮, 牛乐, 杨雪, 等. 利用轨迹大数据进行城市道路交叉口识别及结构提取[J]. 测绘学报, 2017, 46(6): 770-779. TANG Luliang, NIU Le, YANG Xue, et al. Urban intersection recognition and construction based on big trace data[J]. Acta Geodaetica et Cartographica Sinica, 2017, 46(6): 770-779. DOI:10.11947/j.AGCS.2017.20160614 |

| [5] |

YANG Xue, TANG Luliang, NIU Le, et al. Generating lane-based intersection maps from crowdsourcing big trace data[J]. Transportation Research Part C: Emerging Technologies, 2018, 89: 168-187. DOI:10.1016/j.trc.2018.02.007 |

| [6] |

WANG Jing, RUI Xiaoping, SONG Xianfeng, et al. A novel approach for generating routable road maps from vehicle GPS traces[J]. International Journal of Geographical Information Science, 2015, 29(1): 69-91. DOI:10.1080/13658816.2014.944527 |

| [7] |

FATHI A, KRUMM J. Detecting road intersections from GPS traces[M]. Berlin, Heidelberg: Springer Berlin Heidelberg, 2010: 56-69.

|

| [8] |

DAVIES J J, BERESFORD A R, HOPPER A. Scalable, distributed, real-time map generation[J]. IEEE Pervasive Computing, 2006, 5(4): 47-54. DOI:10.1109/MPRV.2006.83 |

| [9] |

BIAGIONI J, ERIKSSON J. Inferring road maps from global positioning system traces[J]. Transportation Research Record: Journal of the Transportation Research Board, 2012, 2291(1): 61-71. DOI:10.3141/2291-08 |

| [10] |

LIU Xuemei, BIAGIONI J, ERIKSSON J, et al. Mining large-scale, sparse GPS traces for map inference: comparison of approaches[C]//Proceedings of the 18th ACM SIGKDD international conference on Knowledge discovery and data mining. Beijing, China: ACM Press, 2012.

|

| [11] |

胡瀚, 向隆刚, 王德浩. 出租车轨迹数据的道路提取[J]. 测绘通报, 2018(7): 53-57. HU Han, XIANG Longgang, WANG Dehao. Road extraction based on taxi trajectory data[J]. Bulletin of Surveying and Mapping, 2018(7): 53-57. |

| [12] |

李思宇, 向隆刚, 张彩丽, 等. 基于低频出租车轨迹的城市路网交叉口提取研究[J]. 地球信息科学学报, 2019, 21(12): 1845-1854. LI Siyu, XIANG Longgang, ZHANG Caili, et al. Extraction of urban road network intersections based on low-frequency taxi trajectory data[J]. Journal of Geo-Information Science, 2019, 21(12): 1845-1854. DOI:10.12082/dqxxkx.2019.190187 |

| [13] |

CHIANG Yaoyi, KNOBLOCK C A. Automatic extraction of road intersection position, connectivity, and orientations from raster maps[C]//Proceedings of the 16th ACM SIGSPATIAL international conference on Advances in geographic information systems. Irvine, California, USA: ACM Press, 2008.

|

| [14] |

RAVANBAKHSH M, HEIPKE C, PAKZAD K. Road junction extraction from high-resolution aerial imagery[J]. The Photogrammetric Record, 2008, 23(124): 405-423. DOI:10.1111/j.1477-9730.2008.00496.x |

| [15] |

曹闻, 李润生. 利用可变形部件模型检测遥感影像道路交叉口[J]. 武汉大学学报(信息科学版), 2018, 43(3): 413-419. CAO Wen, LI Runsheng. Road intersections detection using deformable part models on remote sensing image[J]. Geomatics and Information Science of Wuhan University, 2018, 43(3): 413-419. |

| [16] |

王龙飞, 刘智, 金飞, 等. 道路交叉口自动检测算法的研究[J]. 测绘科学, 2020, 45(5): 126-131, 146. WANG Longfei, LIU Zhi, JIN Fei, et al. Research on automatic recognition algorithm of road intersection[J]. Science of Surveying and Mapping, 2020, 45(5): 126-131, 146. |

| [17] |

SHI Wenzhong, MIAO Zelang, DEBAYLE J. An integrated method for urban main-road centerline extraction from optical remotely sensed imagery[J]. IEEE Transactions on Geoscience and Remote Sensing, 2014, 52(6): 3359-3372. DOI:10.1109/TGRS.2013.2272593 |

| [18] |

ZHANG Yingying, ZHANG Junping, LI Tong, et al. Road extraction and intersection detection based on tensor voting[C]//Proceedings of 2016 IEEE International Geoscience and Remote Sensing Symposium (IGARSS). Beijing, China: IEEE, 2016: 1587-1590.

|

| [19] |

SUN Ke, ZHANG Junping, ZHANG Yingying. Roads and intersections extraction from high-resolution remote sensing imagery based on tensor voting under big data environment[J]. Wireless Communications and Mobile Computing, 2019, 2019: 1-11. |

| [20] |

NIE Dong, GAO Yaozong, WANG Li, et al. ASDNet: attention based semi-supervised deep networks for medical image segmentation[C]//Proceedings of 2018 Medical Image Computing and Computer Assisted Intervention. [S. l. ]: MICCAI, 2018: 370-378.

|

| [21] |

ZHOU Lichen, ZHANG Chuang, WU Ming. D-LinkNet: LinkNet with pretrained encoder and dilated convolution for high resolution satellite imagery road extraction[C]//Proceedings of 2018 IEEE/CVF Conference on Computer Vision and Pattern Recognition Workshops (CVPRW). Salt Lake City, UT, USA: IEEE, 2018: 192-1924.

|

| [22] |

GUY G, MEDIONI G. Inference of surfaces, 3D curves, and junctions from sparse, noisy, 3D data[J]. IEEE Transactions on Pattern Analysis and Machine Intelligence, 1997, 19(11): 1265-1277. DOI:10.1109/34.632985 |

| [23] |

HONG Yi, ZHU Weiping. Spatial co-training for semi-supervised image classification[J]. Pattern Recognition Letters, 2015, 63: 59-65. DOI:10.1016/j.patrec.2015.06.017 |

| [24] |

CHEN Chen, LU Cewu, HUANG Qixing, et al. City-scale map creation and updating using GPS collections[C]//Proceedings of the 22nd ACM SIGKDD International Conference on Knowledge Discovery and Data Mining. San Francisco California USA. New York, USA: ACM, 2016.

|

| [25] |

WANG Chao, HAO Peng, WU Guoyuan, et al. Intersection and stop bar position extraction from vehicle positioning data[J]. IEEE Transactions on Intelligent Transportation Systems, 2020(99): 1-12. |

| [26] |

QI Xiaojun, HAN Yutao. Incorporating multiple SVMs for automatic image annotation[J]. Pattern Recognition, 2007, 40(2): 728-741. DOI:10.1016/j.patcog.2006.04.042 |