2. 同济大学数学与科学学院, 上海 200092

2. School of Mathematical Sciences, Tongji University, Shanghai 200092, China

点云数据包含三维几何坐标和特定物理属性,是二维矢量和影像数据之后的重要地理信息时空数据,在场景数据的三维精细化观测和场景信息的几何结构化表达等场景感知方面具有显著的优势[1]。然而,地质灾害态势感知、自然资源定量调查和道路交通安全服务等国家重大战略需求的应用突破,因其高度复杂、强不确定性、持续动态演化的场景特性,促使对场景的理解从感知迈向认知[2-4]。场景认知是对物理环境中客观事物本质特征和空间关系的理解,其中,场景数据(观测数据)—场景信息(数据特征)—场景知识(特征关联)的全链路转化是实现场景认知能力“从现象到本质”提升的关键途径[5-6]。因此,场景观测模式需要从单一点位观测向多线全域观测突破,智能处理算法需要从特征提取为主的人类认知向能主动识别特征关联的机器认知突破,智能处理算力需要从事后精密计算处理向实时高效分析处理突破。

近年来,随着观测平台和传感器技术的迅速发展,点云大数据采集装备已经从专业级单一化向消费级集成化转变,为点云大数据的获取提供了便捷手段[7]。在点云观测传感器方面,已经形成了以激光雷达(单波段[8]和多波段[9])和摄影测量(传统视觉相机[10]、多光谱相机[11]、偏振相机[12]、深度相机[13]和结构光相机[14]等)为主导,全球卫星导航系统(GNSS)和惯性测量单元(inertial measurement unit,IMU)为辅助的多源传感器耦合观测模式[15]。同时,在传感器搭载平台方面已形成从星载、机载、车载、无人移动平台、仿生机器人、背包、手持、地基等多尺度、多分辨率和多平台协同观测方式[16]。目前,多传感器、多平台观测形成的高维点云已经在智慧城市、自动驾驶和实景三维等诸多领域得到广泛的应用[1, 17-19]。然而,高维点云的多时相、多尺度和多属性等特性使得单一化、个性化的点云处理方式难以有效突破智能计算的算法和算力。

本文围绕点云场景认知的基本框架为主要线索,重点分析了多源点云耦合观测、点云场景认知共性处理和重大工程应用3个方面取得的研究进展,总结了点云场景认知研究当前面临的主要问题,最后面向点云场景认知的前沿挑战及发展趋势提出了“泛化点云”的科学概念和技术框架。“泛化点云”是指多传感器、多尺度、多时相遥感观测的单一个性化点云的共性聚合体,在属性维度上有效融合了个性化点云的几何位置、物理属性和辅助信息,并完成了时间维度和空间维度的泛化。在具体表现形式上,“泛化点云”将单一个性化点云的属性信息进行聚合,因而形成了一个高维点集,即“泛化点云”中每一个点都具备多尺度、多时相的空间坐标、物理属性、辅助信息和点云特征。同时“泛化点云”避开传统欧氏空间的低维局限,利用“高维张量流形空间”进行点云的高维属性表达,进而用于场景认知处理。希望能为突破点云场景认知的智能处理水平提供新的研究思路。

1 点云场景认知的研究进展认知场景中存在大量跨域、高维、低秩、稀疏、隐式的信息[20],这些信息中的知识,除了具有通用知识的语义内涵和特点之外,还与场景现象或事物的演化过程密切相关[21]。同时,点云观测数据存在的海量、散乱、冗余、不完整、弱结构、高动态和密度差异等特性给点云场景认知处理带来了很大的难度[22-25]。因此,需要以点云观测、数据处理和应用服务3个方面为点云场景认知的基本框架(图 1),在多源点云耦合、点云场景认知处理和工程应用服务3个方面进行深入研究,解决认知场景的动态观测、快速处理和人机协同等核心问题,有效支撑场景认知的科学研究和国家重大战略需求的应用突破。下文分别阐述上述几方面的主要研究进展。

|

| 图 1 点云场景认知的基本框架 Fig. 1 The framework of point cloud scene cognition |

1.1 多源点云耦合观测

由于单一观测平台在其有限的观测视角内难以获取目标场景完整的点云数据,不仅需要进行单一平台的移动或者多站点云拼接,还需要进行多视角观测平台(如室内的地面平台、室外的无人机等)的点云耦合,以克服单一观测平台导致的点云残缺问题,进而实现目标场景空间信息的全方位获取和表达[26-27]。同时,一些观测传感器在特殊的场景下变得失效(如激光扫描难以观测玻璃材质的场景目标)而导致获取的点云数据完整性较低,需要进行多源传感器耦合观测,有效整合多源点云观测传感器的优势,使得多源点云能够完整地描述场景的几何状态[28-29]。此外,通过将GNSS/IMU和不同点云观测传感器集成在统一观测平台上,并进行传感器观测方程、位置和姿态信息的联合解算,解决点云获取中的少弱纹理、变化光照、运动模糊和相似部件等问题,实现目标场景三维点云的高效、稳健和精确获取[30-31]。目前,“广义点云”通过整合单一传感器采集点云间的优势,构建基准统一,且数据、结构、功能为一体的复合点云数据模型,解决了点云数据单一、质量差异大、采样粒度分布严重不均匀等问题[32]。

几何基准的统一是多源点云耦合的基础。点云配准是恢复两个或多个位于不同坐标系下具有重叠区域的点云之间的平移和旋转关系,在此基础上进行多源点云的几何基准对齐[33-34]。因此,点云配准是多源点云耦合观测的有效手段。目前,点云配准主要分为基于优化和基于特征的方法。基于优化的配准方法是利用迭代优化策略来估计最优变换和对应关系,主要包括局部优化[35-36]和全局优化[37-38]。现有的基于优化的配准方法具有较高的理论精度,但需要良好的初始化以缩小启发式搜索的参数空间。基于特征的配准方法是提取特征来确定点云之间的匹配,然后估计点云之间的变换关系,提取的特征主要包括人工设计特征[39-41]和深度学习特征[42-44]。尽管这些基于特征的方法对配准初始化具有稳健性,但其理论精度存在一定的局限性。此外,已有的一些研究集成了基于优化和基于特征的配准方法。这些集成方法[45-46]结合了基于优化和基于特征的配准方法的优点,以确保初始化和理论精度,但由于复杂因素对点云配准的准确性和稳健性提出了巨大的挑战。

多源点云耦合观测能够实现多平台、多传感器之间的优势互补,然而不同平台、不同传感器之间的观测模式、视角、尺度、精度等存在较大差异,导致获取的多源点云之间存在密度变化、尺度差异和低重叠度等问题,严重影响点云配准的效果,因而给多源点云耦合带来较大的挑战。此外,单一来源点云包含的特定物理属性的种类较为单一,而多源点云物理属性的融合能够有效提升对场景目标的描述能力。然而,目前多源点云耦合研究多关注于点云几何基准的统一,多源点云物理属性的融合研究很少。

1.2 点云场景认知处理场景语义认知是对空间场景物理环境的理解过程,通过提取空间场景中实体要素的特征,并建立特征关联关系,进而揭示场景要素间的关联机制[25]。因此,点云场景认知的核心任务在于抽象与表征场景信息中的高维时空关联特征,其中特征提取、关联认知、特征学习是点云场景认知的共性处理技术,也是从场景特征感知向语义认知交互阶段迈进的关键。

1.2.1 特征提取点云数据特征提取是通过特征关键点选择、特征描述子设计和特征空间变换映射,描述点云大数据中稀疏分布的信息[47]。点云特征能够有效表达场景几何结构和物理状态,因而成为点云场景认知处理的基础和前提[48]。目前,点云数据特征构建的范式是通过矩阵或者向量计算,将单个点实体对象进行三维坐标映射,然后根据欧氏空间中的分布特性计算和搜索三维几何邻域,实现点云原始数据到特征空间的有效映射[49]。这种范式中,特征的描述可分为基于特征值[50]、基于特征向量[51]、基于点特征直方图[52]、基于二维视角[53]、基于图[54]、旋转投影统计特征描述[55]、二进制形状上下文[56]等形式。然而,这种特征构建范式将点云数据中包含的高维信息降维为二维矩阵或向量,造成点云数据中几何结构形态的损失和属性关联关系的破坏[57-58]。因此,在特征构建过程中会造成高维信息的丢失与损坏,从而直接导致场景信息表达的残缺与失真。

1.2.2 特征关联特征关联是通过提取场景要素的特征,建立特征之间的关联关系,揭示场景要素与空间全局上下文关系,进而实现场景认知[25, 59]。当前,点云特征关联方法主要分为间接法和直接法。间接法是将三维点云投影为二维图像进行视觉影像特征关联,进而映射为三维点云的特征关联关系。典型的视觉影像特征关联方法有金字塔场景分析网络[60]、深度神经网络[61]、特征感知网络[62]等方法。直接法是直接确定三维点云特征的关联关系,研究进展包括通过场景要素邻域之间的优化迭代获取场景要素上下文信息[63],基于三维金字塔模块的要素关联方法增强要素间多尺度特征的认知能力[64],利用同质超体素组织实体要素上下文信息来增强场景语义的推理能力[65]。然而,目前点云特征关联研究多依赖于欧氏空间中几何特征的实体信息表达,难以支撑点云场景要素的有效空间认知。因此,有必要在新的特征空间中对全局、深层、时空不变的特征进行关联研究。

1.2.3 特征学习深度学习凭借其优良的高层次的语义理解能力,在点云数据的场景认知上引起了广泛的关注[66-67]。目前,根据深度学习模型的不同,点云特征学习方法可以分为基于多视图、基于体素和基于原始点云的方法。基于多视图的方法是将三维点云投影为二维图像,进而进行深度学习处理,代表性的模型包括Multiview-CNN[68]和SnapNet[69]。基于体素的方法是将不规则的点云进行体素规则化,再输入神经网络中进行学习处理,代表性的模型有VoxNet[70]和SegCloud[71]。相比于基于多视图和体素化的间接处理方法,基于原始点云的方法是直接利用原始点云进行深度学习,避免点云转换带来的信息损失,代表性的模型有PointNet[72]和PointNet++[73]。此外,特征聚合的点云深度学习方法通过在学习网络输入阶段加入手工物理特征,以提升特征学习的效果[49]。然而,当前点云特征学习方法尚存在训练数据限制、模型缺乏可解释性、模型泛化能力不足、运算成本高等问题。此外,特定任务驱动的深度学习模型不足以实现高层次特征的准确描述,还需要开展进一步深入研究来支撑场景认知。

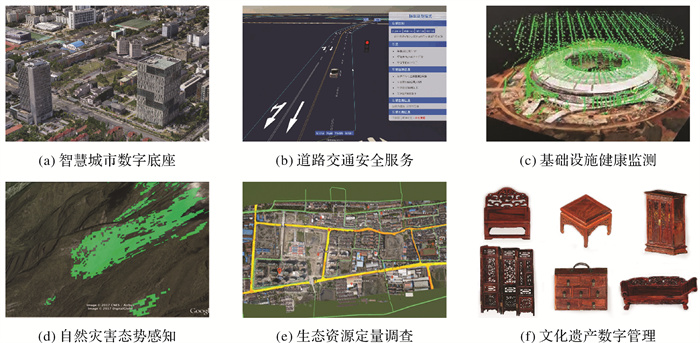

1.3 点云场景认知应用点云场景认知在场景耦合观测和智能处理方面取得了较好的研究成果,在智慧城市数字底座、道路交通安全服务、基础设施健康监测、自然灾害态势感知、生态资源定量调查、文化遗产数字管理等国家重要战略中得到了广泛应用(图 2),实现了基础研究和应用研究的有效衔接。

|

| 图 2 面向国家重要战略的点云场景认知应用 Fig. 2 The applications of point cloud scene cognition for national important strategies |

1.3.1 智慧城市数字底座

点云场景认知集成空间数据、地理信息、场景知识,结合物联感知数据,为数字底座信息模型设计、数字底座数据治理模式设计和数字底座呈现能力建设提供多粒度、多层次、多细节的空间地理信息模型,在城市精细化管理、数字孪生城市建设、城市安全分析预警等方面得到广泛的应用[74-76]。

1.3.2 道路交通安全服务面向大范围、多密度、高动态的道路场景,点云场景认知通过识别、拾取、关联等处理模块,可以高效、准确地获取包含几何结构、语义信息、拓扑连通、动态更新的高精度语义地图,实现交通路网的智能感知和多维监测,为在途驾驶人及自动驾驶车辆提供准确、及时、直观的安全交通策略[77-80]。

1.3.3 基础设施健康监测面向重大基础设施服役状态监测及精细运维需求,点云场景认知能够高精度获取结构几何信息、多层次重构表面纹理细节、多维度表征健康状态指标,为大型建筑施工质量控制、城市道路关键要素健康检测、桥梁健康动态评估提供快速有效的感知模式,有力支撑基础设施健康状态科学诊断和全生命周期防护[81-84]。

1.3.4 自然灾害态势感知在自然灾害态势感知方面,点云场景认知能够高效、精准、及时地获取不良地质体的三维模型,基于多时相三维模型计算不良地质体的形变和位移数据,分析不良地质体的态势演化规律,进而揭示自然灾害触发机制,为自然灾害区域的快速定位、抢险救援、风险评估及灾害预警等提供关键支撑[85-87]。

1.3.5 生态资源定量调查点云场景认知通过点云耦合观测、三维结构信息精确获取、生态参数定量反演、空间格局动态演化分析,实现对生态资源的全方位、多层次、精细化、智能化的状态认知,大幅度地提升了自然资源定量调查的工作效率,为保护生态自然资源的可持续发展政策制定提供科学支撑[88-91]。

1.3.6 文化遗产数字管理点云场景认知能够通过实际数据采集、处理和重构,为文化遗产的高精度三维建模、数字化存储、虚拟化修复、可视化展示、网络化传播提供可靠的、完整的、精确的数据信息资源,显著提升了文化遗产管理的工作效率和质量,为文化遗产修复、重建和后续的研究工作提供了宝贵的资源[92-95]。

点云认知已在许多重大工程和典型领域里得到了广泛的应用。然而,随着应用场景的复杂性、不确定性、动态演化性不断增加,点云场景的认知处理算法仍需加强多类别、多层次、多维度点云特征的融合、提取、关联、学习等方面的研究。同时,为了满足认识场景的动态观测、快速处理、应急建图、人机协同等技术应用需求,需要进一步提升点云认知处理的算力。

2 点云场景认知的当前挑战在点云耦合观测、认知共性处理和认知应用需求的多重驱动下,点云数据的完整性、时效性和颗粒度显著提升,进而产生了多时相、多尺度和多属性的高维点云[1]。高维点云蕴含丰富的场景信息,不仅描述了场景的三维空间结构特征,而且包含了具有通用知识的事实型、规则型、决策型语义内涵及具有特定的时空特征,这些信息与场景的动态演化过程密切相关。尽管目前点云认知研究已经取得了一系列先进的成果,然而如何在有效的认知空间中对高维点云进行客观表征和高效处理,挖掘场景中深层次的信息并建立实体、语义、事件之间的关联关系,是智能获取场景知识面临的新挑战。

2.1 高维点云的属性聚合时空基准的统一是多源点云聚合的基础,而多平台、多传感器、多时相耦合观测导致的点云密度变化、尺度差异和低重叠度等问题给多源点云基准统一带来了较大的挑战。因此,需要揭示多来源点云的误差分布和传播规律,研究稳健的点云配准方法,同时研究多尺度点云特征融合方法,实现多源点云的高维属性有效聚合和多维表达。

2.2 高维点云的智能处理算法传统欧氏空间中,多源属性聚合产生的高维点云数据对物理环境感知的理论与方法因其本质上的局限而制约对物理环境的有效认知。因此,针对高维点云数据,需要突破传统认知空间的局限来探索对物理环境的有效认知空间,需要从数学描述和物理解释上去构造有效认知空间,并探索有效认知空间下特征提取、关联、学习的认知机制。

2.3 高维点云的智能处理算力尽管多平台、多传感器耦合观测产生的高维点云能够聚合更多的场景信息,然而点云数据的存储容量显著增加,给场景认知处理的效率带来了更大的挑战。因此,需要探索点云大数据的储存与组织机制,研究高维点云学习加速方法,研发点云大数据的高并发计算优化技术,突破海量高维点云数据的运算限制,全面提升点云场景认知处理的算力。

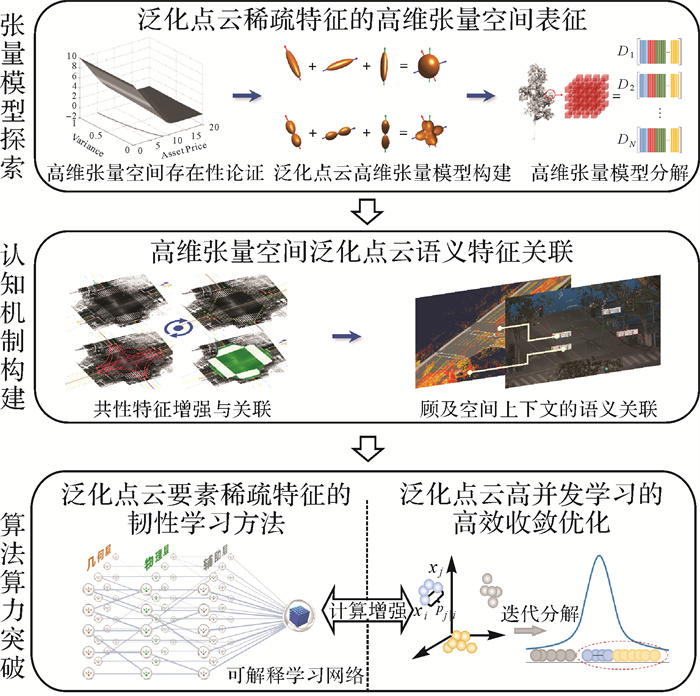

3 泛化点云的场景认知模式面向自然灾害感知、道路交通安全、自然资源监测等国家重大战略需求应用的前沿挑战,点云场景认知亟须从场景特征感知向场景语义认知进行关键突破,因而以需求导向提升点云智能处理的算法和算力是未来研究的重要课题。为此,本文提出“泛化点云”科学概念(图 3),把多时相、多尺度和多属性的点云属性信息聚合形成一个高维点云数据集,避开传统欧氏空间的低维局限,进而转换到“高维张量流形空间”中进行认知处理,这一学术思想是对传统在欧氏空间对点云进行降维处理的补充。

|

| 图 3 泛化点云的科学概念 Fig. 3 The scientific concept of generalized point clouds |

“泛化点云”是指由多传感器、多尺度、多时相遥感观测点云的聚合,是点云在来源、时间和空间维度的泛化,具备几何位置、物理属性和辅助信息的高维点集的有效统一,通过特征提取、特征关联、特征学习和运算加速等共性处理,可挖掘场景的要素状态、语义关联、事件演化、场景变化等知识。在具体表现形式上,“泛化点云”将单一个性化点云的属性信息聚合成一个高维点集,其中每一个点都具备多尺度、多时相的空间坐标、物理属性、辅助信息和点云特征,同时利用高维张量进行点云高维属性的数学表达。“高维张量流形空间”是传统低维欧氏空间的高维拓展,是高维点云数据的自然表达载体。在“高维张量流形空间”,泛化点云的属性信息能够得到完整和准确地表达,能挖掘高维数据内部隐含的低秩结构,显性表征具有特定物理含义的主要特征,并可从物理机理上解释特征学习的模型参数和认知规律,改变了传统空间认知的思路。

针对泛化点云的场景认知模式,需要探索泛化点云在高维张量流形空间的认知机制,研究泛化点云的场景认知理论方法,形成场景认知共性处理技术。为此,泛化点云的场景认知模式需要在张量模型探索、关联机制构建、智能处理算法和算力突破方面进行研究,如图 4所示。

|

| 图 4 泛化点云的场景认知模式 Fig. 4 The scene cognition module of generalized point cloud |

(1) 开展泛化点云稀疏特征的高维张量流形空间表征研究,探索能够显性表达泛化点云的高维张量流形空间基础模型。探索欧氏空间与高维张量流形空间下泛化点云几何和语义信息表现的差异,探索建立泛化点云欧氏空间与高维张量流形空间的可逆映射关系;研究高维张量流形空间认知与表达理论,揭示高维张量流形空间下泛化点云高层次几何和语义特征的显性表征机制;突破泛化点云几何属性和语义信息的高维张量流形空间表达,实现泛化点云在高维张量流形空间下的有效表征;探索构建多元关系融合的高维张量分解模型,研究面向泛化点云的高维张量低秩逼近方法,实现泛化点云高层次几何和语义稀疏特征的有效提取。

(2) 开展高维张量流形空间泛化点云语义特征关联研究,构建高维张量流形空间中语义关联的认知机制。研究泛化点云在高维张量流形空间中的时空不变关键特征,构建时空不变特征与实体要素语义的分层映射关系,研究深层特征的构造与增强机理,分析多任务多场景下共性特征关联关系,降低特征与特征之间,特征与任务之间的依赖相关性;研究跨任务时空一致的语义上下文关联机理,增强语义的上下文一致性,实现全局场景语义关系的有效约束;研究语义结构化关联与场景知识理解机制,探索实体关系抽取模式与结构化关联模式,实现实体要素语义关系向场景知识表征的过渡。

(3) 开展泛化点云要素稀疏特征的韧性学习研究,建立算法可解释的认知学习机制。研究构建面向泛化点云及其稀疏特征的可解释深度神经网络语义标注方法,建立模块化语义表达的神经网络,提高神经网络模型的可解释性和透明性;探索面向泛化点云的小样本、弱标注、自适应新环境的上下文关联的迁移学习机制,提高复杂场景下深度学习的泛化能力;研究提高复杂场景泛化点云认知的韧性学习能力(训练稳定、模型抗干扰、变化环境自适应、可解释性强),构建泛化点云实体要素知识图谱的协同推理计算方法,突破复杂环境下的空间要素特征的认知局限,实现对空间实体的理解从感知学习到认知智能层面的提升。

(4) 开展泛化点云高并发学习的高性能优化算法研究,建立算力可加速的认知学习机制。研究基于非凸低秩分解的深度神经网络压缩与加速机制,并运用并行计算的网络计算模型,提升高并发学习的收敛速度;研究点云知识图谱的精化构建与优化更新方法,探索静态深度学习到时变迁移学习的转化机制,通过构建泛化点云实体要素不同时序的共性算子,高效抽取实体要素及实体对之间的关联知识,实现知识概念图谱上下文关系的快速更新与补全;探索建立要素实体和概念关系链接而成的网状知识图谱模型和数据的高效表示与存储方法,优化泛化点云实体要素知识图谱的协同推理计算机制。

4 总结揭示智能体空间认知行为与判断机制,实现对空间场景的理解从特征感知向语义认知的迈进,是地球对地观测研究在新一代人工智能发展阶段的前沿问题与挑战。场景信息到场景知识的有效转化是实现认知能力提升的关键。点云大数据作为新型遥感的主要数据形式,逐渐成为智能体感知场景的重要信息载体。然而,对点云数据的计算范式目前是在欧氏空间中提取和关联几何特征,不能支撑场景中稀疏分布、物理属性复杂的高维时空关联特征的构建,难以有效挖掘数据内部隐含的场景语义知识。

本文在对现有研究进展进行比对分析、方法总结和问题凝练的基础上,提出了泛化点云的概念,它是具备空间位置、物理属性、时间序列和同步辅助信息的高维点集,蕴含真实场景的丰富知识。同时张量流行空间以其对非规则高维数据表达的原生支持特性,可为泛化点云的特征表征提供新的理论和方法支撑。在笔者前期探索中,已利用点云在张量流行空间中的特征表征显著提升了复杂环境中多类型要素的特征识别率,证明了对场景复杂几何形态精确表达的有效作用。

此外,迫切需要瞄准泛化点云的场景语义认知前沿科学问题,通过高维张量流形空间对物理环境在有效认知空间进行转换,揭示物理环境的泛化点云在新有效认知空间与要素语义知识的关联机制,从而推进泛化点云认知的基础研究。也需要围绕泛化点云对物理环境新认知空间中独有的基础性技术突破,建立泛化点云的韧性学习机制,突破面向泛化点云高并发计算的效率、收敛和优化技术,全面提升泛化点云运算效率和质量,并完成典型室内外场景高精度语义建图,实现基础和应用研究的衔接。

| [1] |

杨必胜, 梁福逊, 黄荣刚. 三维激光扫描点云数据处理研究进展、挑战与趋势[J]. 测绘学报, 2017, 46(10): 1509-1516. YANG Bisheng, LIANG Fuxun, HUANG Ronggang. Progress, challenges and perspectives of 3D LiDAR point cloud processing[J]. Acta Geodaetica et Cartographica Sinica, 2017, 46(10): 1509-1516. DOI:10.11947/j.AGCS.2017.20170351 |

| [2] |

HUSSAIN R, ZEADALLY S. Autonomous cars: research results, issues, and future challenges[J]. IEEE Communications Surveys and Tutorials, 2018, 21(2): 1275-1313. DOI:10.1109/COMST.2018.2869360 |

| [3] |

SVNDERHAUF N, PHAM T T, LATIF Y, et al. Meaningful maps with object-oriented semantic mapping[C]//Proceedings of 2017 IEEE/RSJ International Conference on Intelligent Robots and Systems (IROS). [S. l. ]: IEEE, 2017: 5079-5085.

|

| [4] |

陈军, 刘万增, 武吴, 等. 智能化测绘的基本问题与发展方向[J]. 测绘学报, 2021, 50(8): 995-1005. CHEN Jun, LIU Wanzeng, WU Wu, et al. Smart surveying and mapping: fundamental issues and research agenda[J]. Acta Geodaetica et Cartographica Sinica, 2021, 50(8): 995-1005. DOI:10.11947/j.AGCS.2021.20210235 |

| [5] |

宁津生. 测绘科学与技术转型升级发展战略研究[J]. 武汉大学学报(信息科学版), 2019, 44(1): 1-9. NING Jinsheng. Research on the development strategy of surveying and mapping science and technology transformation and upgrading[J]. Geomatics and Information Science of Wuhan University, 2019, 44(1): 1-9. DOI:10.13203/j.whugis20180477 |

| [6] |

李德仁. 展望大数据时代的地球空间信息学[J]. 测绘学报, 2016, 45(4): 379-384. LI Deren. Towards geo-spatial information science in big data era[J]. Acta Geodaetica et Cartographica Sinica, 2016, 45(4): 379-384. DOI:10.11947/j.AGCS.2016.20160057 |

| [7] |

蒋赫敏, 钟若飞, 谢东海. 智能手机移动测量方法的设计与实现[J]. 测绘通报, 2019(6): 71-76. JIANG Hemin, ZHONG Ruofei, XIE Donghai. Design and implementation of mobile measurement method for smartphone[J]. Bulletin of Surveying and Mapping, 2019(6): 71-76. DOI:10.13474/j.cnki.11-2246.2019.0187 |

| [8] |

ZHANG Meina, LÜ Xiaolan, QIU Wei, et al. Calculation method of leaf area density based on three-dimensional laser point cloud[J]. Transactions of the Chinese Society for Agricultural Machinery, 2017. DOI:10.6041/j.issn.1000-1298.2017.11.021 |

| [9] |

卢昊, 庞勇, 李增元, 等. 全波形机载激光雷达绝对辐射定标与不确定性分析[J]. 遥感学报, 2020, 24(11): 1353-1362. LU Hao, PANG Yong, LI Zengyuan, et al. Uncertainty analysis of the absolute radiometric calibration of full waveform airborne LiDAR[J]. Journal of Remote Sensing, 2020, 24(11): 1353-1362. DOI:10.11834/jrs.20208376 |

| [10] |

张宗华, 刘巍, 刘国栋, 等. 三维视觉测量技术及应用进展[J]. 中国图象图形学报, 2021, 26(6): 1483-1502. ZHANG Zonghua, LIU Wei, LIU Guodong, et al. Overview of the development and application of 3D vision measurement technology[J]. Journal of Image and Graphics, 2021, 26(6): 1483-1502. DOI:10.11834/jig.200841 |

| [11] |

NIEMEYER J, ROTTENSTEINER F, SOERGEL U. Contextual classification of lidar data and building object detection in urban areas[J]. ISPRS Journal of Photogrammetry & Remote Sensing, 2014, 87(1): 152-165. DOI:10.1016/j.isprsjprs.2013.11.001 |

| [12] |

郝婧蕾, 赵永强, 赵海盟, 等. 偏振多光谱机器视觉的高反光无纹理目标三维重构方法[J]. 测绘学报, 2018, 47(6): 816-824. HAO Jinglei, ZHAO Yongqiang, ZHAO Haimeng, et al. 3D reconstruction of high-reflective and textureless targets based on multispectral polarization and machine vision[J]. Acta Geodaetica et Cartographica Sinica, 2018, 47(6): 816-824. DOI:10.11947/j.AGCS.2018.20170624.AGCS.2018.20170624 |

| [13] |

STURM J, ENGELHARD N, ENDRES F, et al. A benchmark for the evaluation of RGB-D SLAM systems[C]//Proceedings of 2012 IEEE/RSJ International Conference on Intelligent Robots and Systems. IEEE, 2012: 573-580. DOI: 10.1109/IROS.2012.6385773.

|

| [14] |

周建丰, 邓学良. 一种多线结构光合成编码的三维重建方法[J]. 现代计算机, 2021, 27(23): 119-123. ZHOU Jianfeng, DENG Xueliang. A three-dimensional reconstruction method for photo synthetic coding of multi-line structure[J]. Modern Computer, 2021, 27(23): 119-123. DOI:10.3969/j.issn.1007-1423.2021.23.021 |

| [15] |

LAFOREST L, HASHEMINASAB S M, ZHOU T, et al. New strategies for time delay estimation during system calibration for UAV-based GNSS/INS-assisted imaging systems[J]. Remote Sensing, 2019, 11(15): 1811. DOI:10.3390/rs11151811 |

| [16] |

LI Jianping, YANG Bisheng, CHEN Chi, et al. NRLI-UAV: non-rigid registration of sequential raw laser scans and images for low-cost UAV LiDAR point cloud quality improvement[J]. ISPRS Journal of Photogrammetry and Remote Sensing, 2019, 158: 123-145. DOI:10.1016/j.isprsjprs.2019.10.009 |

| [17] |

郭晨, 许强, 董秀军, 等. 复杂山区地质灾害机载激光雷达识别研究[J]. 武汉大学学报(信息科学版), 2021, 46(10): 1538-1547. GUO Chen, XU Qiang, DONG Xiujun, et al. Geohazard recognition by airborme LiDAR technology in complex mountain areas[J]. Geomatics and Information Science of Wuhan University, 2021, 46(10): 1538-1547. DOI:10.13203/j.whugis20210121 |

| [18] |

曾伟生, 孙乡楠, 王六如, 等. 基于机载激光雷达数据的森林蓄积量模型研建[J]. 林业科学, 2021, 57(2): 31-38. ZENG Weisheng, SUN Xiangnan, WANG Liuru, et al. Development of forest stand volume models based on airborne laser scanning data[J]. Scientia Silvae Sinicae, 2021, 57(2): 31-38. DOI:10.11707/j.1001-7488.20210204 |

| [19] |

刘经南, 吴杭彬, 郭迟, 等. 高精度道路导航地图的进展与思考[J]. 中国工程科学, 2018, 20(2): 99-105. LIU Jingnan, WU Hangbin, GUO Chi, et al. Progress and consideration of high precision road navigation map[J]. Strategic Study of CAE, 2018, 20(2): 99-105. DOI:10.15302/J-SSCAE-2018.02.015 |

| [20] |

李德仁, 张良培, 夏桂松. 遥感大数据自动分析与数据挖掘[J]. 测绘学报, 2014, 43(12): 1211-1216. LI Deren, ZHANG Liangpei, XIA Guisong. Automatic analysis and mining of remote sensing big data[J]. Acta Geodaetica et Cartographica Sinica, 2014, 43(12): 1211-1216. DOI:10.13485/j.cnki.11-2089.2014.0187 |

| [21] |

XIE Y, TIAN J, ZHU X X. Linking points with labels in 3D: a review of point cloud semantic segmentation[J]. IEEE Geoscience and Remote Sensing Magazine, 2020, 8(4): 38-59. DOI:10.1109/MGRS.2019.2937630 |

| [22] |

郭华东. 科学大数据——国家大数据战略的基石[J]. 中国科学院院刊, 2018, 33(8): 768-773. GUO Huadong. Scientific big data—a footstone of national strategy for big data[J]. Bulletin of Chinese Academy of Sciences, 2018, 33(8): 768-773. DOI:10.16418/j.issn.1000-3045.2018.08.001 |

| [23] |

LANDRIEU L, SIMONOVSKY M. Large-scale point cloud semantic segmentation with superpoint graphs[C]//Proceedings of 2018 IEEE Conference on Computer Vision and Pattern Recognition. [S. l. ]: IEEE, 2018: 4558-4567. DOI: 10.1109/CVPR.2018.00479.

|

| [24] |

ZHANG Jiaying, ZHAO Xiaoli, CHEN Zheng, et al. A review of deep learning-based semantic segmentation for point cloud[J]. IEEE Access, 2019(7): 179118-179133. DOI:10.1109/ACCESS.2019.2958671 |

| [25] |

李勇, 佟国峰, 杨景超, 等. 三维点云场景数据获取及其场景理解关键技术综述[J]. 激光与光电子学进展, 2019, 56(4): 21-34. LI Yong, TONG Guofeng, YANG Jingchao, et al. 3D point cloud scene data acquisition and its key technologies for scene understanding[J]. Laser & Optoelectronics Progress, 2019, 56(4): 21-34. DOI:10.3788/LOP56.040002 |

| [26] |

郭王, 程效军. 基于激光强度分类的机载与地面激光雷达点云配准方法[J]. 激光与光电子学进展, 2018, 55(6): 409-416. GUO Wang, CHENG Xiaojun. Registration method for airborne and terrestrial light detection and ranging point cloud based on laser intensity classification[J]. Laser & Optoelectronics Progress, 2018, 55(6): 409-416. DOI:10.3788/LOP55.062803 |

| [27] |

龙川, 苟永刚, 明镜, 等. 车载移动测量系统研制与应用实践[J]. 测绘通报, 2021(4): 120-125. LONG Chuan, GOU Yonggang, MING Jing, et al. Development and application of vehicle mobile mapping system[J]. Bulletin of Surveying and Mapping, 2021(4): 120-125. DOI:10.13474/j.cnki.11-2246.2021.0122 |

| [28] |

BRAUN A, TUTTAS S, BORRMANN A, et al. Improving progress monitoring by fusing point clouds, semantic data and computer vision[J]. Automation in Construction, 2020, 116(C). DOI:10.1016/j.autcon.2020.103210 |

| [29] |

KIM S, KIM S, LEE D E. Sustainable application of hybrid point cloud and BIM method for tracking construction progress[J]. Sustainability, 2020, 12. DOI:10.3390/su12104106 |

| [30] |

袁修孝. POS辅助光束法区域网平差[J]. 测绘学报, 2008, 37(3): 342-348. YUAN Xiuxiao. POS-supported bundle block adjustment[J]. Acta Geodaetica et Cartographica Sinica, 2008, 37(3): 342-348. |

| [31] |

JIA Shoujun, LIU Chun, WU Hangbin, et al. A cross-correction LiDAR SLAM method for high-accuracy 2D mapping of problematic scenario[J]. ISPRS Journal of Photogrammetry and Remote Sensing, 2021, 171(5): 367-384. DOI:10.1016/j.isprsjprs.2020.11.004 |

| [32] |

杨必胜, 董震. 点云智能研究进展与趋势[J]. 测绘学报, 2019, 48(12): 1575-1585. YANG Bisheng, DONG Zhen. Progress and perspective of point cloud intelligence[J]. Acta Geodaetica et Cartographica Sinica, 2019, 48(12): 1575-1585. DOI:10.11947/j.AGCS.2019.20190465 |

| [33] |

CHEN Y, GÉRARD M. Object modeling by registration of multiple range images[J]. Image and Vision Computing, 2002, 10(3): 145-155. DOI:10.1016/0262-8856(92)90066-C |

| [34] |

JI Shijun, REN Yongcong, ZHAO Ji, et al. An improved method for registration of point cloud[J]. Optik-International Journal for Light and Electron Optics, 2017, S0030402617300517. DOI:10.1016/j.ijleo.2017.01.041 |

| [35] |

BESL P J, MCKAY H D. A method for registration of 3D shapes[J]. IEEE Transactions on Pattern Analysis & Machine Intelligence, 1992, 14(2): 239-256. DOI:10.1109/34.121791 |

| [36] |

CHETVERIKOV D, STEPANOV D, KRSEK P. Robust Euclidean alignment of 3D point sets: the trimmed iterative closest point algorithm[J]. Image and Vision Computing, 2005, 23(3): 299-309. DOI:10.1016/j.imavis.2004.05.007 |

| [37] |

ZASS R, SHASHUA A. Probabilistic graph and hypergraph matching[C]//Proceedings of 2008 IEEE Conference on Computer Vision and Pattern Recognition. [S. l. ]: IEEE, 2008: 1-8. DOI: 10.1109/CVPR.2008.4587500.

|

| [38] |

EVANGELIDIS G D, KOUNADES-BASTIAN D, HORAUD R, et al. A generative model for the joint registration of multiple point sets[C]//Proceedings of 2014 European Conference on Computer Vision. Berlin, Germany: Springer International Publishing, 2014, 109-122. DOI: 10.1007/978-3-319-10584-0_8.

|

| [39] |

RUSU R B, BLODOW N, BEETZ M. Fast point feature histograms (FPFH) for 3D registration[C]//Proceedings of 2009 IEEE International Conference on Robotics and Automation. [S. l. ]: IEEE, 2009: 3212-3217.

|

| [40] |

TOMBARI F, SALTI S, D STEFANO L. Unique signatures of histograms for local surface description[C]//Proceedings of 2010 European Conference on Computer Vision. Berlin, Germany: Springer International Publishing, 2010: 356-369. DOI: 10.1007/978-3-642-15558-1_26.

|

| [41] |

LIU Y, KONG D, ZHAO D, et al. A point cloud registration algorithm based on feature extraction and matching[J]. Mathematical Problems in Engineering, 2018, 2018(PT.17): 1-9. DOI:10.1155/2018/7352691 |

| [42] |

ZAN G, ZHOU C, WEGNER J D, et al. The perfect match: 3D point cloud matching with smoothed densities[C]//Proceedings of 2019 IEEE Conference on Computer Vision and Pattern Recognition. Long Beack, CA, USA: IEEE, 2019, 5545-5554. DOI: 10.1109/CVPR.2019.00569.

|

| [43] |

YUAN W A, BY A, YC B, et al. JoKDNet: a joint keypoint detection and description network for large-scale outdoor TLS point clouds registration[J]. International Journal of Applied Earth Observation and Geoinformation, 2021, 104(15): 102534. DOI:10.1016/j.jag.2021.102534 |

| [44] |

MENG D, Du S, ZHU J, et al. Robust registration of partially overlapping point sets via genetic algorithm with growth operator[J]. Iet Image Processing, 2014, 8(10): 582-590. DOI:10.1049/iet-ipr.2013.0545 |

| [45] |

LEI H, JIANG G, QUAN L. Fast descriptors and correspondence propagation for robust global point cloud registration[J]. IEEE Transactions on Image Processing, 2017, 26(8): 3614-3623. DOI:10.1109/TIP.2017.2700727 |

| [46] |

XIN M, LI B, WEI X, et al. Rapid registration method by using partial 3D point clouds[J]. Optik-International Journal for Light and Electron Optics, 2021(2): 167764. DOI:10.1016/j.ijleo.2021.167764 |

| [47] |

WEINMANN M, URBAN S, HINZ S, et al. Distinctive 2D and 3D features for automated large-scale scene analysis in urban areas[J]. Computers & Graphics, 2015, 49: 47-57. DOI:10.1016/j.cag.2015.01.006 |

| [48] |

LI H X, XU L D. Feature space theory-a mathematical foundation for data mining[J]. Knowledge-Based Systems, 2001, 14(5-6): 253-257. DOI:10.1016/S0950-7051(01)00103-4 |

| [49] |

WEINMANN M, JUTZI B, HINZ S, et al. Semantic point cloud interpretation based on optimal neighborhoods, relevant features and efficient classifiers[J]. ISPRS Journal of Photogrammetry and Remote Sensing, 2015, 105(7): 286-304. DOI:10.1016/j.isprsjprs.2015.01.016 |

| [50] |

BO G, HUANG X, FAN Z, et al. Classification of airborne laser scanning data using JointBoost[J]. ISPRS Journal of Photogrammetry and Remote Sensing, 2015, 100: 71-83. DOI:10.1016/j.isprsjprs.2014.04.015 |

| [51] |

WEINMANN M, JUTZI B, MALLET C. Semantic 3D scene interpretation: a framework combining optimal neighborhood size selection with relevant features[J]. ISPRS Annals of Photogrammetry, Remote Sensing and Spatial Information Sciences, 2014, Ⅱ-3: 181-188. DOI:10.5194/isprsannals-Ⅱ-3-181-2014 |

| [52] |

SALTI S, TOMBAI F, STEFANO L D. SHOT: unique signatures of histograms for surface and texture description[J]. Computer Vision and Image Understanding, 2014, 125(1): 251-264. DOI:10.1016/j.cviu.2014.04.011 |

| [53] |

LIU F C, WANG S J, WANG J R, et al. 3D model retrieval based on fuzzy correspondences and hybrid shape features[C]//Proceedings of 2016 International Conference on Virtual Reality and Visualization (ICVRV). [S. l. ]: IEEE, 2016: 358-363. DOI: 10.1109/ICVRV.2016.67.

|

| [54] |

EITZ M, RICHTER R, BOUBEKEUR T, et al. Sketch-based shape retrieval[J]. Acm Transactions on Graphics, 2012, 31(4): 1-10. DOI:10.1145/2185520.2185527 |

| [55] |

GUO Y, SOHEL F, BENNAMOUN M, et al. Rotational projection statistics for 3D local surface description and object recognition[J]. International Journal of Computer Vision, 2013, 105(1): 63-86. DOI:10.1007/s11263-013-0627-y |

| [56] |

DONG Zhen, YANG Bisheng, LIU Yuan, et al. A novel binary shape context for 3D local surface description[J]. ISPRS Journal of Photogrammetry and Remote Sensing, 2017, 130: 431-452. DOI:10.1016/j.isprsjprs.2017.06.012 |

| [57] |

KHOURY M, ZHOU Q Y, KOLTUN V. Learning compact geometric features[C]//Proceedings of 2017 IEEE international conference on computer vision. Venice, Italy: IEEE, 2017: 153-161. DOI: 10.1109/ICCV.2017.26.

|

| [58] |

LI Nan, PFEIFER N, LIU Chun. Tensor-based sparse representation classification for urban airborne LiDAR points[J]. Remote Sensing, 2017, 9(12): 1216. DOI:10.3390/rs9121216 |

| [59] |

陈龙, 刘坤华, 周宝定, 等. 多智能体协同高精地图构建关键技术研究[J]. 测绘学报, 2021, 50(11): 1447-1456. CHEN Long, LIU Kunhua, ZHOU Baoding, et al. Key technologies of multi-agent collaborative high definition map construction[J]. Acta Geodaetica et Cartographica Sinica, 2021, 50(11): 1447-1456. DOI:10.11947/j.AGCS.2021.20210259 |

| [60] |

ZHAO Hengshuang, SHI Jianping, QI Xiaojuan, et al. Pyramid scene parsing network[C]//Proceedings of 2017 IEEE Conference on Computer Vision and Pattern Recognition (CVPR). [S. l. ]: IEEE, 2017: 2881-2890. DOI: 10.1109/CVPR.2017.660.

|

| [61] |

FENG Mingtao, ZHANG Liang, LIN Xuefei, et al. Point attention network for semantic segmentation of 3D point clouds[J]. Pattern Recognition, 2020, 107: 107446. DOI:10.1016/j.patcog.2020.107446 |

| [62] |

WWAB C, LDAB C, QEAB C, et al. Context-sensitive zero-shot semantic segmentation model based on meta-learning[J]. Neurocomputing, 2021, 465(20): 465-475. DOI:10.1016/j.neucom.2021.08.120 |

| [63] |

WEINMANN M, SCHMIDT A, MALLET C, et al. Contextual classification of point cloud data by exploiting individual 3D neigbourhoods[J]. ISPRS Annals of the Photogrammetry, Remote Sensing and Spatial Information Sciences, 2015, 2(W4): 271-278. DOI:10.1016/j.neucom.2021.08.120 |

| [64] |

FANG H, LAFARGE F. Pyramid scene parsing network in 3D: improving semantic segmentation of point clouds with multi-scale contextual information[J]. ISPRS Journal of Photogrammetry and Remote Sensing, 2019, 154: 246-258. DOI:10.1016/j.isprsjprs.2019.06.010 |

| [65] |

LUO Haifeng, CHEN Chongcheng, FANG Lina, et al. MS-RRFSegNet: multiscale regional relation feature segmentation network for semantic segmentation of urban scene point clouds[J]. IEEE Transactions on Geoscience and Remote Sensing, 2020, 58(12): 8301-8315. DOI:10.1109/TGRS.2020.2985695 |

| [66] |

张继贤, 林祥国, 梁欣廉. 点云信息提取研究进展和展望[J]. 测绘学报, 2017, 46(10): 1460-1469. ZHANG Jixian, LIN Xiangguo, LIANG Xinlian. Advances and prospects of information extraction from point clouds[J]. Acta Geodaetica et Cartographica Sinica, 2017, 46(10): 1460-1469. DOI:10.11947/j.AGCS.2017.20170345 |

| [67] |

ZHANG Liqiang, ZHANG Liang. Deep learning-based classification and reconstruction of residential scenes from large-scale point clouds[J]. IEEE Transactions on Geoscience and Remote Sensing, 2018, 56(4): 1887-1897. DOI:10.1109/TGRS.2017.2769120 |

| [68] |

SU H, MAJI S, KALOGERAKIS E, et al. Multi-view convolutional neural networks for 3D shape recognition[C]//Proceedings of 2015 IEEE International Conference on Computer Vision (ICCV). Santiago, Chile: IEEE, 2015: 945-953. DOI: 10.1109/ICCV.2015.114.

|

| [69] |

BOULCH A, GUERRY Y, SAUX B L, et al. SnapNet: 3D point cloud semantic labeling with 2D deep segmentation networks[J]. Computers & Graphics, 2017, 71(APR.): 189-198. DOI:10.1016/j.cag.2017.11.010 |

| [70] |

MATURANA D, SCHERER S. VoxNet: a 3D convolutional neural network for real-time object recognition[C]//Proceedings of 2015 IEEE/RSJ International Conference on Intelligent Robots and Systems (IROS). [S. l. ]: IEEE, 2015: 922-928. DOI: 10.1109/IROS.2015.7353481.

|

| [71] |

TCHAPMI L P, CHOY C B, ARMENI I, et al. SEGCloud: semantic segmentation of 3D point clouds[C]//Proceedings of 2017 International Conference on 3D Vision (3DV). Qingdao, China: IEEE, 2017: 537-547. DOI: 10.1109/3DV.2017.00067.

|

| [72] |

QI C R, SU H, MO K, et al. PointNet: deep learning on point sets for 3D classification and segmentation[C]//Proceedings of 2017 IEEE Conference on Computer Vision and Pattern Recognition (CVPR). Honolulu, HI, USA: IEEE, 2017: 77-85. DOI: 10.1109/CVPR.2017.16.

|

| [73] |

QI C R, LI Y, SU H, et al. PointNet++: Deep hierarchical feature learning on point sets in a metric space[C]//Proceedings of the 31st Annual Conference on Neural Information Processing Systems (NIPS). [S. l. ]: Advances in Neural Information Processing Systems, 2017, 30: 5100-5109.

|

| [74] |

王聪. 基于时空信息模型的智慧城市数字底座设计初探[J]. 测绘地理信息, 2021, 46(S1): 162-164. WANG Cong. Preliminary study on design of digital base for smart city based on spatio-temporal information model[J]. Journal of Geomatics, 2021, 46(S1): 162-164. DOI:10.14188/j.2095-6045.2020088 |

| [75] |

YU Bailang, LIU H, WU Jianping, et al. Automated derivation of urban building density information using airborne LiDAR data and object-based method[J]. Landscape & Urban Planning, 2010, 98(3-4): 210-219. DOI:10.1016/j.landurbplan.2010.08.004 |

| [76] |

顾建祥, 杨必胜, 董震, 等. 面向数字孪生城市的智能化全息测绘[J]. 测绘通报, 2020(6): 134-140. GU Jianxiang, YANG Bisheng, DONG Zhen, et al. Intelligent perfect-information surveying and mapping for digital twin cities[J]. Bulletin of Surveying and Mapping, 2020(6): 134-140. DOI:10.13474/j.cnki.11-2246.2020.0196 |

| [77] |

SHI Shaoshuai, WANG Xiaogang, LI Hongsheng. PointRCNN: 3D object proposal generation and detection from point cloud[C]//Proceedings of 2019 IEEE/CVF Conference on Computer Vision and Pattern Recognition (CVPR). [S. l. ]: IEEE, 2019: 770-779. DOI: 10.1109/CVPR.2019.00086.

|

| [78] |

WU Hangbin, YAO Lianbi, XV Zeran, et al. Road pothole extraction and safety evaluation by integration of point cloud and images derived from mobile mapping sensors[J]. Advanced Engineering Informatics, 2019(42): 100936.1-100936.11. DOI:10.1016/j.aei.2019.100936 |

| [79] |

ZHANG Shanxin, WANG Cheng, LIN Lili, et al. Automated visual recognizability evaluation of traffic sign based on 3D LiDAR point clouds[J]. Remote Sensing, 2019, 11(12): 1453. DOI:10.3390/rs11121453 |

| [80] |

CHEN Zhuo, LIU Chun, WU Hangbin. A higher-order tensor voting-based approach for road junction detection and delineation from airborne LiDAR data[J]. ISPRS Journal of Photogrammetry and Remote Sensing, 2019, 150(4): 91-114. DOI:10.1016/j.isprsjprs.2019.02.003 |

| [81] |

LIU Jingbin, XU Dong, JUHA H, et al. A survey of applications with combined BIM and 3D laser scanning in the life cycle of buildings[J]. IEEE Journal of Selected Topics in Applied Earth Observations and Remote Sensing, 2021(14): 5627-5637. DOI:10.1109/JSTARS.2021.3068796 |

| [82] |

TM A, TY A, TK A, et al. Quantitative evaluation of peeling and delamination on infrastructure surfaces by laser signal and image processing of 3D point cloud data[J]. Automation in Construction, 2022(133): 104023. DOI:10.1016/j.autcon.2021.104023 |

| [83] |

JIA Shoujun, LIU Chun, GUAN Xianjun, et al. Bidirectional interaction between BIM and construction processes using a multisource geospatial data enabled point cloud model[J]. Automation in Construction, 2022(134): 104096. DOI:10.1016/j.autcon.2021.104096 |

| [84] |

朱合华, 李晓军, 林晓东. 基础设施智慧服务系统(iS3)及其应用[J]. 土木工程学报, 2018, 51(1): 1-12. ZHU Hehua, LI Xiaojun, LIN Xiaodong. Infrastructure smart service system (iS3) and its application[J]. China Civil Eegineering Journal, 2018, 51(1): 1-12. DOI:10.15951/j.tmgcxb.2018.01.001 |

| [85] |

LIU Chun, SHAO Xiaohang, LI Weiyue. Multi-sensor observation fusion scheme based on 3D variational assimilation for landslide monitoring[J]. Geomatics Natural Hazards & Risk, 2019, 10(1): 151-167. DOI:10.1080/19475705.2018.1513871 |

| [86] |

JI Shunping, YU Dawen, SHEN Chaoyong, et al. Landslide detection from an open satellite imagery and digital elevation model dataset using attention boosted convolutional neural networks[J]. Landslides, 2020(17): 1337-1352. DOI:10.1007/s10346-020-01353-2 |

| [87] |

GHORBANZADEH O, BLASCHKE T, GHOLAMNIA K, et al. Evaluation of different machine learning methods and deep-learning convolutional neural networks for landslide detection[J]. Remote Sensing, 2019, 11(2): 196. DOI:10.3390/rs11020196 |

| [88] |

李玉美, 郭庆华, 万波, 等. 基于激光雷达的自然资源三维动态监测现状与展望[J]. 遥感学报, 2021, 25(1): 381-402. LI Yumei, GUO Qinghua, WAN Bo, et al. Current status and prospect of three-dimensional dynamic monitoring of natural resources based on LiDAR[J]. National Remote Sensing Bulletin, 2021, 25(1): 381-402. DOI:10.11834/jrs.20210351 |

| [89] |

LIU Chun, AI Mengchi, CHEN Zhuo, et al. Detection of firmiana danxiaensis canopies by a customized imaging system mounted on an UAV platform[J]. Journal of Sensors, 2018, 2018(9): 1-12. DOI:10.1155/2018/6869807 |

| [90] |

HU Tianyu, MA Q, SU Yanjun, et al. A simple and integrated approach for fire severity assessment using bi-temporal airborne LiDAR data[J]. International Journal of Applied Earth Observation and Geoinformation, 2019, 78: 25-38. DOI:10.1016/j.jag.2019.01.007 |

| [91] |

MA Q, SU Y, TAO Shengli, et al. Quantifying individual tree growth and tree competition using bi-temporal airborne laser scanning data: a case study in the Sierra Nevada Mountains, California[J]. International Journal of Digital Earth, 2018, 11(5): 485-503. DOI:10.1080/17538947.2017.1336578 |

| [92] |

霍芃芃, 侯庆明, 周庆, 等. 基于多种数据源的三维重建方法研究——以北京明长城为例[J]. 测绘通报, 2020(S1): 262-267. HUO Pengpeng, HOU Qingming, ZHOU Qing, et al. Research on 3D reconstruction based on multiple data sources: a case study of Ming Dynasty Great Wall in Beijing[J]. Bulletin of Surveying and Mapping, 2020(S1): 262-267. DOI:10.13474/j.cnki.11-2246.2020.0562 |

| [93] |

ALLEN P K, TROCCOLI A, SMITH B, et al. New methods for digital modeling of historic sites[J]. IEEE Computer Graphics and Applications, 2003, 23(6): 32-41. DOI:10.1109/MCG.2003.1242380 |

| [94] |

SAMPATH A, JIE S. Segmentation and reconstruction of polyhedral building roofs from aerial lidar point clouds[J]. IEEE Transactions on Geoscience and Remote Sensing, 2010, 48(3): 1554-1567. DOI:10.1109/TGRS.2009.2030180 |

| [95] |

田继成, 罗宏, 吴邵明. 三维激光扫描技术在云冈石窟13窟数字化中的应用[J]. 城市勘测, 2014(4): 23-26. TIAN Jicheng, LUO Hong, WU Shaoming. Application of 3D laser scanning technology in digital in Yungang grottoes cave 13[J]. Urban Geotechnical Investigation & Surveying, 2014(4): 23-26. |