2. 河北省信息传输与信号处理重点实验室, 河北 秦皇岛 066004

2. Hebei Key Laboratory of Information Transmission and Signal Processing, Qinhuangdao 066004, China

在全球在轨的对地观测卫星中,高分辨率光学遥感卫星占有较大比例,高分辨率遥感图像已成为对地精细观测的主要数据来源。随着《国家民用空间基础设施中长期发展规划(2015—2025年)》和中国高分辨率对地观测系统等重大战略性工程的实施,国产高分辨率遥感数据日益丰富[1]。高空间分辨率遥感图像具有背景复杂、目标密集、地物纹理信息丰富等特点,对高空间分辨率遥感图像进行语义分割可以清楚了解地物要素的分布信息,有利于城市精细化管理、自然资源监测、精准测绘和军事国防建设。

遥感图像语义分割旨在为遥感图像中的每个像素标注类别标签,主要分为3类:传统的无监督学习分割方法、基于浅层学习模型的分割方法和基于深度学习模型的分割方法。传统的无监督学习图像分割多采用阈值分割[2]、边缘检测分割[3]、区域分割[4]及图切分割[5]等方法。这些方法根据图像的灰度、颜色及纹理形状等特征把图像划分成若干互不重叠的区域,在同一区域内具有相似性,不同区域内呈现差异性。然而,这些传统无监督学习分割方法没有数据训练阶段,通常采用手动的方式提取特征和建立模型,在较困难的分割任务中分割精度的提升空间有限。基于浅层学习模型的遥感图像语义分割方法包括经典的人工神经网络[6]、支持向量机[7]和随机森林[8]等方法,这些方法不能提取高层语义信息,其泛化能力也受到一定限制。近年来深度学习模型快速发展,遥感图像处理领域逐渐开始使用深度学习算法[9-10],较传统方法性能有较大的提升。随着FCN[11]、U-Net[12]、SegNet[13]、DeepLab[14-15]等网络模型在自然和医学图像上分割的成功,深度神经网络逐步成为遥感图像语义分割的研究热点。文献[16]提出一种基于FCN网络的深度多尺度空间光谱特征提取算法,在高光谱遥感图像上实现良好的分割效果。文献[17]基于U-Net网络结构,提出一种多注意力融合U型模型,利用注意力模块处理不同层次信息,增强不同特征之间的相关性,进而提升语义分割性能。文献[18]通过对SegNet等分割网络架构嵌入可变形卷积结构,并采用条件随机场对特征进行处理,有效克服了遥感图像的复杂结构对分割性能的影响。文献[19]利用语义分割网络DeepLab v2对高光谱图像进行逐像素的空间特征提取,采用多个尺度的方法提取特征,另外通过加权融合的方法将在DeepLab v2模型上提取的空间特征与高光谱图像的光谱特征进行融合,进一步提高了遥感图像语义分割性能。文献[20]结合DeepLab v3+网络和基于对象的图像分析方法,在高分辨率遥感图像上取得良好的分割效果。文献[21]设计了空洞卷积组块和最大池化组块,通过聚合不同层次的语义信息,提高语义分割网络的上下文感知能力。

然而,现有的基于深度学习的遥感图像语义分割模型中存在卷积、下采样等操作会导致边界特征信息损失、地物要素边界分割不理想,以及地物要素内部出现破碎小图斑等问题。针对此问题,本文提出一种双解耦语义分割网络(dual decoupling semantic segmentation network,DDSSN),分别对遥感图像中的地物要素边界和主体部分进行建模,重构空间特征信息。该模型将特征图分离成对象主体(body)部分和对象边界(edge)部分:主体对应特征图的低频部分,包含对象内部特征信息;边界对应特征图的高频部分,包含对象边界细节信息。最后将得到的主体和边界部分利用设计的损失函数来进行优化学习,改善边界分割不准确以及对象内部的“破碎小图斑”问题,进而提高语义分割精度。

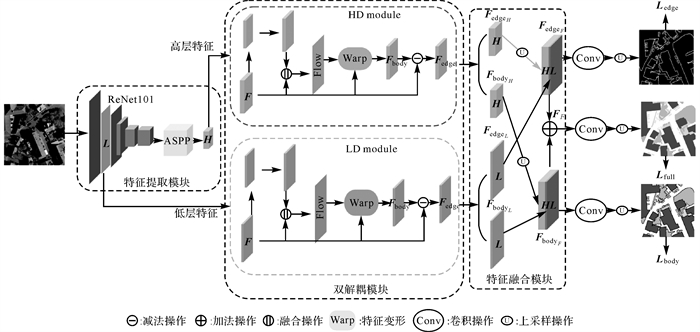

1 双解耦语义分割网络模型介绍双解耦语义分割网络结构如图 1所示,主要分为3个模块,分别为特征提取模块、双解耦网络模块和特征融合模块。特征提取模块的骨干网络采用ResNet101[22]网络,并结合ASPP(atrous spatial pyramid pooling)[15]结构进行多尺度空间特征提取,在特征提取模块中分别获取低层特征与高层特征,低层特征输入到低层特征解耦模块(low level feature decoupling module,LD module),高层特征输入到高层特征解耦模块(high level feature decoupling module,HD module)。随后利用双解耦网络模块生成低层特征和高层特征的主体及边界部分:将特征提取模块提取的低层和高层特征分别进行流场(Flow)预测,然后对流场进行变形(Warp)操作,将特征图中每个像素指向对象的主体部分,从而生成与对象主体部分更加一致的主体特征,随后将输入解耦模块的特征图与生成的主体特征图相减得到对象边界部分。特征融合模块将低层特征的边界部分和高层特征的边界部分进行融合,主体部分也做相同的融合处理,从而得到信息更丰富的边界部分和主体部分。模型最后将充分融合的边界部分特征FedgeF和主体部分特征FbodyF进行相加得到最终合并后的整体特征FF。受Deeplab v3+模型[14]的启发,最后将主体特征、边界特征和整体特征分别采用3×3卷积进行优化,然后采用4倍上采样操作得到与输入遥感图片尺寸一致的语义分割图。

|

| 图 1 双解耦语义分割网络结构 Fig. 1 The architecture of DDSSN |

1.1 特征提取模块

特征提取模块用于获取两级特征信息,分别包含更多空间信息的低层特征和更多语义信息的高层特征。深层网络在反传时容易发生梯度弥散现象,ResNet网络能有效缓解梯度弥散,并且有利于网络在训练过程中快速收敛,基于此本文采用ResNet系列中ResNet101模型进行特征提取。ResNet101由一个卷积层、一个池化层和4个残差块组成。由于ResNet101网络池化层得到的特征图包含更多的空间信息,故将其作为低层特征输入到双解耦网络。本文进一步采用ASPP模块的空洞卷积(atrous convolution),利用不同的扩张率进行多尺度特征提取。对于高层特征的选取,将ResNet101中池化层所得到的特征图经过4个残差块后再经过一个ASPP模块,此时的特征已包含更丰富的语义信息,ASPP模块得到的特征图作为双解耦网络的高层特征输入部分。

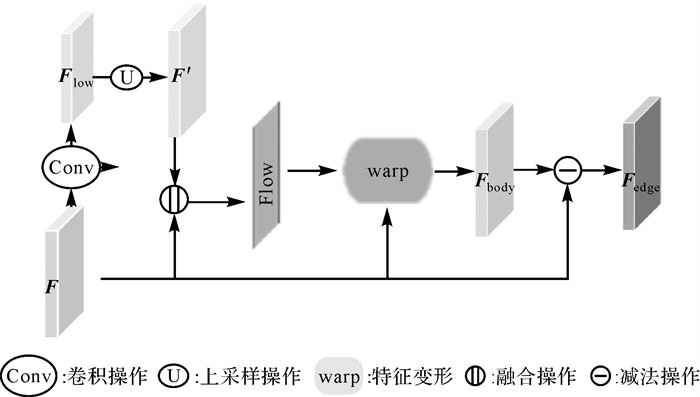

1.2 解耦网络模块人眼天生通过对象的主体和边界信息识别物体[23],受此启发,本文将特征图中的主体和边界部分分别进行建模,提出双解耦网络模块。双解耦网络包括低层和高层特征解耦模块,在统一框架中利用不同的损失函数进行优化,提高对象主体内部信息一致性及边界准确性,进而提高分割精度。两个解耦模块的计算流程相同,如图 2所示,包括特征图流场计算部分,主体和边界特征图计算部分。利用生成的流场和Warp操作对特征图进行计算,从而生成主体部分特征图Fbody,边界部分特征图Fedge利用输入的F和Fbody相减得到。

|

| 图 2 解耦模块结构 Fig. 2 The architecture of decoupling module |

1.2.1 特征图流场计算

流场计算主要是借鉴视频处理任务中的光流[24]的方法。利用相邻特征图得到特征流场,并通过生成的特征流场将像素指向对象内部,从而突出主体部分的特征信息。流场可以生成指向对象内部主体的偏移量,通过特征提取模块获取特征图F∈RC×H×W,其中C代表特征图的通道数,H和W分别代表特征图的高度和宽度。将特征F通过两个3×3的跨步卷积来生成低分辨率特征图Flow,随后通过双线性插值将Flow上采样得到与F特征同尺寸的特征F′,并将F′与F进行特征融合和流场预测Δ∈ R2×H×W[25],具体流场计算的公式为

(1)

(1)

式中,‖表示通过串联的方式将特征进行融合;Conv(·)表示采用3×3的卷积操作。

1.2.2 主体和边界特征图计算将特征图分离成两部分,一部分是具有低频特性的Fbody,另一部分是具有高频特性的Fedge。Fbody主要利用相邻特征图F和F′生成的特征流场与Warp操作得到,利用生成的特征流场将标准空间网格上的像素点p映射到像素点p′=

(2)

(2)

式中,N(p′)表示像素p′的相邻像素;wpl表示空间网格距离估计的双线性核权重。新得到的Fbody(p′)与对象的中间部分信息更一致,从而得到主体特征部分Fbody。利用上述所生成的主体特征Fbody与F进行减法操作Fedge=F-Fbody,进而得到包含高频空间信息的边界特征部分。

1.3 特征融合模块通过两级解耦模块分别得到包含更多空间细节信息的低层特征FbodyL和FedgeL,以及包含更多语义信息的高层特征FbodyH和FedgeH。将解耦网络得到的低层特征FbodyL部分和高层特征FbodyH部分进行串联融合得到FbodyF,以及低层特征的边界部分FedgeL和高层特征的边界部分FedgeH同样进行串联融合操作得到FedgeF。特征融合模块计算得到的特征图FF即为FbodyF和FedgeF之和,具体计算公式为

(3)

(3)

式中,‖表示将两部分特征通过串联的方式进行融合。网络将分别得到3部分特征,其中一部分是低层和高层的主体特征融合后的主体特征部分,另一部分是低层和高层的边界特征融合后的边界部分,最后的整体特征是主体和边界两部分的融合特征。

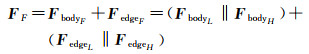

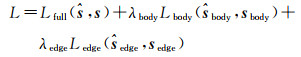

1.4 损失函数本文提出的损失函数包括整体、主体和边界3种损失,损失函数L计算公式为

(4)

(4)

式中,Lfull、Lbody、Ledge分别表示整体、主体及边界损失函数;

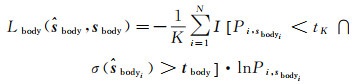

整体损失函数Lfull采用经典的交叉熵损失函数。Lbody在自引导交叉熵(weighted bootstrapped crossentropy)损失函数[27]的基础上增加了对主体部分的约束,具体计算公式为

(5)

(5)

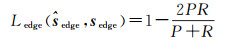

式中,K=0.15·N表示所要计算的损失较大的像素数目,N表示图像像素总数;Pi, sbodyi表示像素i和类别Sbodyi的后验概率;阈值tK表示K个最高损失中的最小值;σ表示softmax函数,利用阈值tbody判断是否属于主体部分像素,当小于阈值tbody用空值覆盖。在试验中阈值tbody设置为0.8,进而针对主体部分进行训练。Ι[ · ] 表示条件成立则Ι[ · ] =1,否则为0。边界部分损失函数Ledge使用边界损失函数Boundary Loss[28],计算公式为

(6)

(6)

(7)

(7)

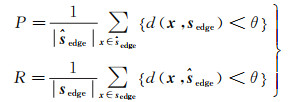

式中,{·} 表示逻辑函数;d(·)表示像素间的欧氏距离;θ表示欧氏距离的阈值,本文试验中将θ设为5。

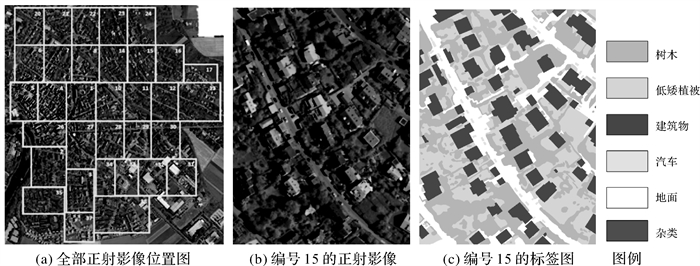

2 研究区域和数据预处理本文采用在德国Vaihingen和Potsdam地区获取的ISPRS 2D语义分割数据集进行试验评估。ISPRS Vaihingen 2D数据集由正射影像(true orthophoto,TOP)、数字表面模型(digital surface model,DSM)和归一化数字表面模型(normalized digital surface model,NDSM)数据组成。如图 3所示,数据集包含33幅空间分辨率为9 cm的正射影像图,每幅影像包含3个光谱波段:近红外(NIR)、红光(R)和绿光(G)。试验数据采用33张TOP图像及其对应的真实分割标签图,将33张图像划分为训练集、验证集和测试集,具体划分比例为12∶4∶17,其中训练集采用编号ID为{1,3,7,11,13,17,23,26,28,32,34,37},验证集采用编号ID为{5,15,21,30},剩余的17张作为测试集。

|

| 图 3 ISPRS Vaihingen 2D数据集 Fig. 3 ISPRS Vaihingen 2D dataset |

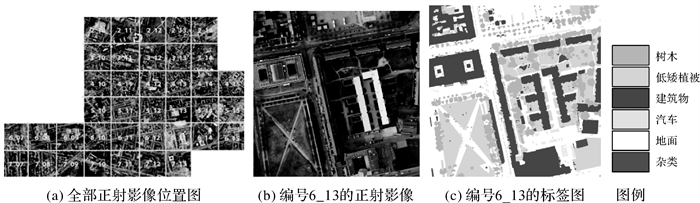

ISPRS Potsdam 2D数据集由正射影像(TOP)、数字表面模型(DSM)和归一化数字表面模型(NDSM)数据组成。如图 4所示,数据集包含38幅空间分辨率为5 cm的正射影像图,试验中使用Potsdam数据集中的3个光谱波段:红光(R)、绿光(G)和蓝光(B)。试验中将38张图片划分为训练集、验证集和测试集,具体划分比例为9∶3∶7。其中训练集采用编号ID为{2_10,2_11,3_10,3_11,4_10,4_11,5_10,5_11,6_7,6_8,6_9,6_10,6_11,7_7,7_8,7_9,7_10,7_11},验证集采用编号ID为{2_12,3_12,4_12,5_12,6_12,7_12},剩下的14张作为测试集。Vaihingen和Potsdam数据集都包括6种类别:树木、低矮植被、建筑物、汽车、地面和杂类。

|

| 图 4 ISPRS Potsdam 2D数据集 Fig. 4 ISPRS Potsdam 2D dataset |

3 试验设置与结果分析 3.1 试验设置

针对所提出的双解耦语义分割网络模型进行参数设置,优化器使用自适应动量估计(adaptive moment estimation,Adam),学习率设置为e-5,权重衰减(weight decay)设置为0.000 5,训练回合数(Epoch)设置为30,批大小设置为8。由于高分辨率遥感图像数据集单幅影像尺寸过大,直接输入模型会导致显存不足。因此,将数据集中的每幅遥感图像随机裁剪成大小(patch size)为256×256的图像块作为模型的输入。试验中为了防止过拟合,采用镜像翻转180°和随机旋转180°来增加训练样本量,最终得到30 000张256×256的图像块进行模型训练。将测试集的遥感图像同样裁剪成256×256的图像块输入训练好的模型进行预测,最后的分割结果通过拼接形成完整的语义分割图。试验在Linux操作系统上进行,采用PyTorch深度学习框架编程实现。

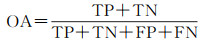

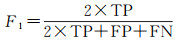

3.2 评价指标本文试验中所采用的评价指标有总体精度OA(overall accuracy)、F1值及mIoU(mean Intersection-over-Union)计算公式为

(8)

(8)

(9)

(9)

(10)

(10)

式中,m表示类别数;TP、FP、FN、TN含义见表 1。

| 混淆矩阵 | 预测 | 预测 |

| 真值 | true positive(TP) | false negative(FN) |

| 真值 | false positive(FP) | true negative(TN) |

3.3 结果与分析 3.3.1 对比试验

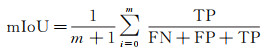

为了验证所提方法的有效性,将本文提出的DDSSN模型与ResNet101、SegNet、U-Net、PSPNet、FCN、DeepLab v3+进行定性和定量对比试验,其中FCN采用分割效果最好的FCN-8s[11]模型。针对ISPRS Vaihingen 2D数据集对不同模型的语义分割结果可视化并进行定性分析。图 5是编号为2的Vaihingen正射影像及其对应的真实标签图和不同模型的分割结果图,从视觉上可以看出DDSSN模型的整体分割效果更优,与真实标签最接近。由图 5中红圈标记处可以看出,DDSSN分割杂类正确的像素数目最多,ResNet101、U-Net和PSPNet将部分杂类误分为地面。其次,DeepLab v3+和DDSSN分割汽车效果较为理想,SegNet和FCN-8s有较多杂类误分为汽车。DDSSN模型在建筑物边界处分割效果更为准确,同时有效改善类别内部“破碎小图斑”的现象,从视觉效果上也更加接近真实的地物分布。最后,7种分割模型分割地面和树木均存在错分的现象,但DDSSN模型从整体上效果更优,错分的像素数目相比较更少。

|

| 图 5 编号为2的Vaihingen正射影像分割结果 Fig. 5 The Vaihingen TOP ID 2 segmentation map |

本文采用F1值、Mean F1、OA及mIoU定量对比分析ISPRS Vaihingen数据集试验结果。表 2给出了6种地物类别的F1值和Mean F1,可以看出本文所采用的DDSSN模型Mean F1精度最高,比ResNet101模型高近12个百分点,比SegNet模型高5个百分点。在杂类上DDSSN模型的F1值达到54%以上。从OA和mIoU两个评价指标看,DDSSN模型的精度都是最高,分别达到89.96%和73.56%,指标mIoU比ResNet101模型高17个百分点,比SegNet模型高6个百分点,比DeepLabv3+高3.14个百分点。定量试验结果充分证实了本文方法的有效性。

| 方法 | F1值/(%) | Mean F1/(%) |

OA /(%) |

mIoU /(%) |

|||||

| 地面 | 建筑物 | 低矮植被 | 树木 | 汽车 | 杂类 | ||||

| ResNet101 | 87.89 | 91.45 | 79.32 | 87.10 | 54.33 | 29.12 | 71.54 | 83.44 | 56.02 |

| SegNet | 90.06 | 92.63 | 81.34 | 88.06 | 71.68 | 48.41 | 78.69 | 88.04 | 67.20 |

| U-Net | 90.12 | 91.88 | 81.25 | 88.10 | 72.56 | 47.75 | 78.61 | 88.12 | 67.53 |

| FCN-8s | 89.10 | 90.56 | 79.70 | 87.25 | 70.85 | 36.21 | 75.61 | 86.68 | 63.95 |

| PSPNet | 90.32 | 92.01 | 81.59 | 89.22 | 75.39 | 45.65 | 79.03 | 88.96 | 68.20 |

| DeepLab v3+ | 90.87 | 93.16 | 82.32 | 89.42 | 84.01 | 44.72 | 80.75 | 89.05 | 70.42 |

| DDSSN | 92.01 | 94.25 | 83.31 | 89.58 | 87.18 | 54.26 | 83.43 | 89.96 | 73.56 |

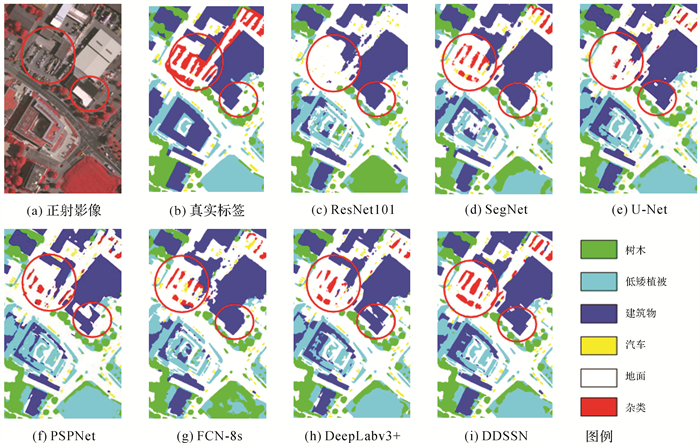

使用ISPRS Potsdam 2D数据集对不同模型的语义分割结果可视化并进行定性分析。图 6是编号为7_13的Potsdam正射影像的局部细节图及其对应的真实标签图和不同模型的分割结果图,由图 6可以看出,ResNet101、SegNet、U-Net和FCN-8s将大部分杂类误分为地面,PSPNet将部分杂类误分为低矮植被,DeepLabv3+模型在杂类部分区域边界定位不准确,而DDSSN模型在杂类的边界处分割效果更接近真实标签图。在图片左上角,ResNet101、U-Net和FCN-8s将地面误分为建筑,SegNet将地面误分为建筑和杂类。从整体分割结果来看,本文所提出的模型在类别对象边界处分割更加准确,地物要素的轮廓更加清晰,且地物要素内部信息也更加完整,从而证实DDSSN模型的有效性。

|

| 图 6 编号为7_13的Potsdam正射影像分割结果细节 Fig. 6 A detailed view of the segmentation map of the Potsdam TOP ID 7_13 |

本文对ISPRS Potsdam数据集采用F1值、Mean F1、OA及mIoU进行定量对比分析。表 3给出了6种地物类别的F1值和Mean F1,由表 3可以看出,本文所采用DDSSN模型Mean F1精度最高,比ResNet101模型高11.51个百分点,比SegNet模型高7.49个百分点。从OA和mIoU两个评价指标看,DDSSN模型的精度都是最高,比ResNet101模型高9.6个百分点,比SegNet模型高5.51个百分点,定量试验结果充分证实了本文方法的有效性。

| 方法 | F1值/(%) | Mean F1/(%) |

OA /(%) |

mIoU /(%) |

|||||

| 地面 | 建筑物 | 低矮植被 | 树木 | 汽车 | 杂类 | ||||

| ResNet101 | 85.57 | 87.08 | 79.08 | 75.14 | 90.11 | 31.30 | 74.71 | 80.92 | 63.00 |

| SegNet | 88.35 | 91.48 | 81.89 | 81.38 | 91.52 | 37.78 | 78.73 | 85.01 | 68.17 |

| U-Net | 87.36 | 89.80 | 80.80 | 79.06 | 92.06 | 34.79 | 77.31 | 83.51 | 66.42 |

| FCN-8s | 87.53 | 89.89 | 81.14 | 79.32 | 91.87 | 34.97 | 77.45 | 83.68 | 66.60 |

| PSPNet | 91.66 | 92.31 | 83.52 | 82.56 | 93.20 | 44.69 | 81.32 | 88.26 | 73.89 |

| DeepLab v3+ | 92.20 | 95.74 | 87.04 | 87.91 | 95.53 | 55.52 | 85.65 | 90.09 | 77.12 |

| DDSSN | 92.79 | 96.20 | 87.15 | 88.66 | 95.76 | 56.75 | 86.22 | 90.52 | 77.93 |

3.3.2 模型分析

为了充分证明所提出的解耦模块的有效性,本文利用Vaihingen数据集进行模型分析试验。在双解耦网络模型中依次去除高层特征解耦模块(HD module)、低层特征解耦模块(LD module),试验结果见表 4:在去除高层特征解耦模块后mIoU下降2.74%,OA下降0.97%,Mean F1下降2.26%,由结果可以看出,高层特征解耦模块能有效提升分割精度,而去除低层特征解耦模块后mIoU下降1.04%,OA下降0.5%,Mean F1下降0.73%,说明低层特征解耦模块也能增强语义分割性能。将两级特征的主体和边界分别进行融合之后能重构丢失的空间特征信息,进而分割精度更高,联合使用低层特征解耦模块与高层特征解耦模块效果更优,进一步证实了本文所提出双解耦模块的有效性。

| LD module |

HD module |

MeanF1 /(%) |

OA /(%) |

mIoU /(%) |

ΔmIoU /(%) |

| √ | 81.17 | 88.99 | 70.82 | ↓2.74 | |

| √ | 82.70 | 89.46 | 72.52 | ↓1.04 | |

| √ | √ | 83.43 | 89.96 | 73.56 | - |

针对所提出的DDSSN模型所使用的损失函数进行分析试验,首先针对损失函数的权重系数进行分析试验,在试验中权重设置利用控制变量法,λedge和λbody参数设置及试验结果见表 5。当λedge=2且λbody=1时,分割精度达到最高,当λedge取值远小于λbody时分割效果较差,说明λedge的取值对结果的影响较大,边界损失函数对模型的提高具有主要作用。当λbody远小于λedge时分割精度也呈下降趋势,说明主体损失函数对分割结果的提高也有重要作用。结果表明适当提高边界损失函数的权重有助于分割准确性的提高。

| λedge | λbody | mIoU/(%) | OA/(%) | Mean F1/(%) |

| 1 | 0.01 | 71.71 | 89.26 | 81.97 |

| 1 | 0.1 | 72.31 | 89.17 | 82.70 |

| 1 | 1 | 72.77 | 89.56 | 82.87 |

| 1 | 2 | 72.78 | 89.64 | 82.83 |

| 1 | 3 | 72.77 | 89.69 | 82.84 |

| 0.01 | 1 | 71.32 | 88.98 | 81.69 |

| 0.1 | 1 | 71.56 | 89.00 | 81.82 |

| 2 | 1 | 73.56 | 89.96 | 83.43 |

| 3 | 1 | 72.19 | 89.00 | 82.48 |

其次,在双解耦模块的基础上,分别去除边界损失(Ledge)和主体损失(Lbody)进行分析试验,具体试验结果见表 6。可以看出在双解耦语义分割网络中同时去掉边界损失函数和主体损失函数,mIoU下降了2.81%,OA下降了0.79%,Mean F1下降了2.65%。去掉边界损失函数,分割结果mIoU下降了1.78%,OA下降了0.94%,Mean F1下降了1.70%,这是由于无法针对边界处的信息进行优化学习,进而使得分割精度下降。在双解耦语义分割网络中去掉主体损失函数,使得分割结果mIoU下降了1.09%,OA下降了0.37%,Mean F1下降了1.04%,这是因为主体损失函数能够针对主体部分特征的信息进行优化,使得分割结果与真实标签的对象内部保持一致,提高像素间的空间连续性,减少对象内部“破碎小图斑”的现象,提升语义分割效果。从结果可以看出联合使用两个损失函数的效果优于仅使用边界损失函数或主体损失函数。损失函数分析试验证实了本文使用的主体和边界损失函数的有效性。

| Lbody | Ledge | MeanF1 /(%) |

OA /(%) |

mIoU /(%) |

ΔmIoU /(%) |

| - | - | 80.78 | 89.17 | 70.75 | ↓2.81 |

| √ | 81.73 | 89.02 | 71.78 | ↓1.78 | |

| √ | 82.39 | 89.59 | 72.47 | ↓1.09 | |

| √ | √ | 83.43 | 89.96 | 73.56 | - |

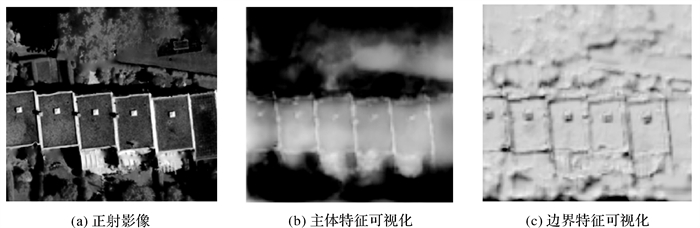

3.3.3 主体和边界特征可视化

为了进一步分析双解耦模型的可靠性,将解耦模块得到的主体和边界特征图分别进行可视化。将分块后的遥感图像输入双解耦模型,并分别可视化融合后的主体和边界特征图部分,可视化结果如图 7所示,虽然图中没有明确表示出地物要素的类别,但是可以通过区域与区域之间的差异性来传递语义信息。对图 7进行分析可以看出,图 7中(b)和(c)两幅特征图存在互补性。图 7(b)中主体特征图突出了主体部分,主体部分的像素共享相似的特征表示。图 7(c)中边界特征图突出了较多的边界细节信息。特征可视化进一步说明本文提出的模型DDSSN通过将对象的主体和边界特征解耦,对主体部分建模来增强地物要素主体内部一致性,对边界部分建模可以更好地定位边界的位置信息,为高精度语义分割奠定了基础。

|

| 图 7 主体和边界特征可视化 Fig. 7 Visualization of body and edge features |

4 结论

本文针对高分辨率遥感图像提出一种双解耦语义分割网络模型DDSSN,设计两个即插即用的解耦模块,分别对低层特征图与高层特征图进行解耦,充分学习并优化对象边界和对象主体信息,从而提高遥感图像的地物要素分割精度。DDSSN模型的损失函数包含整体、主体和边界3种损失,分别对整体、主体和边界特征进行优化。在ISPRS Vaihingen和Potsdam 2D语义分割数据集上试验,与ResNet101、SegNet、U-Net、PSPNet、FCN-8s和Deeplab v3+网络模型对比,DDSSN模型在Mean F1、OA和mIoU 3个评价指标上精度均为最高,结果表明DDSSN模型可以有效提高边界处的分割精度,同时有效抑制了对象内部“破碎小图斑”的现象。模型分析试验进一步证实了双解耦模块和损失函数的有效性,本文所提出的双解耦模块是轻量级的,可以插入其他端到端的网络模型中。虽然本文通过数据增强的方法扩充训练样本,但提出的模型依然对训练样本有较高的依赖性,笔者将进一步改进所提出的模型结构,引入半监督的方法在减少训练样本的同时提高分割精度。

| [1] |

刘东升, 廖通逵, 孙焕英, 等. 中国遥感软件研制进展与发展方向: 以像素专家PIE为例[J]. 中国图象图形学报, 2021, 26(5): 1169-1178. LIU Dongsheng, LIAO Tongkui, SUN Huanying, et al. Research progress and development direction of Chinese remote sensing software: taking PIE as an example[J]. Journal of Image and Graphics, 2021, 26(5): 1169-1178. |

| [2] |

HUANG D, WANG C. Optimal multi-level thresholding using a two-stage Otsu optimization approach[J]. Pattern Recognition Letters, 2009, 30(3): 275-284. DOI:10.1016/j.patrec.2008.10.003 |

| [3] |

AL-AMRI M, KALYANKAR N V, KHAMITKAR S D. Image segmentation by using edge detection[J]. International Journal of Advanced Trends in Computer Science and Engineering, 2010, 2(3): 804-807. |

| [4] |

NAZIF A M, LEVINE M D. Low level image segmentation: an expert system[J]. IEEE Transactions on Pattern Analysis and Machine Intelligence, 1984, 6(5): 555-577. |

| [5] |

SHI J, MALIK J. Normalized cuts and image segmentation[J]. IEEE Transactions on Pattern Analysis and Machine Intelligence, 2000, 22(8): 888-905. DOI:10.1109/34.868688 |

| [6] |

SATHYA P, MALATHI L. Classification and segmentation in satellite imagery using back propagation algorithm of ANN and K-means algorithm[J]. International Journal of Machine Learning and Computing, 2011, 1(4): 422-426. |

| [7] |

LIZARAZO I. SVM-based segmentation and classification of remotely sensed data[J]. International Journal of Remote Sensing, 2008, 29(24): 7277-7283. DOI:10.1080/01431160802326081 |

| [8] |

BELGIU M, DRAGUT L. Random forest in remote sensing: a review of applications and future directions[J]. ISPRS Journal of Photogrammetry and Remote Sensing, 2016, 114: 24-31. DOI:10.1016/j.isprsjprs.2016.01.011 |

| [9] |

ZHU X, TUIA D, MOU L, et al. Deep learning in remote sensing: a comprehensive review and list of resources[J]. IEEE Geoscience and Remote Sensing Magazine, 2017, 5(4): 8-36. DOI:10.1109/MGRS.2017.2762307 |

| [10] |

LI Shutao, SONG Weiwei, FANG Leyuan, et al. Deep learning for hyperspectral image classification: an overview[J]. IEEE Transactions on Geoscience and Remote Sensing, 2019, 57(9): 6690-6709. DOI:10.1109/TGRS.2019.2907932 |

| [11] |

SHELHAMER E, LONG J, DARRELL T. Fully convolutional networks for semantic segmentation[J]. IEEE Transactions on Pattern Analysis and Machine Intelligence, 2017, 39(4): 640-651. DOI:10.1109/TPAMI.2016.2572683 |

| [12] |

RONNEBERGER O, FISCHER P, BROX T. U-net: convolutional networks for biomedical image segmentation[M]//Lecture Notes in Computer Science. Cham: Springer International Publishing, 2015: 234-241.

|

| [13] |

BADRINARAYANAN V, KENDALL A, CIPOLLA R. SegNet: a deep convolutional encoder-decoder architecture for image segmentation[J]. IEEE Transactions on Pattern Analysis and Machine Intelligence, 2017, 39(12): 2481-2495. DOI:10.1109/TPAMI.2016.2644615 |

| [14] |

CHEN L, ZHU Y, PAPANDREOU G, et al. Encoder-decoder with atrous separable convolution for semantic image segmentation[C]//Proceedings of 2018 European Conference on Computer Vision. Munich, Germany: Springer, 2018: 801-818.

|

| [15] |

CHEN L C, PAPANDREOU G, KOKKINOS I, et al. DeepLab: semantic image segmentation with deep convolutional nets, atrous convolution, and fully connected CRFs[J]. IEEE Transactions on Pattern Analysis and Machine Intelligence, 2018, 40(4): 834-848. DOI:10.1109/TPAMI.2017.2699184 |

| [16] |

JIAO Licheng, LIANG Miaomiao, CHEN Huan, et al. Deep fully convolutional network-based spatial distribution prediction for hyperspectral image classification[J]. IEEE Transactions on Geoscience and Remote Sensing, 2017, 55(10): 5585-5599. DOI:10.1109/TGRS.2017.2710079 |

| [17] |

李道纪, 郭海涛, 卢俊, 等. 遥感影像地物分类多注意力融和U型网络法[J]. 测绘学报, 2020, 49(8): 1051-1064. LI Daoji, GUO Haitao, LU Jun, et al. A remote sensing image classification procedure based on multilevel attention fusion U-Net[J]. Acta Geodaetica et Cartographica Sinica, 2020, 49(8): 1051-1064. DOI:10.11947/j.AGCS.2020.20190407 |

| [18] |

左宗成, 张文, 张东映. 融合可变形卷积与条件随机场的遥感影像语义分割方法[J]. 测绘学报, 2019, 48(6): 718-726. ZUO Zongcheng, ZHANG Wen, ZHANG Dongying. A remote sensing image semantic segmentation method by combining deformable convolution with conditional random fields[J]. Acta Geodaetica et Cartographica Sinica, 2019, 48(6): 718-726. DOI:10.11947/j.AGCS.2019.20170740 |

| [19] |

NIU Zijia, LIU Wen, ZHAO Jingyi, et al. DeepLab-based spatial feature extraction for hyperspectral image classification[J]. IEEE Geoscience and Remote Sensing Letters, 2019, 16(2): 251-255. DOI:10.1109/LGRS.2018.2871507 |

| [20] |

DU Shouji, DU Shihong, LIU Bo, et al. Incorporating DeepLabv3+ and object-based image analysis for semantic segmentation of very high resolution remote sensing images[J]. International Journal of Digital Earth, 2021, 14(3): 357-378. DOI:10.1080/17538947.2020.1831087 |

| [21] |

王忠武, 王志盼, 尤淑撑, 等. Landsat影像冰川提取的上下文感知语义分割网络法[J]. 测绘学报, 2020, 49(12): 1575-1582. WANG Zhongwu, WANG Zhipan, YOU Shucheng, et al. Landsat image glacier extraction based on context semantic segmentation network[J]. Acta Geodaetica et Cartographica Sinica, 2020, 49(12): 1575-1582. DOI:10.11947/j.AGCS.2020.20190313 |

| [22] |

HE Kaiming, ZHANG Xiangyu, REN Shaoqing, et al. Deep residual learning for image recognition[C]//Proceedings of 2016 IEEE Conference on Computer Vision and Pattern Recognition (CVPR). Las Vegas, NV, USA: IEEE, 2016: 770-778.

|

| [23] |

LI Xiangtai, Li Xia, Zhang Li, et al. Improving semantic segmentation via decoupled body and edge supervision[C]//Proceedings of 2020 European Conference on Computer Vision. Glasgow, UK: Springer, 2020: 435-452.

|

| [24] |

ZHU Xizhou, XIONG Yuwen, DAI Jifeng, et al. Deep feature flow for video recognition[C]//Proceedings of 2017 IEEE Conference on Computer Vision and Pattern Recognition (CVPR). Honolulu, HI, USA: IEEE, 2017: 4141-4150.

|

| [25] |

DOSOVITSKIY A, FISCHER P, ILG E, et al. FlowNet: learning optical flow with convolutional networks[C]//Proceedings of 2015 IEEE International Conference on Computer Vision (ICCV). Santiago, Chile: IEEE, 2016: 2758-2766.

|

| [26] |

JADERBERG M, SIMONYAN K, ZISSERMAN A. Spatial transformer networks[C]//Proceedings of 2015 IEEE Conference on Neural Information. Montreal, Quebec, Canada: Morgan Kaufmann, 2015: 2017-2025.

|

| [27] |

POHLEN T, HERMANS A, MATHIAS M, et al. Full-resolution residual networks for semantic segmentation in street scenes[C]//Proceedings of 2017 IEEE Conference on Computer Vision and Pattern Recognition (CVPR). Honolulu, HI, USA: IEEE, 2017: 3309-3318.

|

| [28] |

BOKHOVKIN A, BURNAEV E. Boundary loss for remote sensing imagery semantic segmentation[C]//Proceedings of 2019 International Symposium on Neural Networks. Moscow, Russia: Springer, 2019: 388-401.

|