2. 南京工业大学建筑设计研究院,江苏 南京 210009

2. Architectural Design and Research Institute, Nanjing Tech University, Nanjing 210009, China

点云配准是计算机视觉和机器人技术中的一项基本任务,被广泛应用于三维建模、室内测绘、自动驾驶和同时定位与制图(simultaneous localization and mapping,SLAM)[1-2]。迭代最近点(iterative closest point,ICP)是应用最为广泛的点云配准方法[3],但该方法对初始变换参数较为敏感[4]。因此,相关学者提出了基于特征的点云配准方法,如文献[5—6]利用模式识别方法建立对应点统一点云坐标系。

为实现稳健配准,文献[7—8]设计了健壮的点云特征描述符。具有强描述性的描述符增强了非对应点间的识别能力,同时保证了正确对应点具有较大的相似性。点云特征描述符可分为基于人为设计和基于深度学习二类。基于人为设计的方法有旋转图像(spinImage)[9]、快速点特征直方图(FPFH)[6]和方向直方图描述(SHOT)[10],该类描述符由点云局部几何形状决定,对噪声较为敏感[11]。受深度学习启发,基于深度神经网络的特征描述符被提出,如FCGF[7]和PPFNet[8]。

获取特征描述符后,利用特征匹配方法建立对应点。匹配策略可分为一元匹配策略和高阶匹配策略,基于一元的匹配方法有比率检验[12]、距离度量[13]和互反检验[14]。一元匹配策略将每个特征描述符视为独立单元,易受噪声和对称结构干扰。高阶匹配策略保证了几何结构对齐,快速全局配准(fast global registration,FGR)[15]和deep hough voting[16]方法通过构造三联体验证对应点稳健性,但三联体仅适用于验证三点间的结构相似性,泛化性较差。在图像领域,基于图模型的对应点估计方法也得到了充分的发展,如谱匹配[17]、重加权随机游走匹配(reweight random walks matching,RRWM)[18]和最大池化匹配(max-pooling matching,MPM)[19]等,虽然上述图匹配方法能较好地完成图像特征匹配,但在点云特征匹配中的性能并不理想。

点云特征匹配面临噪声、部分重叠和重复结构等诸多问题,匹配结果中不可避免地包含了大量错误匹配[20]。随机抽样一致(random sample consensus,RANSAC)方法被广泛用于剔除点云配准中的错误匹配[21],但在离群值比率较高情况下,RANSAC方法配准结果不理想。3DRegNet[22]、PointDSC[23]和DGR[24]方法利用稀疏卷积和多层感知机构建误匹配剔除方法实现点云配准。上述配准方法强调了离群值滤波的重要性,配准精度受初始匹配结果限制。

图模型不受点云位移和旋转的影响,较好地描述了三维点间的几何结构。针对传统特征匹配策略易受噪声和对称结构等不利因素影响的问题,本文利用图模型的几何信息作为对应点提取的约束条件,优化同平台点云初始匹配结果。图匹配可作为特征匹配方法,适用于多种基于特征的同平台点云配准技术。为充分利用点云几何信息优化配准精度,本文提出一种基于空间一致性的同平台点云配准方法(spatial consistency-based registration, SCR)。基于图模型构建具有高阶相似度的特征匹配模型,提出附加冲突行走预防的重加权随机游走匹配算法获取匹配结果,并利用假设检验方法估计点云位姿参数。与FGR和deep hough voting的三元组检验相比,SCR可推广到n元组检验,具有更为广泛的应用价值。

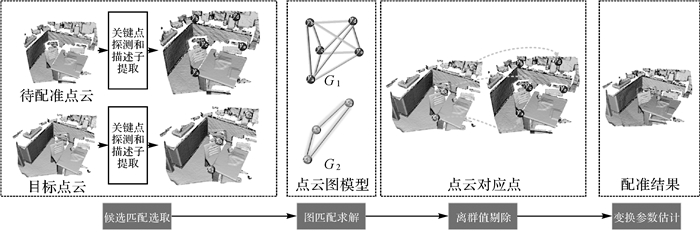

1 基于空间一致性的点云配准方法构建SCR主要包括候选匹配选取、图匹配求解、离群值剔除和变换参数估计4个步骤,如图 1所示。

|

| 图 1 SCR方法框架 Fig. 1 SCR method framework |

1.1 候选匹配选取

基于特征的点云配准方法通常将特征空间邻近点作为初始对应点[15],但点云受噪声和重复结构影响,正确对应点在特征空间中的距离可能并非最小值。因此,SCR扩大了关键点候选匹配数量,并利用空间一致性约束估计最优对应点。

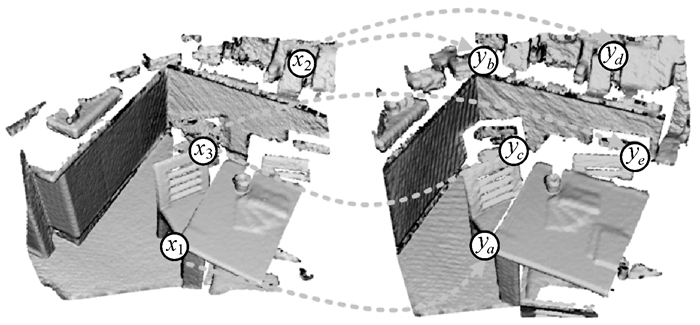

为降低特征匹配计算复杂度,首先利用内部形态描述子(intrinsic shape signatures,ISS)[25]提取点云关键点,并利用FPFH方法获取关键点的特征描述符,文献[26]已证明了ISS和FPFH方法的有效性。SCR保留了关键点的多个假设候选匹配,若两点在特征空间中的距离小于设定的距离阈值,则将其作为一对候选匹配。设yk=C(xi)表示yk和xi为对应点,如图 2所示,ya=C(x1),yc≠C(x1)。

|

| 图 2 配准与其候选匹配 Fig. 2 The points to be registered and their candidate |

1.2 空间一致性匹配模型

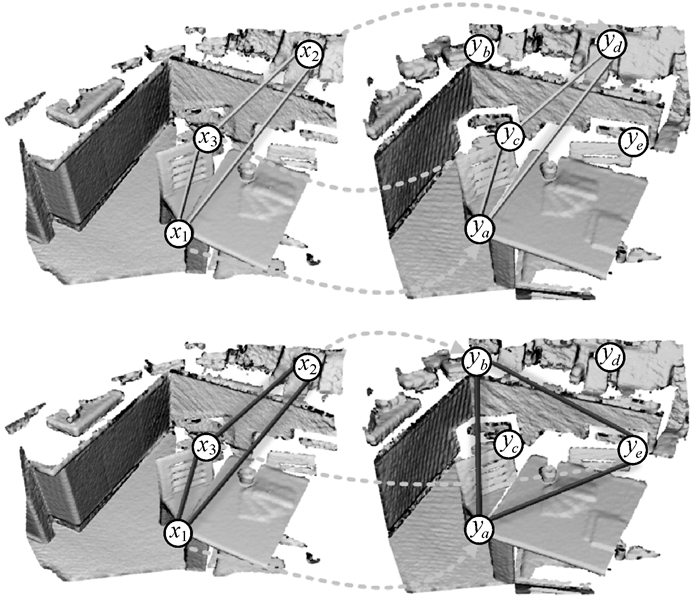

为从多个假设候选匹配中估计关键点的最优匹配,本文提出了基于图模型的空间一致性匹配方法。给定待配准点云关键点X={xi|xi∈R3}i=1N和目标点云关键点Y={yk|yk∈R3}k=1M,令Ω为X和Y的对应点集合,Ω={(xj, yj)}j=1K,两组点云由相同平台采集。若Ω中对应点均满足(xi, xj)两点间的欧氏距离等于(yi, yj)两点间的欧氏距离,则称Ω具有空间一致性;若长度不相等,Ω至少存在一对错误匹配,如图 3所示。

|

| 图 3 基于空间一致的点云特征匹配 Fig. 3 3D feature matching based on spatial consistency |

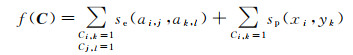

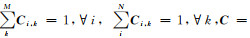

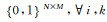

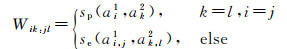

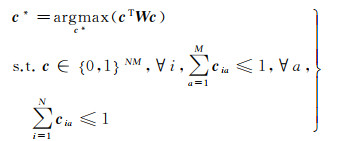

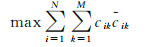

设C为邻接矩阵,若xi和yk为一组对应点,Ci, k等于1,否则为0,由定义可知C中元素为0或1。令ai, j为xi和xj间的欧氏距离,ak, l为yk和yl间的欧氏距离,空间一致性匹配方法目标方程f(C)由长度相似性se(ai, j, ak, l)和点相似性sp(xi, yk)组成,求解空间一致性匹配结果可表示为最大化f(C)

(1)

(1)

式中,

为求解式(1),将其转化为X和Y的图匹配问题。利用X和Y构建无向图G1=(V1, E1, A1)和G2=(V2, E2, A2),其中,V为图中节点,即三维离散点,E为节点连接边,A为图元素属性。ai1∈A1为节点xi的特征描述符,ai, j1∈A1表示节点xi和xj间欧氏距离。图匹配方法通过构建G1和G2的联合图Gs=(Vs, Es, As),将G1和G2匹配问题转化为Gs的节点排序问题。令W为Gs的亲和矩阵,节点v1a∈Vs由节点x1和ya构成。亲和矩阵元素Wik: jl定义为

(2)

(2)

式中,sp(ai1, ak2)=1/||ai1-ak2||;se(aij1, akl2)=max(D-|aij1, akl2|, 0);ai, j1=||xi-xj||2;ak, l2=||yk-yl||2。令c∈{0, 1}NM为C的列矢量化向量,将式(1)问题转化为基于重加权随机游走匹配的优化方法求解

(3)

(3)

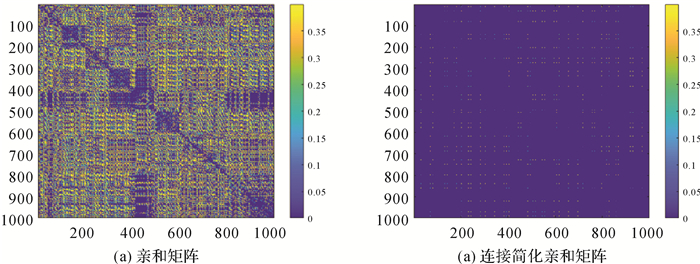

由于RRWM保留了该匹配问题中不兼容图节点间的连接,导致匹配结果不理想,因此本文提出了基于附加冲突行走预防的重加权随机游走匹配算法,简称为随机游走匹配。随机游走匹配通过保留Gs重要连接关系,剔除不兼容节点的连接边,构建更为紧凑的图模型,连接简化结果如图 4所示。连接简化模型被验证可有效优化图模型,提高方法精度和稳健性[27]。

|

| 图 4 连接简化结果 Fig. 4 Results of connection simplification |

设ya=C(xi),yb≠C(xj),随机游走匹配算法保留了via节点的连接,剔除了vjb节点的连接关系。通过将亲和矩阵W冲突元素的值设为0,实现Gs的连接简化。令

(4)

(4)

式中,

(5)

(5)

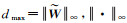

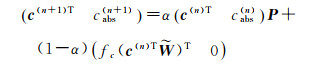

为避免随机游走匹配结果出现局部性,游走模型以α的概率移动到下一个节点,或以1-α的概率跳跃到图中任一节点,随机游走匹配最终可表示为

(6)

(6)

式中,重权函数fc(·)包含了参数膨胀和双随机归一化[18]。若c(n+1)=c(n)=c,幂迭代过程停止。设

(7)

(7)

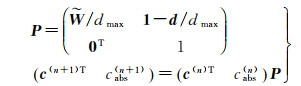

式中,

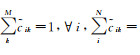

为统一点云坐标系,基于假设验证方法构建点云配准模型。首先,利用PointDSC离群值滤波模块剔除匹配结果中的错误匹配,并获取对应点的内点概率e。令R为旋转矩阵,t为平移矩阵,变换参数求解模型为

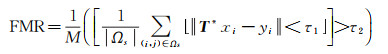

(8)

(8)

式中,xi和yi为点云三维坐标。通过奇异值分解方法获取式(8)闭环解[29],以此产生一组R,t用于假设验证。设定阈值τ,选择最佳变换参数

(9)

(9)

式中,符号

|

| 图 5 特征匹配结果 Fig. 5 Results of feature matching |

2 试验结果与分析 2.1 测试数据

本文分别利用3DMatch[30]数据集和WHU-TLS[11]数据集进行配准试验,3DMatch数据集中包含了8个不同室内场景的点云数据,WHU-TLS数据集包含了由激光扫描仪获取的10个不同场景的点云数据,两个数据集都提供了变换参数真值。试验对点云进行降采样,精度验证只统计重叠度大于30%数据的配准结果。

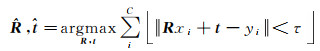

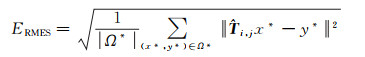

2.2 评价指标本文利用特征匹配召回率(feature matching recall, FMR)、配准误差(registration error, ERMSE)、旋转误差(rotation error, RE)和平移误差(translation error, TE) 4个指标对配准结果进行质量评价。特征匹配召回率定义为

(10)

(10)

式中,Ωs为对应点集合,|Ωs|表示Ωs中包含的元素数量;x和y为点云三维坐标;T*为真实变换矩阵;τ1和τ2为设定阈值。式中符号

(11)

(11)

式中,R*和t*分别为旋转矩阵和平移向量真值。配准误差定义为

(12)

(12)

式中,Ω*为两点云对应点真值,|Ω*|表示Ω*中包含的对应点数量;x*和y*为正确对应点三维坐标。若两点云的RE和TE同时小于0.3,则视为配准成功,令召回率(Recall)为配准成功的数量在总数据量中的比重。

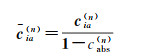

2.3 图匹配试验为研究所提出的图匹配方法在同平台点云配准中的性能,本文利用RRWM、MPM图匹配方法进行对比试验。为消除特征描述和关键点探测算法对试验结果的影响,采用相同算法提取点云的关键点和特征描述符,并将离群滤波和变换参数估计作为通用步骤。试验结果显示,采用本文图匹配方法可将FMR提高至26.5,配准精度有明显提升,图匹配方法点云配准性能比较,见表 1。

| 方法 | TE/m | RE/rad | ERMSE/m | FMR/(%) |

| 未引入图匹配方法 | 0.433 | 0.640 | 0.350 | 23.8 |

| RRWM方法 | 1.217 | 1.691 | 0.855 | 16.4 |

| MPM方法 | 0.873 | 1.248 | 0.681 | 26.4 |

| 本文图匹配方法 | 0.403 | 0.543 | 0.319 | 26.5 |

比较未引入图匹配方法和RRWM、MPM方法结果发现,RRWM和MPM方法不会提高点云配准精度,并出现负面影响。与未引入图匹配的配准方法相比,引入本文图匹配方法的配准结果具有更高的特征匹配召回率、更优的配准精度。虽然MPM方法和本文图匹配方法的特征匹配召回率接近,但配准误差相差较大,且对比未引入图匹配方法和MPM方法可知,特征匹配召回率更高并不等同配准精度更高,本文图匹配方法获取的对应点更准确。

为进一步证明本文图匹配方法的适用性,试验展示了图匹配方法结合RANSAC、FGR和3DRegNet方法的配准结果。RANSAC、FGR和3DRegNet方法均利用特征描述符获取点云的初始对应点,因此试验将本文图匹配方法作为RANSAC、FGR和3DRegNet方法的特征匹配模块进行配准试验,配准结果见表 2。

| 方法 | 评价指标 | ||

| TE/m | RE/rad | ERMSE/m | |

| RANSAC | 1.344 | 1.878 | 1.009 |

| FGR | 0.586 | 0.929 | 0.670 |

| 3DRegNet | 1.370 | 1.927 | 0.942 |

| 本文图匹配方法+RANSAC | 1.290 | 1.797 | 0.929 |

| 本文图匹配方法+FGR | 0.586 | 0.846 | 0.599 |

| 本文图匹配方法+3DRegNet | 1.244 | 1.763 | 0.837 |

表 2前3行分别为RANSAC、FGR和3DRegNet原始方法的配准结果,后3行为图匹配结合3种方法的配准结果。虽然FGR原始方法与结合方法的平移误差相等,但由表 2可知,相较于原方法,结合图匹配的配准方法均具有更优的配准结果。综上所述,图匹配可作为特征匹配方法广泛地应用于基于特征的同平台点云配准,具有较好的适用性;图匹配方法通过利用几何结构约束对应点提取,提高同平台点云配准精度。

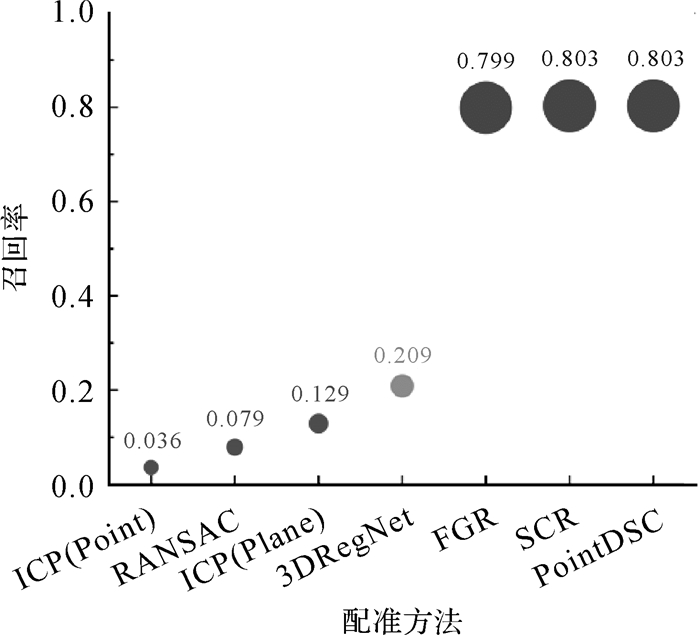

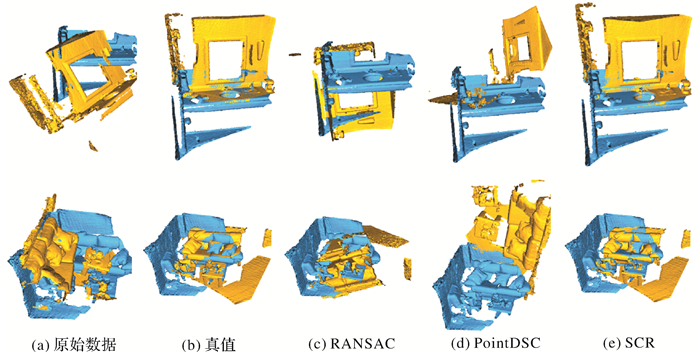

2.4 室内场景配准试验为验证SCR方法的有效性,配准试验展示了3种经典配准方法(ICP、FGR和RANSAC)和3种深度学习配准方法(PointDSC、DGR和3DRegNet)的配准结果。经典配准方法由Open3D库[31]提供,深度学习配准方法采用3DMatch数据集的训练权值进行配准,配准结果见表 3。

| 方法 | 评价指标 | ||

| TE/m | RE/rad | ERMSE/m | |

| ICP | 0.591 | 1.092 | 0.925 |

| RANSAC | 1.344 | 1.878 | 1.009 |

| PointDSC | 0.397 | 0.594 | 0.356 |

| DGR | 0.756 | 1.062 | 0.592 |

| FGR | 0.586 | 0.929 | 0.670 |

| 3DRegNet | 1.370 | 1.927 | 0.942 |

| SCR | 0.403 | 0.543 | 0.319 |

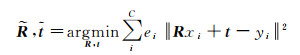

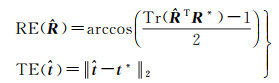

由表 3可知,SCR平移误差略高于PointDSC方法,但旋转误差和配准误差显著优于PointDSC方法,且不难看出,SCR配准精度较其余算法有较大提升。3DRegNet相较其原文性能有较大程度的下降,是因为FPFH描述符初始匹配中离群值比率较高,部分配准方法Recall指标如图 6所示。

|

| 图 6 配准方法召回率结果 Fig. 6 Recall results of registration methods |

为进一步验证SCR方法的有效性,表 4展示了RANSAC、PointDSC和SCR方法在不同重叠度下的配准结果。

| 重叠度 | 匹配方法 | TE/m | RE/rad | ERMSE/m |

| 40% | RANSAC | 1.346 | 1.842 | 0.949 |

| PointDSC | 0.397 | 0.578 | 0.308 | |

| SCR | 0.350 | 0.459 | 0.266 | |

| 50% | RANSAC | 1.088 | 1.603 | 0.797 |

| PointDSC | 0.232 | 0.373 | 0.202 | |

| SCR | 0.161 | 0.247 | 0.152 |

由表 4可知,重叠度为40%和50%时,SCR评价指标均优于RANSAC和PointDSC方法。究其原因,RANSAC和PointDSC方法通常将特征空间邻近点作为初始对应点,导致配准精度较低。SCR通过空间一致性约束在多个假设匹配中选取了具有一致性的对应点,有效地提高了同平台点云配准的精度和稳健性。如图 7所示,SCR方法在所示两个场景中获得更好的配准结果。

|

| 图 7 配准结果可视化 Fig. 7 Visualization of registration results |

1范数和2范数作为一元相似度匹配方法被广泛使用[13]。分别在该数据集中8个场景中定量比较基于1范数度量、基于2范数度量和空间一致性匹配方法的特征匹配结果,结果见表 5。

| 方法 | red kitchen | home-1 | home-2 | hotel-1 | hotel-2 | hotel-3 | study room | laboratory |

| 1范数 | 4.6 | 14.9 | 16.1 | 0.5 | 5.1 | 0 | 0.9 | 1.7 |

| 2范数 | 3.2 | 11.9 | 12.4 | 0.5 | 2.6 | 0 | 0.5 | 0 |

| 本文方法 | 9.7 | 14.9 | 18.2 | 7.6 | 6.4 | 2.1 | 3.2 | 20.7 |

由表 5可知,空间一致性匹配方法在多类型场景下具有较高的特征匹配召回率。且与三元组检验相比,该方法可检测n个点间结构的相似性,具有更为广泛的应用价值。

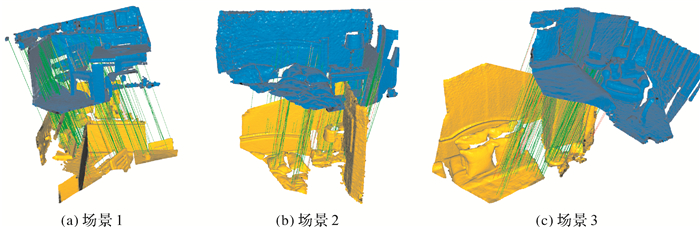

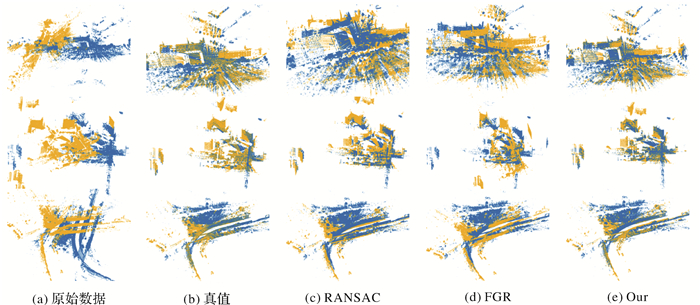

2.5 室外场景配准试验利用WHU-TLS数据集验证本文方法在室外场景下的有效性,分别选取该数据集3个场景(park,campus和riverbank)中的一对点云进行配准试验,选取的3对点云重叠度分别为74.4%、69.7%和49.6%。SCR将对应点的内点概率e均设置为1,试验展示了RANSAC、FGR和SCR的配准精度,结果见表 6。

| 方法 | Park | Campus | RiverBank | |||||

| TE/m | RE/rad | TE/m | RE/rad | TE/m | RE/rad | |||

| RANSAC | 27.09 | 0.247 | 10.78 | 0.090 | 10.64 | 0.031 | ||

| FGR | 12.50 | 0.185 | 4.62 | 0.052 | 31.93 | 0.140 | ||

| SCR | 1.67 | 0.036 | 1.10 | 0.007 | 3.03 | 0.023 | ||

由表 6可知,在3个场景的配准试验中,SCR都显著优于RANSAC和FGR,其旋转误差和平移误差均低于RANSAC和FGR的旋转误差和平移误差,3个场景的配准结果如图 8所示。利用本文方法构建关键点图模型不受配准场景大小限制,可通过获取室外扫描数据的空间一致性对应点提高点云配准精度,因此,SCR适用于配准大规模地面激光扫描点云。

|

| 图 8 配准结果可视化 Fig. 8 Visualization of registration results |

3 结论

为充分利用同平台点云几何信息提高配准精度,本文提出了基于空间一致性的同平台点云配准方法。通过优化现有图匹配方法,本文提出了附加冲突行走预防的重加权随机游走匹配算法;SCR利用图匹配方法在多个候选匹配中选取了具有一致性的对应点,并基于假设验证方法统一点云坐标系。利用3DMatch数据集和WHU-TLS数据集对本文方法进行验证,综合试验结果表明,本文方法对于配准同平台点云有较好的适用性,通过利用空间一致性约束优化了对应点提取结果,提高了点云配准精度。后续工作将提取点云中的高级语义信息构建点云图模型,进一步提高图匹配在点云配准中的稳健性和精度。

| [1] |

闫利, 戴集成, 谭骏祥, 等. SLAM激光点云整体精配准位姿图技术[J]. 测绘学报, 2019, 48(3): 313-321. YAN Li, DAI Jicheng, TAN Junxiang, et al. Global fine registration of point cloud in LiDAR SLAM based on pose graph[J]. Acta Geodaetica et Cartographica Sinica, 2019, 48(3): 313-321. DOI:10.11947/j.AGCS.2019.20170716 |

| [2] |

YAN Li, DAI Jicheng, TAN Junxiang, et al. Global fine registration of point cloud in LiDAR SLAM based on pose graph[J]. Journal of Geodesy and Geoinformation Science, 2020, 3(2): 26-35. |

| [3] |

BESL P J, MCKAY N D. A method for registration of 3D shapes[J]. IEEE Transactions on Pattern Analysis and Machine Intelligence, 1992, 14(2): 239-256. DOI:10.1109/34.121791 |

| [4] |

闫利, 谭骏祥, 刘华, 等. 融合遗传算法和ICP的地面与车载激光点云配准[J]. 测绘学报, 2018, 47(4): 528-536. YAN Li, TAN Junxiang, LIU Hua, et al. Registration of TLS and MLS point cloud combining genetic algorithm with ICP[J]. Acta Geodaetica et Cartographica Sinica, 2018, 47(4): 528-536. DOI:10.11947/j.AGCS.2018.20170235 |

| [5] |

孙文潇, 王健, 梁周雁, 等. 法线特征约束的激光点云精确配准[J]. 武汉大学学报(信息科学版), 2020, 45(7): 988-995. SUN Wenxiao, WANG Jian, LIANG Zhouyan, et al. Accurate registration of laser point cloud based on normal feature constraint[J]. Geomatics and Information Science of Wuhan University, 2020, 45(7): 988-995. |

| [6] |

RUSU R B, BLODOW N, BEETZ M. Fast point feature histograms (FPFH) for 3D registration[C]//Proceedings of 2009 IEEE International Conference on Robotics and Automation. Kobe: IEEE, 2009: 3212-3217.

|

| [7] |

CHOY C, PARK J, KOLTUN V. Fully Convolutional Geometric Features[C]//Proceedings of 2019 IEEE/CVF International Conference on Computer Vision. Seoul: IEEE, 2019: 8958-8966.

|

| [8] |

DENG Haowen, BIRDAL T, ILIC S. PPFNet: global context aware local features for robust 3D point matching[C]//Proceedings of 2018 IEEE/CVF Conference on Computer Vision and Pattern Recognition. Salt Lake: IEEE, 2018: 195-205.

|

| [9] |

JOHNSON A E, HEBERT M. Using spin images for efficient object recognition in cluttered 3D scenes[J]. IEEE Transactions on Pattern Analysis and Machine Intelligence, 1999, 21(5): 433-449. DOI:10.1109/34.765655 |

| [10] |

SALTI S, TOMBARI F, STEFANO L D. SHOT: Unique signatures of histograms for surface and texture description[J]. Computer Vision and Image Understanding, 2014, 125: 251-264. DOI:10.1016/j.cviu.2014.04.011 |

| [11] |

DONG Zhen, LIANG Fuxun, YANG Bisheng, et al. Registration of large-scale terrestrial laser scanner point clouds: a review and benchmark[J]. ISPRS Journal of Photogrammetry and Remote Sensing, 2020, 163: 327-342. DOI:10.1016/j.isprsjprs.2020.03.013 |

| [12] |

LOWE D G. Distinctive image features from scale invariant keypoints[J]. International Journal of Computer Vision, 2004, 60(2): 91-110. DOI:10.1023/B:VISI.0000029664.99615.94 |

| [13] |

RUBNER Y, TOMASI C, GUIBAS L J. The earth mover's distance as a metric for image retrieval[J]. International Journal of Computer Vision, 2000, 40(2): 99-121. DOI:10.1023/A:1026543900054 |

| [14] |

BRADSKI G, The OpenCV Library. Dr. Dobb's Journal of Software Tools[DB/OL]. http://opencv.arg/. 2000.

|

| [15] |

ZHOU Qianyi, PARK J, KOLTUN V. Fast global registration[M]//Proceedings of 2016 Computer Vision-ECCV European Conference, Amsterdam, The Netherlands. Springer International Publishing, 2016: 766-782.

|

| [16] |

LEE J, KIM S, CHO M, et al. Deep hough voting for robust global registration[C]//Proceedings of 2021 IEEE/CVF International Conference on Computer Vision. Montreal: IEEE, 2021: 15974-15983.

|

| [17] |

LEORDEANU M, HEBERT M. A spectral technique for correspondence problems using pairwise constraints[C]//Proceedings of the 10th IEEE International Conference on Computer Vision. Beijing: IEEE, 2005: 1482-1489.

|

| [18] |

CHO M, LEE J, LEE K M. Reweighted random walks for graph matching[C]//Proceedings of the 11th European conference on Computer vision: Part V. New York: ACM Press, 2010: 492-505.

|

| [19] |

CHO M, SUN Jian, DUCHENNE O, et al. Finding matches in a haystack: a max-pooling strategy for graph matching in the presence of outliers[C]//Proceedings of 2014 IEEE Conference on Computer Vision and Pattern Recognition. Columbus, OH, USA. IEEE, 2014: 2091-2098.

|

| [20] |

李彩林, 王志勇, 俞路路, 等. 最邻近曲面约束的近景光学影像与地面激光点云几何配准[J]. 测绘学报, 2020, 49(8): 1014-1022. LI Cailin, WANG Zhiyong, YU Lulu, et al. Geometric registration of close-range optical image and terrestrial laser point cloud constrained by nearest surface[J]. Acta Geodaetica et Cartographica Sinica, 2020, 49(8): 1014-1022. DOI:10.11947/j.AGCS.2020.20190146 |

| [21] |

FISCHLER M A, ROBERT C B. Random sample consensus: a paradigm for model fitting with applications to image analysis and automated cartography[J]. Communications of the ACM, 1981, 24(6): 381-395. DOI:10.1145/358669.358692 |

| [22] |

PAIS G D, RAMALINGAM S, GOVINDU V M, et al. 3DRegNet: a deep neural network for 3D point registration[C]//Proceedings of 2020 IEEE/CVF Conference on Computer Vision and Pattern Recognition. Seattle, WA: IEEE, 2020: 7193-7203.

|

| [23] |

BAI Xuyang, LUO Zixin, ZHOU Lei, et al. PointDSC: robust point cloud registration using deep spatial consistency[C]//Proceedings of 2021 IEEE/CVF Conference on Computer Vision and Pattern Recognition (CVPR). Nashville: IEEE, 2021: 15859-15869.

|

| [24] |

CHOY C, DONG Wei, KOLTUN V. Deep global registration[C]//Proceedings of 2020 IEEE/CVF Conference on Computer Vision and Pattern Recognition (CVPR). Seattle: IEEE, 2020: 2511-2520.

|

| [25] |

ZHONG Yu. Intrinsic shape signatures: a shape descriptor for 3D object recognition[C]//Proceedings of 2009 IEEE 12th International Conference on Computer Vision Workshops, ICCV Workshops. Kyoto: IEEE, 2010: 689-696.

|

| [26] |

GUO Yulan, BENNAMOUN M, SOHEL F, et al. A comprehensive performance evaluation of 3D local feature descriptors[J]. International Journal of Computer Vision, 2016, 116(1): 66-89. DOI:10.1007/s11263-015-0824-y |

| [27] |

LI Jiayuan. GESAC: robust graph enhanced sample consensus for point cloud registration[J]. ISPRS Journal of Photogrammetry and Remote Sensing, 2020, 167: 363-374. DOI:10.1016/j.isprsjprs.2020.07.012 |

| [28] |

MUNKRES J. Algorithms for the assignment and transportation problems[J]. Journal of the Society for Industrial and Applied Mathematics, 1957, 5(1): 32-38. DOI:10.1137/0105003 |

| [29] |

SORKINE O, RABINOVICH M. Least-squares rigid motion using SVD[J]. Computing, 2017, 1(1): 1-5. |

| [30] |

ZENG A, SONG S, NIEßNER M, et al. 3DMatch: learning the matching of local 3D geometry in range scans[C]//Proceedings of 2017 Conference on Computer Vision and Pattern Recognition. Honolulu: IEEE, 2017: 08182.

|

| [31] |

ZHOU Q Y, PARK J, KOLTUN V. Open3D: A modern library for 3D data processing[J/OL]. [2018-01-30]. https://arXiv.org/abs/1801.09847.

|